Автор: Денис Аветисян

Статья посвящена разработке комплексного подхода к управлению автономными системами искусственного интеллекта в сфере здравоохранения, направленного на предотвращение неконтролируемого разрастания и обеспечение безопасности.

Предлагается унифицированная структура UALM для управления жизненным циклом агентов искусственного интеллекта и обеспечения их подотчетности в здравоохранении.

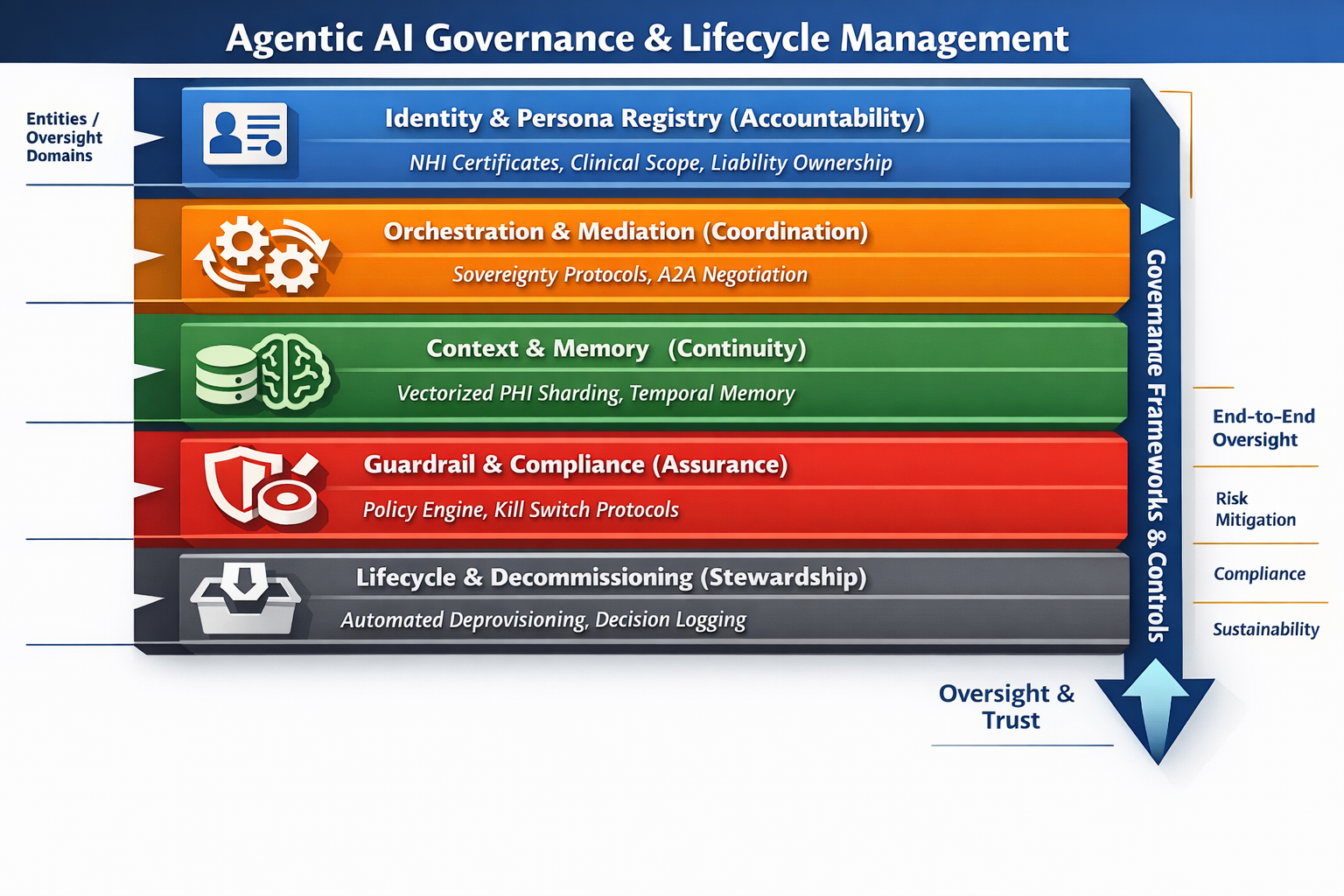

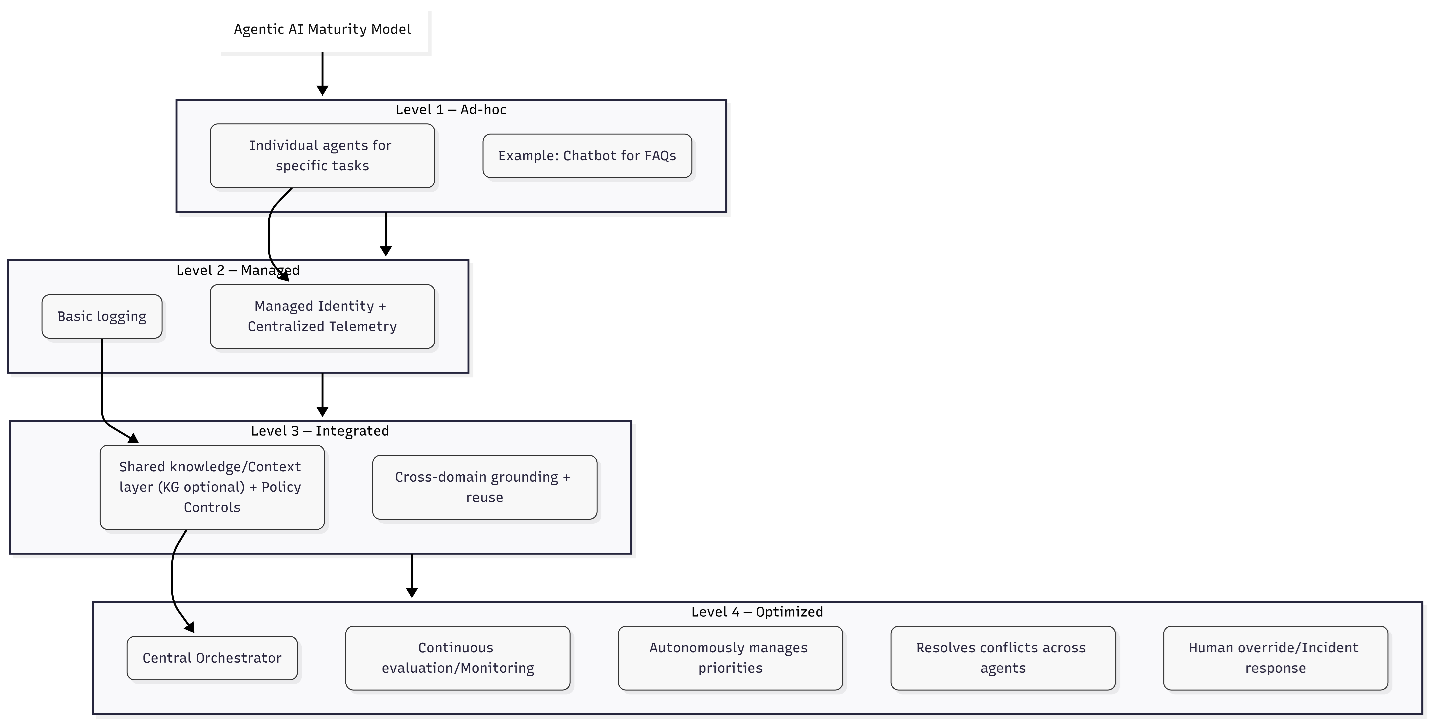

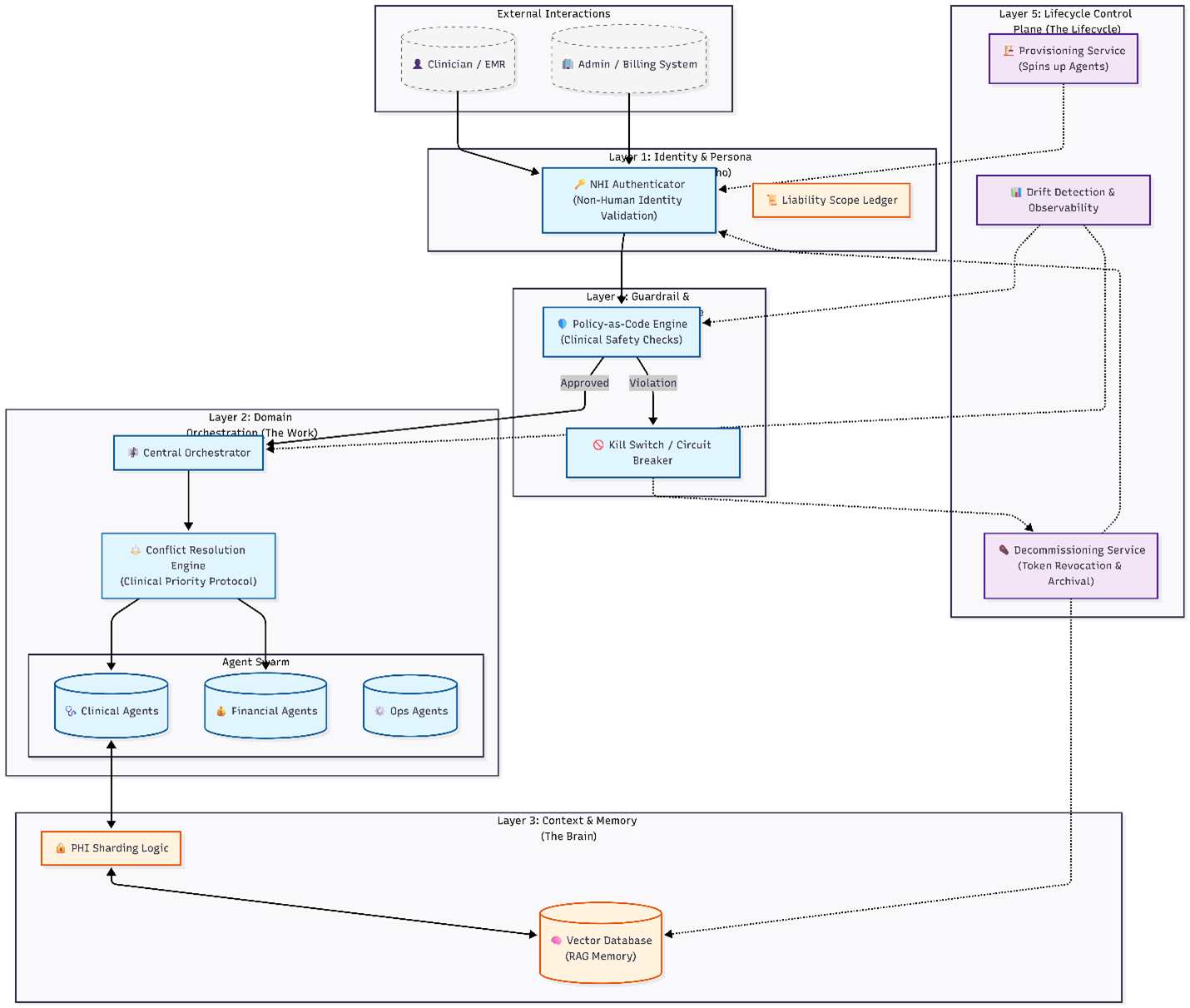

Несмотря на растущий потенциал автономных агентов искусственного интеллекта в здравоохранении, их широкое внедрение сопряжено с риском неконтролируемого разрастания и отсутствия четкой ответственности. В статье ‘Agentic AI Governance and Lifecycle Management in Healthcare’ предложен унифицированный подход к управлению жизненным циклом таких агентов, направленный на обеспечение безопасности и масштабируемости их применения. Предложенная модель UALM включает в себя пять уровней контроля, охватывающих идентификацию, оркестровку, защиту конфиденциальной информации, принудительное соблюдение политик и управление жизненным циклом. Сможет ли данная архитектура стать основой для создания надежной и прозрачной системы управления автономными агентами в клинической практике и административных процессах?

Эволюция Автономных Систем в Здравоохранении: Новый Операционный Парадигма

В здравоохранении наблюдается переход от получения прогностических данных к автономной операционной способности, что обусловлено прогрессом в области искусственного интеллекта. Ранее системы искусственного интеллекта преимущественно использовались для выявления потенциальных рисков и предоставления врачам информации для принятия решений. Теперь же, благодаря развитию алгоритмов, способных к многошаговому планированию и самостоятельному выполнению задач, искусственный интеллект все чаще берет на себя непосредственное управление рутинными процессами, такими как мониторинг состояния пациентов, корректировка дозировок лекарств и даже проведение базовых диагностических процедур. Этот сдвиг позволяет высвободить ценное время врачей для более сложных случаев, повысить эффективность оказания помощи и снизить вероятность человеческих ошибок, открывая новую эру в управлении здравоохранением.

Агентивные системы искусственного интеллекта представляют собой принципиально новый подход к применению технологий в здравоохранении. В отличие от традиционных систем, которые лишь предоставляют прогнозы или рекомендации, агентивные ИИ способны самостоятельно планировать и выполнять многоэтапные задачи. Это означает, что они могут не просто выявлять потенциальные проблемы, но и инициировать и координировать необходимые действия для их решения — от назначения анализов и консультаций до автоматической корректировки схем лечения, основываясь на поступающих данных и заранее заданных протоколах. Такой переход от пассивного анализа к активному действию открывает возможности для повышения эффективности клинической практики, снижения нагрузки на медицинский персонал и, в конечном итоге, улучшения качества оказания медицинской помощи.

Регулирование Автономных Систем: Баланс Инноваций и Безопасности

Внедрение автономных систем искусственного интеллекта (Agentic AI) в сфере здравоохранения подвержено строгому регулированию, в частности, требованиям Правил безопасности и конфиденциальности HIPAA в США и разрабатываемого Закона об искусственном интеллекте в Европейском Союзе. HIPAA регулирует обработку и защиту персональной медицинской информации пациентов, требуя от поставщиков услуг соблюдения строгих стандартов безопасности, конфиденциальности и доступа. Закон об ИИ в ЕС, в свою очередь, устанавливает классификацию систем ИИ в зависимости от уровня риска, и системы, используемые в здравоохранении, как правило, попадают в категорию высокого риска, требуя повышенного уровня прозрачности, аудита и ответственности. Несоблюдение этих нормативных актов может привести к значительным штрафам и юридическим последствиям.

Рамка управления рисками ИИ, разработанная NIST, предоставляет структурированный подход к выполнению требований управления рисками на протяжении всего жизненного цикла системы, что критически важно для соответствия нормативным требованиям, таким как HIPAA и будущий Закон об ИИ ЕС. Данная рамка охватывает этапы от проектирования и разработки до развертывания и мониторинга, предлагая конкретные рекомендации по идентификации, оценке и смягчению рисков, связанных с использованием агентивных систем. Она акцентирует внимание на необходимости документирования процессов, проведения регулярных оценок и адаптации мер безопасности к изменяющимся условиям, обеспечивая тем самым соответствие регуляторным стандартам и снижение потенциальных угроз.

Соблюдение нормативных требований и рамок, таких как HIPAA и AI Act, в сфере агентных систем — это не просто юридическое обязательство, а фундаментальная необходимость для формирования доверия пользователей и обеспечения безопасности пациентов. Несоблюдение этих требований может привести к серьезным юридическим последствиям, включая штрафы и судебные иски, однако, более критичным является потенциальный ущерб репутации и потеря доверия со стороны пациентов и медицинского персонала. Гарантирование соответствия стандартам безопасности и конфиденциальности данных является ключевым фактором для успешного внедрения и эксплуатации агентных систем в здравоохранении, поскольку это напрямую влияет на качество и надежность предоставляемых услуг, а также на защиту персональных данных пациентов.

Синергия Мультимодальных Моделей и Автоматизации: Новый Уровень Эффективности

Мультимодальные большие языковые модели, такие как Med-PaLM 2 и Med-Flamingo, играют ключевую роль в развитии автономных агентов (Agentic AI). Они способны объединять и анализировать данные из различных источников, включая медицинские изображения (рентгенограммы, МРТ и т.д.) и информацию, поступающую в реальном времени (данные мониторов пациента, результаты анализов). Это позволяет системам формировать более полное и точное представление о состоянии пациента, чем при использовании только текстовых данных, и, следовательно, принимать более обоснованные решения или предлагать соответствующие рекомендации. Способность к интеграции разнородных данных является основополагающей для создания интеллектуальных систем, способных к автономной деятельности в сложных областях, таких как здравоохранение.

Система Nuance DAX Copilot автоматизирует процесс ведения медицинской документации, существенно снижая административную нагрузку на врачей. Функционал включает автоматическую генерацию заметок по приёму, заполнение шаблонов и структурирование информации из аудиозаписей и других источников. Внедрение DAX Copilot позволяет сократить время, затрачиваемое на рутинную документацию, в среднем на 50%, что высвобождает ценные ресурсы для непосредственной работы с пациентами и повышения качества медицинской помощи. Система интегрируется с существующими медицинскими информационными системами (МИС) и обеспечивает соответствие нормативным требованиям к ведению медицинской документации.

Взаимодействие мультимодальных больших языковых моделей, таких как Med-PaLM 2 и Med-Flamingo, с инструментами автоматизации, например Nuance DAX Copilot, позволяет создавать более эффективную и оперативную систему здравоохранения. Автоматизация рутинных задач, включая документацию, снижает нагрузку на медицинский персонал, высвобождая время для непосредственной работы с пациентами. Синтез данных из различных источников, включая медицинские изображения и текущую информацию, в сочетании с автономными агентами, способствует повышению точности диагностики, оптимизации планов лечения и улучшению общей эффективности работы медицинских учреждений. Данная синергия технологий направлена на создание саморегулирующейся системы, способной адаптироваться к изменяющимся потребностям пациентов и оптимизировать использование ресурсов.

Предотвращение «Разрастания Агентов»: Контроль над Автономными Системами

Неконтролируемое разрастание автономных агентов, получившее название “разрастание агентов”, представляет собой растущую проблему для медицинских учреждений. По мере увеличения числа агентов, выполняющих различные задачи — от планирования приема пациентов до анализа медицинских изображений — возрастает риск возникновения неэффективности, ошибок и дублирования усилий. Отсутствие централизованного управления может привести к ситуациям, когда несколько агентов одновременно пытаются выполнить одну и ту же задачу, или, наоборот, важные процессы остаются без внимания. Кроме того, возрастают риски, связанные с безопасностью данных и соблюдением нормативных требований, поскольку становится сложнее отслеживать действия каждого агента и обеспечивать соответствие установленным правилам и стандартам. Подобная ситуация требует срочного внедрения эффективных механизмов контроля и управления, чтобы гарантировать безопасное и эффективное использование автономных систем в здравоохранении.

Для смягчения рисков, связанных с неконтролируемым ростом числа автономных агентов, необходимы эффективное управление, стандартизация и централизованное администрирование. Предложенная Унифицированная Система Управления Жизненным Циклом Агентов (UALM) направлена на обеспечение полной ответственности за каждого агента, закрепляя за ним конкретного владельца. Этот подход позволяет не только повысить безопасность и эффективность работы автоматизированных систем в здравоохранении, но и обеспечить соответствие нормативным требованиям, а также упростить процессы аудита и контроля. Внедрение UALM представляет собой ключевой шаг к ответственному развертыванию Agentic AI, гарантируя, что каждый агент функционирует в рамках установленных правил и под надлежащим контролем.

Предотвращение неконтролируемого разрастания автономных агентов представляется ключевым фактором для полноценной реализации потенциала автоматизированных систем в здравоохранении. Внедрение проактивных мер по управлению агентами направлено на достижение двух важнейших целей: полное отсутствие “сиротских” агентов, не имеющих ответственного владельца, и регистрация обоснования политического решения для каждого обращения к инструментам, используемым этими агентами. Достижение этих показателей позволит не только повысить безопасность и эффективность работы автоматизированных систем, но и обеспечит прозрачность и соответствие нормативным требованиям, что необходимо для широкого внедрения и доверия к технологиям искусственного интеллекта в медицинской практике. В конечном итоге, систематический подход к управлению жизненным циклом агентов создаст условия для максимального использования преимуществ автоматизации, минимизируя при этом потенциальные риски и обеспечивая устойчивое развитие отрасли.

Исследование, представленное в статье, стремится к систематизации управления агентным ИИ в здравоохранении, что находит глубокий отклик в словах Андрея Николаевича Колмогорова: «Математика — это искусство открывать закономерности в хаосе». Действительно, UALM, предложенная в статье, представляет собой попытку выявить и структурировать закономерности в сложной и динамичной среде мультиагентных систем. В частности, акцент на предотвращении «разрастания агентов» и обеспечении четкой ответственности — это своего рода «реверс-инжиниринг» хаоса, стремление понять и контролировать непредсказуемость, свойственную системам с множеством взаимодействующих компонентов. Данный подход позволяет не просто управлять технологией, но и прогнозировать её развитие, выявляя потенциальные риски и возможности.

Что дальше?

Предложенная унифицированная архитектура управления, UALM, выглядит как попытка навести порядок в хаосе «умных» агентов, но за каждым решением скрывается новый вопрос. Если считать, что разрастание агентов — это симптом, а не болезнь, то что является первопричиной? Не является ли стремление к полной автоматизации и децентрализации в здравоохранении само по себе формой системной ошибки? Остается неясным, как UALM будет справляться с непредсказуемым поведением, возникающим при взаимодействии множества агентов, и как гарантировать, что «ответственность» не превратится в удобный щит для тех, кто принимает решения.

Возникает искушение взглянуть на проблему под другим углом: а что, если «неконтролируемое» поведение агентов — это не сбой, а сигнал о неэффективности существующих протоколов и процедур? Если принять такую точку зрения, то вместо того, чтобы пытаться подавить «аномалии», следует изучать их, извлекать из них информацию и использовать для улучшения системы. Попытки четко определить «личность» нечеловеческого агента кажутся наивными, но за ними может скрываться более глубокий вопрос: что вообще означает «интеллект» в контексте машинных систем, и как мы определяем границы этого интеллекта?

В конечном счете, UALM — это лишь первый шаг. Настоящий вызов заключается в создании адаптивной системы управления, способной не просто контролировать агентов, но и учиться вместе с ними, предвидеть их поведение и использовать их потенциал для улучшения здравоохранения. И тогда, возможно, «разрастание агентов» превратится не в проблему, а в источник инноваций.

Оригинал статьи: https://arxiv.org/pdf/2601.15630.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Искусственный интеллект, который учится играть: новая платформа для стабильного обучения агентов

- Наука из текста: извлечение знаний из научных публикаций

- Вероятностный компьютер на фотонных чипах: новая эра вычислений

- Моделирование биомолекул: новый импульс от нейросетей

- Самообучающиеся признаки: новый подход к машинному обучению

- Сплетение света и времени: аттосекундная спектроскопия на квантовых парах

- Искусственный интеллект: хрупкость визуального мышления

- Ruyi2: Семейство языковых моделей для эффективного обучения и развертывания

- Робот-исследователь: новый подход к автономной навигации

- Иллюзия Компетентности: Как ИИ Переоценивает Себя

2026-01-25 01:13