Автор: Денис Аветисян

Статья исследует, как обеспечить надежность и ответственность автономных систем, выходя за рамки традиционных методов интерпретации моделей.

Переход к системному анализу причинно-следственных связей в многоагентных системах для обеспечения безопасности и подотчетности автономного ИИ.

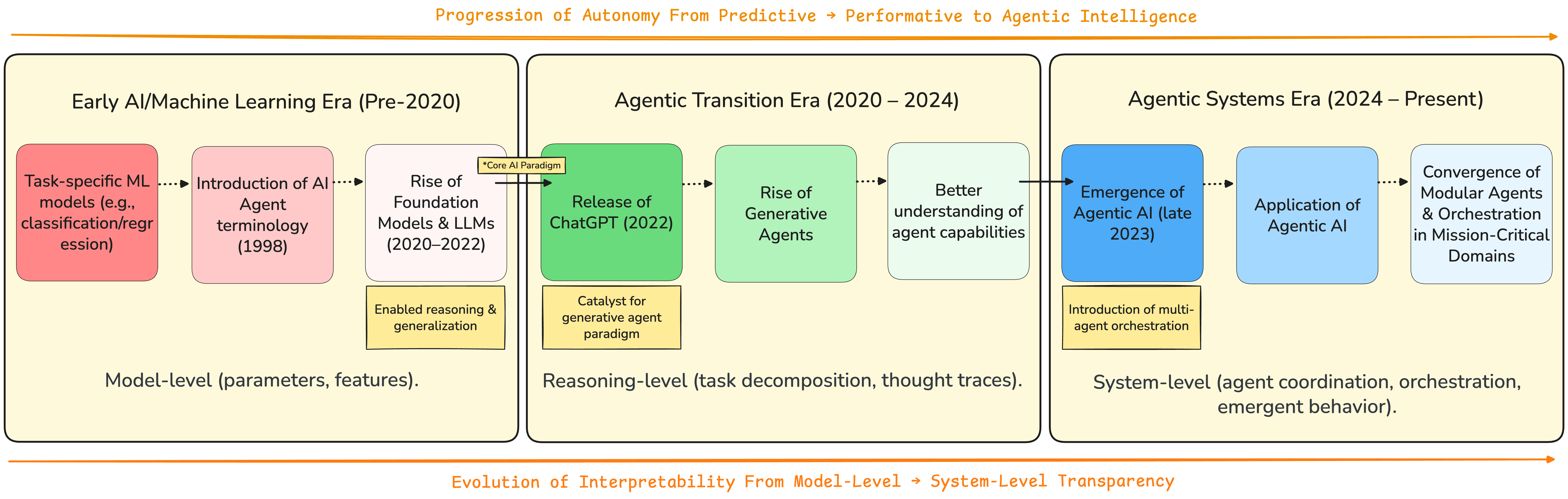

Несмотря на успехи в области машинного обучения, понимание поведения сложных автономных систем остается серьезной проблемой. В работе «Interpreting Agentic Systems: Beyond Model Explanations to System-Level Accountability» рассматривается ограниченность существующих методов интерпретируемости применительно к агентным системам, характеризующимся многоступенчатым планированием и взаимодействием со средой. Показано, что для обеспечения безопасности и подотчетности автономного ИИ необходимы новые подходы, ориентированные на системный анализ причинно-следственных связей, а не только на объяснение работы отдельных моделей. Какие механизмы надзора и интерпретируемости позволят эффективно контролировать поведение агентных систем на протяжении всего их жизненного цикла?

Традиционные системы и их ограничения: Крах иллюзий автоматизации

Традиционные системы искусственного интеллекта часто демонстрируют ограниченные возможности при решении сложных и динамично меняющихся задач, требующих последовательного рассуждения и адаптации. В отличие от систем, способных выполнять заранее запрограммированные действия, классические алгоритмы испытывают трудности при столкновении с непредвиденными обстоятельствами или необходимостью долгосрочного планирования. Это связано с их архитектурой, ориентированной на выполнение конкретных задач, а не на автономное принятие решений и корректировку стратегии в ответ на изменяющуюся обстановку. В результате, такие системы нуждаются в постоянном вмешательстве человека для преодоления возникающих препятствий и поддержания эффективной работы, что существенно ограничивает их применимость в реальных условиях.

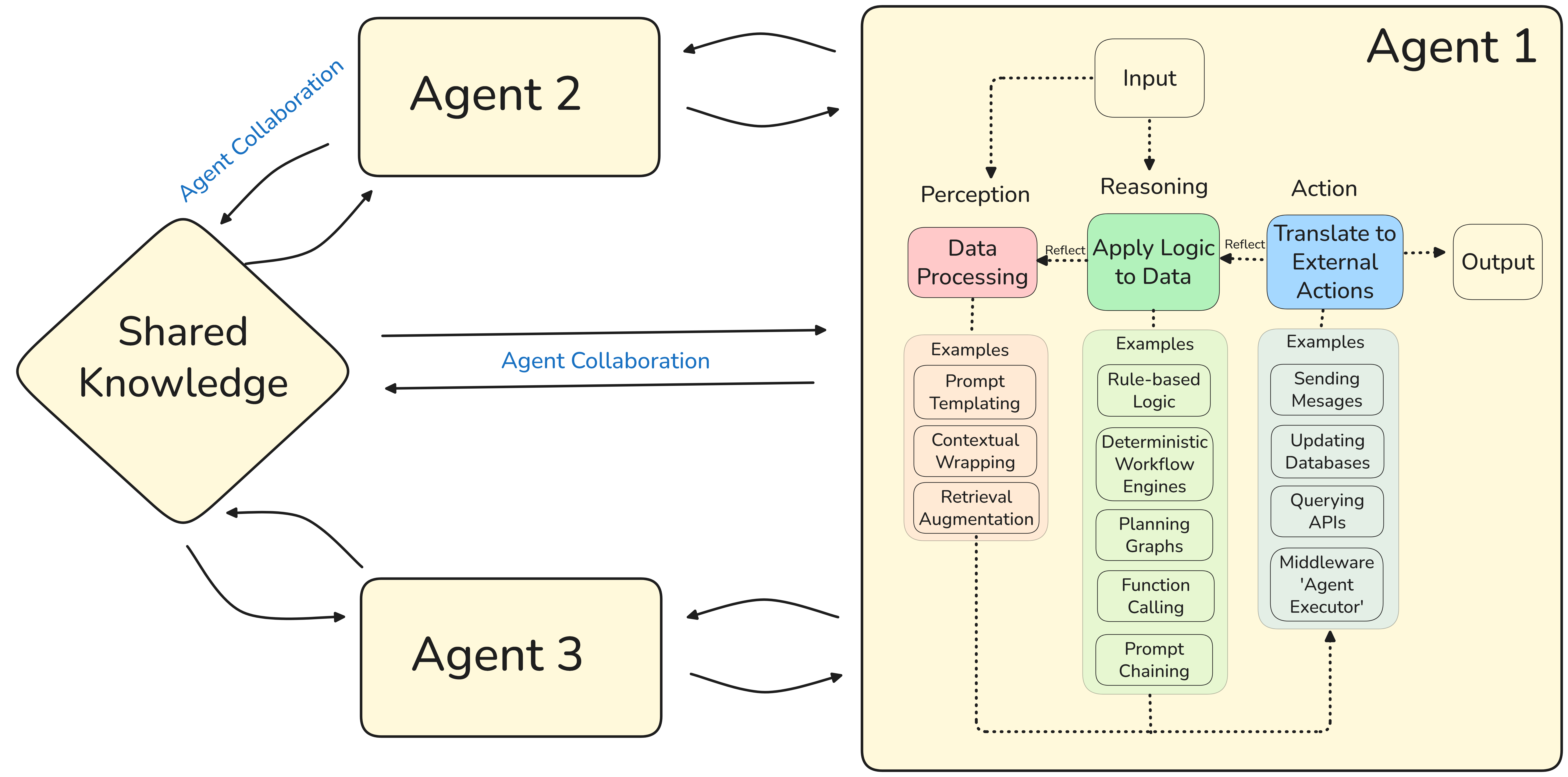

Агентные системы, созданные на базе больших языковых моделей, представляют собой принципиально новый подход к решению сложных задач, требующих не только обработки информации, но и самостоятельных действий. В отличие от традиционных систем искусственного интеллекта, которые нуждаются в постоянном внешнем управлении, агентные системы способны самостоятельно планировать и выполнять действия для достижения поставленной цели. Основываясь на возможностях языковых моделей понимать и генерировать естественный язык, эти системы могут анализировать ситуацию, определять необходимые шаги и координировать свои действия с другими агентами или инструментами. Такой подход позволяет им адаптироваться к меняющимся условиям и решать задачи, которые ранее считались недоступными для автоматизации, открывая перспективы для создания действительно автономных и интеллектуальных систем.

Появление агентных систем требует принципиального пересмотра подходов к разработке искусственного интеллекта. Вместо создания систем, ориентированных на выполнение строго заданных задач, акцент смещается в сторону формирования адаптивного и кооперативного интеллекта. Это предполагает отказ от жестко запрограммированных алгоритмов в пользу моделей, способных самостоятельно анализировать ситуацию, ставить цели и координировать действия с другими агентами для их достижения. Такой подход позволяет создавать системы, которые не просто реагируют на изменения окружающей среды, но и активно приспосабливаются к ним, обучаясь на собственном опыте и взаимодействуя с другими интеллектуальными сущностями. В результате, фокус разработки смещается от простого решения отдельных проблем к созданию самообучающихся и самоорганизующихся систем, способных к долгосрочному и комплексному взаимодействию с миром.

Память как основа разумного поведения: От реакций к планированию

Агентные системы, в отличие от моделей, оперирующих исключительно кратковременным контекстным окном, нуждаются в долговременной памяти для поддержания состояния и обучения на основе опыта. Кратковременная память, ограниченная объемом контекста, недостаточна для формирования сложных планов, адаптации к изменяющимся условиям и эффективного решения задач, требующих учета предшествующих взаимодействий. Долговременная память позволяет агенту сохранять информацию о прошлых событиях, извлекать уроки из опыта и применять их для улучшения текущей и будущей деятельности, обеспечивая тем самым устойчивое и последовательное поведение в динамичной среде. Без такой памяти агенты функционируют реактивно, не обладая способностью к планированию и адаптации на основе накопленных знаний.

Долгосрочная память в агентивных системах не является однородной структурой, а состоит из нескольких взаимосвязанных компонентов. Семантическая память хранит общие знания о мире, факты и концепции, позволяя агенту понимать контекст и делать обобщения. Эпизодическая память фиксирует конкретные события и переживания, формируя личный опыт агента и обеспечивая возможность обучения на прошлых взаимодействиях. Векторная память, использующая векторные представления данных, обеспечивает эффективное хранение и быстрый поиск информации, необходимой для принятия решений и планирования действий. Сочетание этих типов памяти позволяет агенту не только оперировать фактами, но и извлекать уроки из прошлого, адаптируясь к новым ситуациям и демонстрируя более сложные формы поведения.

Отсутствие устойчивой памяти принципиально ограничивает возможности агентов в построении сложных планов и адаптации к изменяющимся условиям. Без возможности сохранения и извлечения информации о прошлых событиях и полученном опыте, система не может формировать долгосрочные стратегии, предвидеть последствия действий или эффективно реагировать на новые ситуации. Это приводит к тому, что агенты, лишенные устойчивой памяти, вынуждены действовать исключительно на основе текущего контекста, что исключает возможность проявления признаков истинного интеллекта, таких как обучение, обобщение и принятие решений на основе накопленных знаний.

Интерпретируемость как необходимость: Раскрывая «черный ящик» агента

По мере усложнения агентивных систем их внутренние процессы принятия решений становятся непрозрачными, что вызывает опасения относительно предвзятости, ошибок и непредвиденных последствий. Это связано с увеличением числа взаимодействующих компонентов и нелинейностью возникающего поведения. Невозможность отследить логику, лежащую в основе действий агента, затрудняет выявление и исправление ошибок, а также оценку потенциальных рисков, особенно в критически важных приложениях. Отсутствие прозрачности также препятствует доверию пользователей к системе и ее принятию, поскольку сложно гарантировать, что агент действует в соответствии с ожидаемыми нормами и ценностями. Сложность анализа увеличивается экспоненциально с ростом масштаба и сложности агентивной системы, требуя новых методов и инструментов для обеспечения ее надежности и безопасности.

Для анализа процессов принятия решений в агентах и выявления потенциальных уязвимостей критически важны методы, такие как SHAP Values (значения Шэпли) и временной причинно-следственный анализ. SHAP Values позволяют оценить вклад каждой входной переменной в конкретное предсказание, обеспечивая понимание важности признаков. Временной причинно-следственный анализ, в свою очередь, позволяет проследить последовательность событий, приведших к определенному результату, выявляя причинно-следственные связи и потенциальные точки отказа. Комбинированное использование этих методов предоставляет возможность детального изучения “черного ящика” агента, определения источников ошибок и предвзятости, а также повышения надежности и безопасности автономных систем.

Системная интерпретируемость выходит за рамки анализа отдельных компонентов, обеспечивая целостное понимание эмерджентного поведения внутри всей системы. Данная работа выявляет ограничения существующих методов интерпретируемости применительно к агентам, обусловленные сложностью их взаимодействия и нелинейностью процессов принятия решений. Подчеркивается необходимость перехода к причинно-следственному пониманию на системном уровне, а также разработки новых фреймворков для оценки безопасности и ответственности автономного ИИ, учитывающих взаимодействие между компонентами и возможность возникновения непредсказуемых последствий.

От помощников к коллегам: Координация и кооперация в мире агентов

Истинная сила агентных систем проявляется в их способности координировать свои действия и сотрудничать, достигая результатов, недостижимых для отдельного агента. Вместо простого выполнения отдельных задач, несколько агентов могут совместно решать сложные проблемы, распределяя ответственность и используя сильные стороны каждого. Такая координация позволяет системам адаптироваться к меняющимся условиям, эффективно распределять ресурсы и генерировать инновационные решения, превосходящие возможности любой одиночной сущности. Эта кооперация не просто суммирует индивидуальные возможности, а создает синергетический эффект, открывая путь к принципиально новым формам автоматизации и интеллектуальных систем.

Ранние примеры, такие как ChatGPT, GitHub Copilot и Claude, наглядно демонстрируют потенциал агентов на основе больших языковых моделей (LLM) в роли помощников при кодировании. Эти системы способны генерировать код, предлагать исправления и даже автоматически завершать фрагменты программ, значительно повышая продуктивность разработчиков. Вместо простого предоставления информации, они активно участвуют в процессе создания программного обеспечения, анализируя контекст и предлагая релевантные решения. Подобные инструменты не заменяют программистов, а выступают в качестве интеллектуальных ассистентов, освобождая их от рутинных задач и позволяя сосредоточиться на более сложных аспектах разработки. Их способность понимать естественный язык и преобразовывать его в исполняемый код открывает новые горизонты в автоматизации разработки программного обеспечения и делает процесс более доступным для широкого круга пользователей.

Системы нового поколения, такие как Claude Code, демонстрируют способность к автономному выполнению задач, что открывает перспективы для принципиально новых, совместных рабочих процессов. В отличие от простых ассистентов, эти системы способны самостоятельно декомпозировать сложные цели на последовательность действий, выполнять их и адаптироваться к изменяющимся условиям. Такой уровень автономии не только повышает эффективность, но и приводит к появлению эмерджентного поведения — неожиданных и полезных результатов, возникающих в процессе взаимодействия между агентами. Это создает возможности для разработки систем, которые могут решать задачи, которые были бы невозможны для одиночного агента или человека, и значительно расширяет границы автоматизации.

Наблюдая за потоком новых “интеллектуальных” систем, легко забыть о фундаментальной простоте, лежащей в основе любого сбоя. Статья справедливо указывает на ограниченность текущих методов интерпретируемости, фокусирующихся на отдельных моделях, когда требуется анализ на системном уровне. В конечном счёте, система всегда сложнее её компонентов, и попытки объяснить поведение агентов, игнорируя взаимодействие между ними, обречены на провал. Как однажды заметил Э́дсгер Вы́бе Ди́йкстра: «Программирование — это, прежде всего, не про изобретение новых вещей, а про умение контролировать сложность». Именно контроль над сложностью, а не просто “объяснение” отдельных моделей, является ключом к созданию действительно надёжных автономных систем. Все эти “революционные” подходы к интерпретируемости рано или поздно превратятся в техдолг, если не учитывать всю сложность взаимодействия агентов.

Что дальше?

Представленные размышления об интерпретации агентных систем, как и следовало ожидать, лишь аккуратно приподняли краешек занавеса над бездной нерешенных проблем. Увлечение «объяснимым ИИ» оказалось очаровательной иллюзией, позволяющей убедить себя, что контроль над сложными системами — это вопрос правильно подобранных алгоритмов. Продакшен, разумеется, уже нашел способы обойти эти «объяснения», демонстрируя, что реальное поведение проявляется только под давлением реальных нагрузок. И это хорошо — по крайней мере, мы знаем, что тестировать нужно не модели, а всю систему целиком.

Акцент на причинно-следственном анализе на системном уровне — шаг в верном направлении, хотя и не гарантирующий спасения. Попытки построить «прозрачные» агентные системы напоминают попытки построить идеальный замок из песка — волна неминуемо смоет все усилия. Вместо этого, возможно, стоит сосредоточиться на создании систем, способных обнаруживать и смягчать последствия собственных ошибок, а не на их предотвращении. В конце концов, всё новое — это старое, только с другим именем и теми же багами.

Будущие исследования, вероятно, будут неизбежно упираться в проблему масштабируемости. Понимание причинно-следственных связей в небольших, лабораторных системах — это одно, а в реальных, разросшихся агентных сетях — совсем другое. И, да, можно смело предположить, что любая «революционная» методика, предложенная сегодня, завтра станет очередным техдолгом. Но это, в сущности, и есть прогресс.

Оригинал статьи: https://arxiv.org/pdf/2601.17168.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Искусственный интеллект, который учится играть: новая платформа для стабильного обучения агентов

- Моделирование биомолекул: новый импульс от нейросетей

- Вероятностный компьютер на фотонных чипах: новая эра вычислений

- Ruyi2: Семейство языковых моделей для эффективного обучения и развертывания

- Сплетение света и времени: аттосекундная спектроскопия на квантовых парах

- Искусственный интеллект: хрупкость визуального мышления

- Пространственно Связанные Коды: Новый Взгляд на Надежность Связи

- Быстрый поиск смыслов: оптимизация векторных баз данных для больших языковых моделей

- Квантовый скачок в обработке радиоастрономических данных

- Самообучающиеся решатели уравнений: новый подход к научным вычислениям

2026-01-27 18:56