Автор: Денис Аветисян

Исследователи предложили метод, позволяющий создавать непрерывные, высококачественные видеопотоки любой продолжительности, решая проблему повторяющихся паттернов.

Представленный подход, названный LoL, эффективно борется с эффектом ‘sink collapse’ в авторегрессивных моделях генерации видео, используя RoPE-встраивания и оптимизированные механизмы внимания.

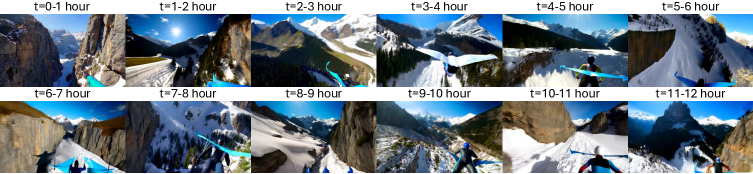

Несмотря на прогресс в области генерации длинных видео, современные авторегрессионные модели часто страдают от накопления ошибок и потери когерентности. В работе ‘LoL: Longer than Longer, Scaling Video Generation to Hour’ исследована проблема «sink-collapse» — феномена, при котором генерируемое видео циклически возвращается к ключевому кадру, приводя к резким переходам и повторяющимся паттернам. Предложенный авторами метод, основанный на введении «jitter» в Rotary Position Embedding (RoPE), эффективно подавляет данное поведение, позволяя генерировать непрерывные видеопотоки длительностью до 12 часов без существенной потери качества. Сможет ли данная технология открыть путь к созданию действительно бесконечных и реалистичных видеопоследовательностей?

На грани иллюзии: Современная генерация видео

Последние достижения в области генерации видео, ярко продемонстрированные системами, такими как Sora и Veo, представляют собой значительный прорыв в реалистичности и визуальной точности. Эти модели способны создавать удивительно правдоподобные видеоролики с высоким разрешением, имитирующие сложные сцены и движения с беспрецедентной детализацией. В отличие от предыдущих поколений генеративных моделей, новые системы демонстрируют способность к созданию последовательных, кинематографичных кадров, значительно расширяя возможности для творчества и применения в различных сферах, от киноиндустрии до образовательных платформ. Такой скачок в качестве обусловлен усовершенствованием алгоритмов и значительным увеличением вычислительных мощностей, что позволяет создавать более сложные и детализированные видеоматериалы.

Современные прорывы в генерации видео, демонстрируемые системами вроде Sora и Veo, опираются на принципы диффузионного моделирования, однако существенной проблемой остается масштабирование этого подхода для создания длительных и связных видеопоследовательностей. В основе диффузионного моделирования лежит постепенное добавление шума к исходному изображению до полного его искажения, а затем — обратный процесс, в ходе которого модель обучается восстанавливать изображение из шума. Успешное применение этого метода к видео требует не только генерации реалистичных кадров, но и поддержания временной согласованности между ними, что значительно усложняет задачу. Неспособность модели сохранять связность приводит к визуальным артефактам и нелогичным переходам, ограничивая возможности создания продолжительных и убедительных видеороликов. Исследователи активно работают над усовершенствованием архитектур и алгоритмов, направленных на повышение когерентности генерируемых видеопоследовательностей и преодоление ограничений, связанных с масштабированием диффузионного моделирования.

Авторегрессия и предел длительности: Когда последовательность выходит из-под контроля

Авторегрессионная генерация представляет собой естественный подход к синтезу видео, поскольку каждый последующий кадр формируется на основе предыдущих. Однако, по мере увеличения длины генерируемой последовательности, возрастает кумулятивная ошибка: небольшие неточности в каждом кадре накапливаются, приводя к ухудшению качества итогового видео. Кроме того, вычислительные затраты растут линейно с длиной последовательности, так как для генерации каждого кадра требуется повторное вычисление и хранение промежуточных результатов, что ограничивает возможности создания длинных видеороликов с использованием стандартных авторегрессионных моделей.

Методы, такие как Self-Forcing++ и LongLive, направлены на смягчение проблем накопления ошибок и вычислительных затрат, возникающих при генерации длинных видеопоследовательностей авторегрессивными моделями. Self-Forcing++ использует стратегию обучения с подкреплением для оптимизации процесса генерации, минимизируя отклонения от целевого контента. LongLive, в свою очередь, применяет итеративную генерацию и пересмотр, позволяя модели постепенно уточнять и расширять видео, тем самым избегая экспоненциального роста вычислительной сложности. Оба подхода позволяют значительно увеличить длину генерируемых видео, сохраняя при этом приемлемое качество и управляемые вычислительные ресурсы.

Ключевым элементом, обеспечивающим эффективность при генерации длинных последовательностей, является KV-кэш (Key-Value Cache). Данный механизм позволяет сохранять промежуточные результаты вычислений — ключи и значения, полученные на предыдущих шагах авторегрессивной генерации — и повторно использовать их, избегая пересчета. Это существенно снижает вычислительную нагрузку и потребление памяти, поскольку позволяет обрабатывать последовательность по частям (streaming) без необходимости хранить всю историю вычислений в оперативной памяти. Эффективное управление KV-кэшем, включая стратегии вытеснения и квантования, критически важно для масштабирования авторегрессивных моделей и генерации видео большой длительности.

Сохраняя нить повествования: Attention Sinks и дистилляция для долгоиграющего контента

Механизм Attention Sink является ключевым нововведением в LongLive, предназначенным для сохранения информации из начальных кадров видео и предотвращения феномена “Sink Collapse”. Данный механизм функционирует как резервуар, аккумулирующий и сохраняющий важные признаки из первых кадров, которые затем используются для улучшения когерентности генерируемого видео на протяжении всей последовательности. Без Attention Sink, информация из начальных кадров постепенно теряется в процессе генерации, приводя к несогласованности и деградации качества. Использование Attention Sink позволяет существенно уменьшить потерю информации и поддерживать стабильную генерацию видео с сохранением начальных признаков.

Метод дистилляции, известный как Distribution Matching Distillation (DMD), способствует повышению эффективности обучения и стабилизации процесса генерации видео. DMD фокусируется на сопоставлении распределений выходных данных модели-студента с распределениями модели-учителя, что позволяет студенту быстрее и точнее усваивать знания. Этот подход позволяет снизить вычислительные затраты на обучение и уменьшить вероятность нестабильности в процессе генерации, что особенно важно для задач генерации длинных последовательностей, таких как видео. В результате применения DMD наблюдается улучшение качества генерируемого видео и повышение общей производительности модели.

Методы, такие как CausVid, используют дистилляцию знаний для создания более эффективных потоковых архитектур для авторегрессивной генерации видео. Дистилляция в данном контексте предполагает передачу знаний от более сложной, но точной модели («учителя») к более компактной и быстрой модели («ученику»). Это позволяет снизить вычислительные затраты и задержки, необходимые для обработки видеопотока в реальном времени, при этом сохраняя приемлемое качество генерируемого видео. Использование дистилляции позволяет CausVid эффективно обрабатывать последовательности кадров, минимизируя необходимость в ресурсоемких вычислениях на каждом шаге авторегрессивного процесса.

Внедренный метод Longer than Longer (LoL) значительно снижает эффект «sink-collapse». Экспериментальные данные демонстрируют уменьшение максимального значения Sink-Collapse (вычисляемого как нормализованное L2-расстояние) с 73.06 до существенно более низких показателей. Аналогично, среднее значение Sink-Collapse снижается с 30.54 до значительно меньших значений, что свидетельствует о повышении стабильности и эффективности удержания информации на протяжении длительных последовательностей кадров.

Измеряя иллюзию: Оценка качества и горизонты дальнейших исследований

Оценка качества генерируемых видеороликов, особенно продолжительных, требует использования специализированных бенчмарков, таких как VBench. Эти инструменты позволяют всесторонне анализировать не только визуальную составляющую, но и связность повествования, согласованность действий и общую логичность происходящего на экране. В то время как краткие видеофрагменты могут быть оценены субъективно, долговременная когерентность требует объективных метрик, предоставляемых подобными бенчмарками. VBench, в частности, позволяет выявлять и количественно оценивать недостатки в длительных видео, такие как повторяющиеся сцены или потеря логической нити повествования, что критически важно для создания реалистичных и захватывающих видеороликов большой продолжительности.

Оценка качества генерируемых видео большой длительности сопряжена с определенными сложностями, в частности, с тенденцией к повторению одних и тех же визуальных элементов или сюжетных ходов. Для количественной оценки этой проблемы был разработан показатель, получивший название “No-Repeat Score”. Данный показатель позволяет точно измерить, насколько успешно модель избегает повторений в течение продолжительного видеоряда, выявляя моменты, где генерация становится излишне цикличной или однообразной. Высокий показатель No-Repeat Score свидетельствует о способности модели поддерживать разнообразие и динамичность контента на протяжении всего видео, что особенно важно для создания реалистичных и увлекательных длинных видеороликов. Использование этого показателя позволяет разработчикам более эффективно оценивать и улучшать алгоритмы генерации, стремясь к созданию видео, лишенных монотонности и визуального шума.

Дальнейшие исследования направлены на интеграцию трехмерных вариационных автоэнкодеров, таких как 3D Causal VAE, поддерживаемых WAN-2.1, с целью улучшения временной причинности и реалистичности генерируемых видео. Такой подход позволяет модели более точно улавливать взаимосвязи между последовательными кадрами, предотвращая визуальные артефакты и создавая более правдоподобные и связные сцены. Использование трехмерных автоэнкодеров, в отличие от традиционных двухмерных, обеспечивает более полное представление о пространственно-временной структуре видео, что критически важно для генерации контента большой продолжительности, где даже небольшие несоответствия могут накапливаться и приводить к заметным дефектам. Ожидается, что данная технология существенно повысит качество и убедительность генерируемых видео, приближая их к уровню, неотличимому от реальных съемок.

В ходе проведенных исследований удалось значительно увеличить продолжительность генерируемого видеоряда, достигнув 12 часов непрерывного воспроизведения. Этот результат существенно превосходит предыдущие ограничения в данной области и открывает новые возможности для создания контента, не имеющего заранее определенной длительности. Разработанная система позволяет осуществлять потоковую генерацию видеоряда в режиме реального времени, что особенно актуально для таких приложений, как бесконечные визуальные фоны, динамические игровые миры и персонализированные развлекательные сервисы. Такая способность к неограниченной генерации видеоряда представляет собой важный шаг вперед в развитии технологий искусственного интеллекта и компьютерной графики.

В этой работе, как и во многих других, исследователи пытаются обуздать неуправляемую природу генеративных моделей. Авторы LoL, безусловно, добились прогресса в борьбе с коллапсом, но стоит помнить, что любая «революционная» технология рано или поздно превратится в технический долг. Как справедливо заметил Эндрю Ын: «Самое главное — это построить что-то, что работает, даже если это не идеально.» Потому что, как показывает практика, продакшен всегда найдёт способ сломать самую элегантную теорию, особенно когда речь идет о генерации видеопотоков длиной в час. В конце концов, всё новое — это старое, только с другим именем и теми же багами, просто теперь они проявляются в контексте ‘sink collapse’ и требуют новых, сложных решений.

Что дальше?

Предложенное решение проблемы «sink collapse» в авторегрессивной генерации видео, безусловно, отодвигает границу возможного. Однако, каждый новый уровень абстракции неизбежно порождает новый слой сложностей. Устранение одной проблемы лишь обнажает другую — теперь это не только поддержание когерентности во времени, но и обеспечение предсказуемости поведения модели при действительно неограниченной длине генерируемого потока. Кажется, что CI/CD теперь превращается в храм, где молятся о том, чтобы ни одна новая итерация не сломала хрупкое равновесие.

Внедрение RoPE-встраиваний и фазовой синхронизации — это лишь инструменты. Главный вопрос остаётся открытым: возможно ли вообще создать модель, способную генерировать бесконечное видео без неизбежных повторений или деградации качества? Скорее всего, нет. Любая «революционная» технология завтра станет лишь новым видом техдолга. И документация, как всегда, останется мифом, созданным менеджерами.

В будущем исследования, вероятно, сместятся в сторону более эффективных методов сжатия информации и поиска компромисса между качеством, скоростью и объёмом необходимых вычислительных ресурсов. И, возможно, кто-нибудь наконец попытается создать модель, которая намеренно генерирует «интересные» ошибки, а не стремится к недостижимому совершенству.

Оригинал статьи: https://arxiv.org/pdf/2601.16914.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Искусственный интеллект, который учится играть: новая платформа для стабильного обучения агентов

- Наука из текста: извлечение знаний из научных публикаций

- Самообучающиеся признаки: новый подход к машинному обучению

- Быстрый поиск похожих объектов: GPU-ускорение с IVF-RaBitQ

- Квантовая механика: скрытый детерминизм?

- Сплетение света и времени: аттосекундная спектроскопия на квантовых парах

- Искусственный интеллект: хрупкость визуального мышления

- Моделирование биомолекул: новый импульс от нейросетей

- Ruyi2: Семейство языковых моделей для эффективного обучения и развертывания

- Разумные агенты на страже жизни: Анализ физиологических данных в режиме реального времени

2026-02-01 09:57