Автор: Денис Аветисян

Новая работа исследует, как взаимодействие с ИИ может не просто автоматизировать решения, но и стимулировать более глубокий анализ и осмысление информации.

В статье представлена концепция AI-Assisted Critical Thinking (AACT) и её влияние на качество человеко-машинного взаимодействия в процессе принятия решений.

Несмотря на растущую распространенность совместного принятия решений человеком и искусственным интеллектом, производительность таких команд часто остается субоптимальной из-за недостаточной оценки логики рассуждений человека. В данной работе, посвященной исследованию ‘Understanding the Effects of AI-Assisted Critical Thinking on Human-AI Decision Making’, предложен фреймворк AI-Assisted Critical Thinking (AACT), направленный на улучшение качества человеческих решений путем стимулирования критического осмысления собственных умозаключений. Эксперименты показали, что AACT превосходит традиционные системы поддержки принятия решений на основе ИИ, снижая чрезмерную зависимость от автоматизированных советов, хотя и увеличивая когнитивную нагрузку. Каким образом можно оптимизировать AACT для снижения когнитивной нагрузки и максимизации его эффективности в различных контекстах принятия решений?

Пределы Интуиции: Распознавание Когнитивных Искажений

Человеческое принятие решений, даже при наличии достаточного объема информации, подвержено когнитивным искажениям — систематическим ошибкам, возникающим из-за упрощенных стратегий обработки данных. Эти искажения, проявляющиеся в различных формах, таких как предвзятость подтверждения или эвристика доступности, влияют на оценку вероятностей, интерпретацию фактов и, в конечном итоге, на выбор. Исследования показывают, что люди склонны искать информацию, подтверждающую их существующие убеждения, игнорируя или недооценивая противоречивые данные. Более того, легкодоступные примеры часто перевешивают статистически более значимые, приводя к нерациональным выводам. Таким образом, даже обладая всей необходимой информацией, мозг склонен к упрощениям и предвзятостям, что делает критическое мышление и осознание собственных когнитивных ограничений особенно важными.

Человеческий мозг, стремясь к экономии ресурсов, часто прибегает к когнитивным упрощениям — своеобразным «ярлыкам», позволяющим быстро оценивать ситуацию и принимать решения. Однако, несмотря на свою эффективность в повседневной жизни, эти упрощения могут приводить к неоптимальным результатам и систематическим ошибкам. Например, склонность к подтверждению своей точки зрения заставляет человека искать и интерпретировать информацию таким образом, чтобы она соответствовала его предубеждениям, игнорируя противоречащие факты. Или же эвристика доступности, когда вероятность события оценивается исходя из того, насколько легко вспоминаются примеры, может приводить к переоценке рисков, связанных с яркими или недавними событиями. В результате, даже обладая достаточной информацией, человек может принимать решения, основанные не на рациональном анализе, а на искажённом восприятии реальности, что в свою очередь может привести к нежелательным последствиям в различных сферах жизни.

В условиях растущей сложности принимаемых решений, возрастает необходимость в методах, которые не заменяют человеческое суждение, а усиливают его. Исследования показывают, что полная автоматизация часто приводит к потере важных нюансов и контекста, которые человек способен учитывать. Вместо этого, акцент делается на создании систем поддержки принятия решений, которые предоставляют релевантную информацию, выявляют потенциальные предубеждения и предлагают альтернативные точки зрения. Такой подход позволяет сочетать скорость и эффективность компьютерных вычислений с опытом, интуицией и критическим мышлением человека, обеспечивая более взвешенные и обоснованные результаты. Разработка подобных инструментов становится ключевой задачей для повышения качества принимаемых решений в различных областях — от медицины и финансов до управления и безопасности.

AACT: Разумный Помощник в Принятии Решений

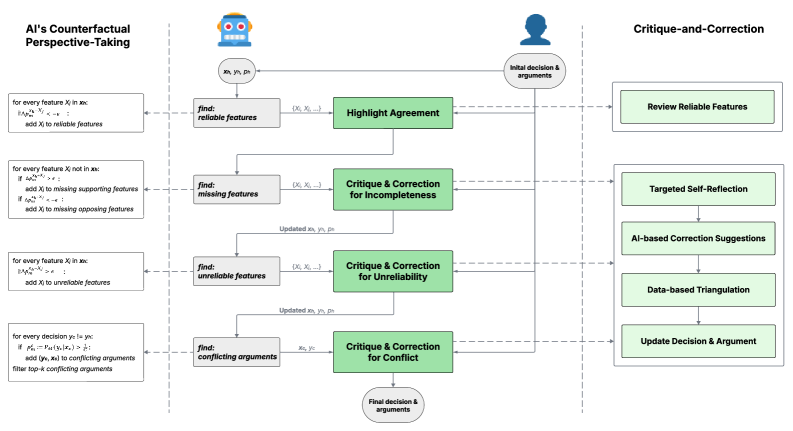

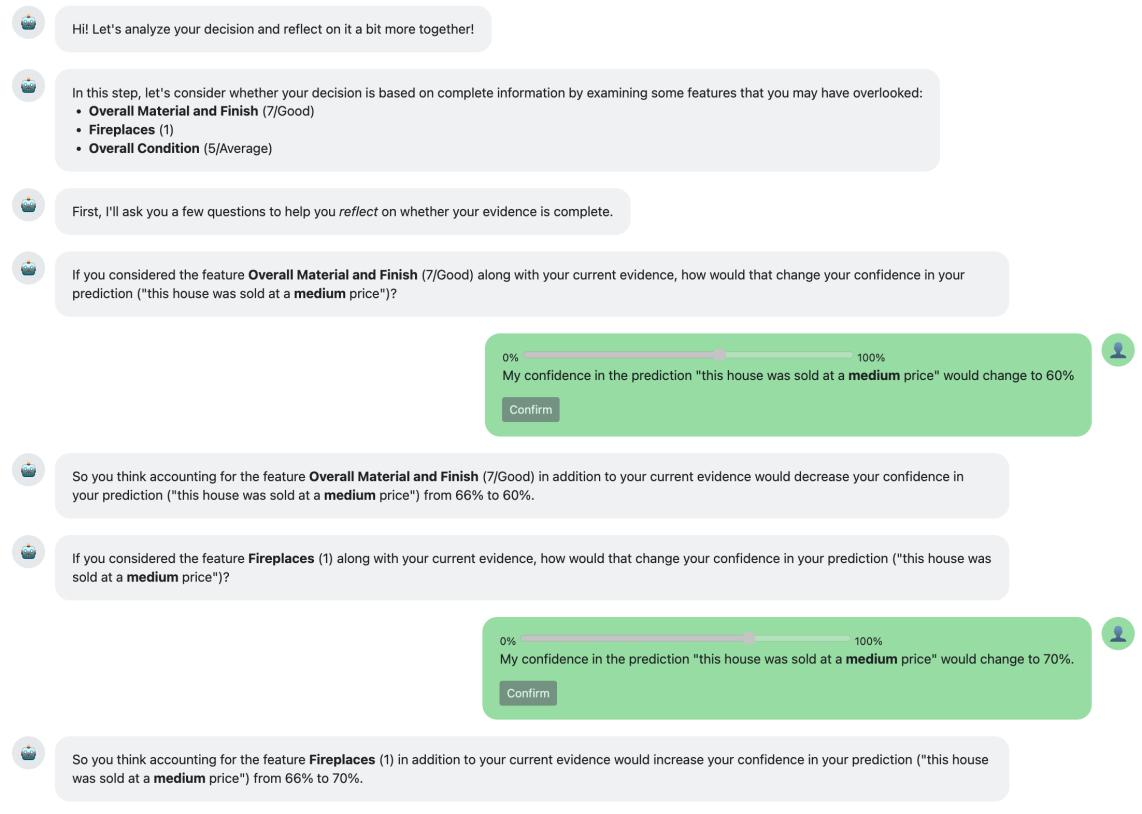

Фреймворк AACT (AI-Assisted Critical Thinking) предназначен для повышения качества принимаемых человеком решений за счет предоставления конструктивной критики и альтернативных точек зрения. В отличие от систем, просто предлагающих варианты, AACT фокусируется на анализе аргументации, лежащей в основе решения, выявляя потенциальные слабые места и пробелы. Это достигается путем предоставления обратной связи, основанной на логическом анализе и сопоставлении с известными фактами и принципами, что позволяет пользователю пересмотреть свои предположения и рассмотреть другие возможные подходы. В результате, AACT способствует более осознанному и обоснованному процессу принятия решений.

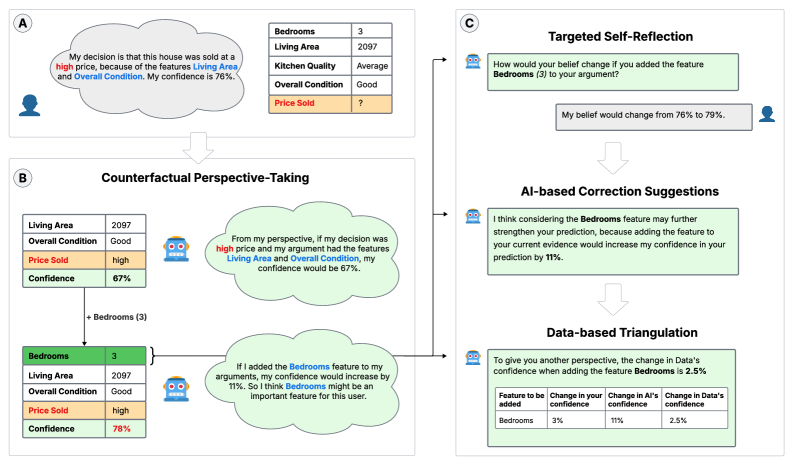

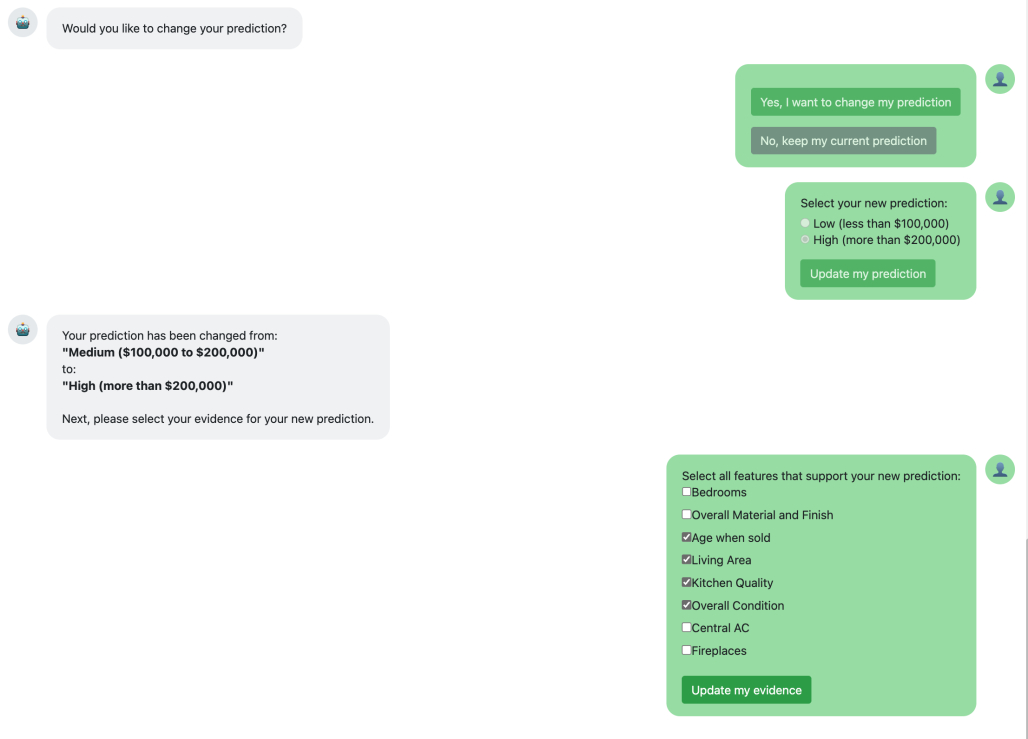

В основе фреймворка AACT лежит использование специализированного искусственного интеллекта для оценки аргументации, лежащей в основе принимаемых решений. Этот подход подразумевает применение методов, таких как CounterfactualPerspectiveTaking (рассмотрение альтернативных сценариев “что, если”), позволяющих ИИ выявлять потенциальные слабые места в логике, неполноту информации или упущенные возможности. Оценка аргументов производится на основе знаний, специфичных для конкретной предметной области, что обеспечивает более точный и релевантный анализ, чем универсальные модели ИИ. Метод CounterfactualPerspectiveTaking позволяет ИИ генерировать альтернативные интерпретации ситуации и оценивать, как изменение ключевых факторов повлияло бы на исход, тем самым предоставляя более полное представление о возможных последствиях принятого решения.

В основе фреймворка AACT лежит модель RecognitionMetacognition, представляющая собой когнитивный подход, фокусирующийся на осознании и оценке собственных мыслительных процессов. Эта модель обеспечивает динамический цикл оценки и улучшения принятия решений, включающий этапы распознавания проблемных зон в аргументации, самокритики и пересмотра исходных предпосылок. В рамках RecognitionMetacognition система AACT не просто предоставляет альтернативные точки зрения, но и стимулирует пользователя к рефлексии над собственным процессом рассуждений, что позволяет выявлять когнитивные искажения и повышать качество принимаемых решений. Цикл оценки и улучшения непрерывен, позволяя адаптироваться к меняющимся условиям и повышать эффективность принятия решений в долгосрочной перспективе.

Деконструкция Решений: Как Работает AACT на Практике

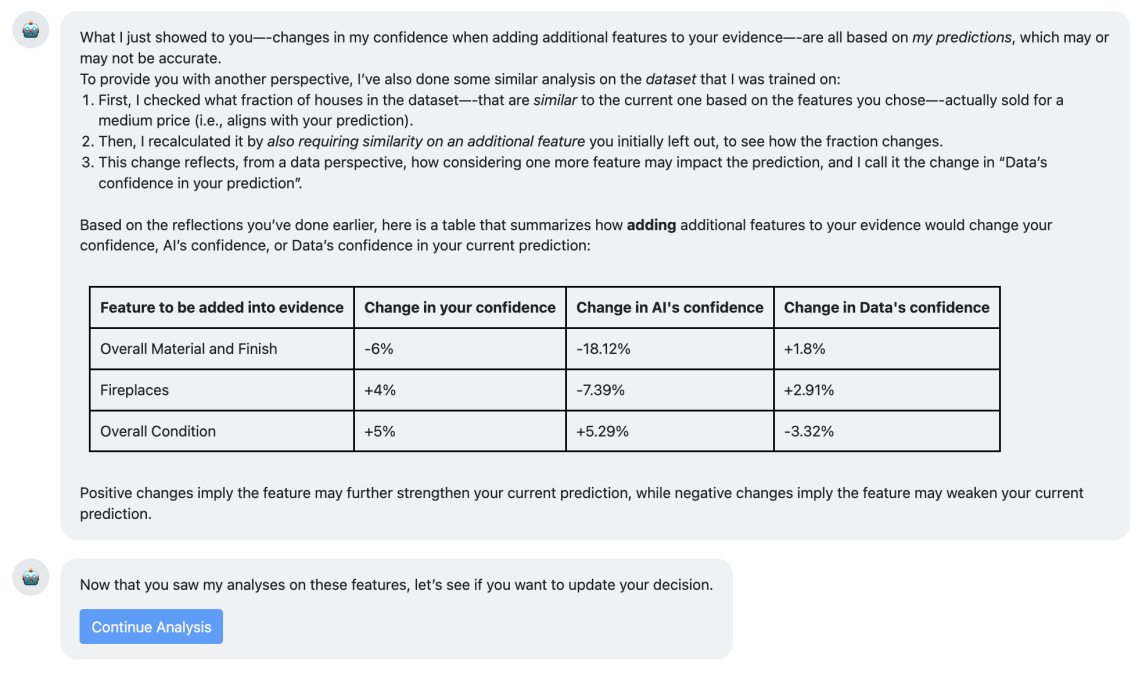

В основе работы AACT лежат методы AIExplanation и DataTriangulation, обеспечивающие прослеживаемость логики, лежащей в основе критических оценок. AIExplanation используется для извлечения и представления ключевых факторов, повлиявших на решение модели. DataTriangulation, в свою очередь, предполагает перекрестную проверку данных из различных источников для подтверждения обоснованности выявленных закономерностей и исключения ложных корреляций. Комбинация этих подходов позволяет AACT не просто констатировать наличие проблем, но и предоставлять детализированное объяснение причин, лежащих в основе этих проблем, что необходимо для эффективной корректировки и повышения качества работы ИИ.

В рамках AACT для проведения контрфактического анализа используется метод LIME (Local Interpretable Model-agnostic Explanations). LIME позволяет выявить, какие конкретно признаки (features) оказывают наибольшее влияние на оценку, выданную моделью машинного обучения. Анализ заключается в локальном приближении сложной модели линейной моделью, что позволяет определить, как изменение значений определенных признаков влияет на предсказание. Таким образом, LIME помогает определить ключевые факторы, определяющие решение модели, и обеспечивает возможность понимания причин, по которым модель пришла к определенному выводу.

Для демонстрации работы AACT в качестве примера был использован набор данных AmesHousingDataset в сочетании с моделью LogisticRegression. В ходе тестирования на отложенной выборке модель достигла точности 0.8737. Это позволяет оценить эффективность AACT в анализе и объяснении решений, принятых конкретной моделью машинного обучения на реальном наборе данных, характеризующем стоимость жилья.

Предоставление прозрачных объяснений является ключевым аспектом функционирования AACT, направленным на повышение уровня понимания пользователем логики работы искусственного интеллекта и укрепление доверия к его рекомендациям. Данный подход позволяет не просто получить результат, но и осознать, какие факторы повлияли на принятие решения ИИ, что критически важно для принятия обоснованных решений пользователем и для эффективного взаимодействия с системой. Прозрачность в работе ИИ способствует более широкому принятию и использованию технологий искусственного интеллекта в различных областях.

За Пределами Точности: Влияние AACT на Человеческое Суждение

Вместо того, чтобы заменять человеческое суждение, система AACT стремится усилить его, создавая процесс совместного принятия решений. В основе подхода лежит идея не автоматизации выбора, а предоставления человеку инструментов для более глубокого анализа ситуации и критической оценки различных факторов. AACT функционирует как партнер, предлагающий информацию и альтернативные перспективы, но окончательное решение всегда остается за человеком. Такой симбиоз позволяет использовать сильные стороны как искусственного интеллекта — скорость обработки данных и выявление закономерностей — так и человека — интуицию, креативность и способность учитывать контекст, который может быть недоступен алгоритмам. Данный подход направлен на создание более обоснованных и взвешенных решений, объединяющих возможности обеих сторон.

Система AACT стимулирует пользователей к целенаправленному самоанализу, побуждая их критически оценивать собственные предположения и предвзятости. Этот подход основан на идее, что принятие взвешенных решений требует осознания собственных когнитивных искажений. Вместо слепого доверия к алгоритмам, AACT предлагает инструменты для выявления и осмысления личных установок, которые могут влиять на интерпретацию данных и формирование суждений. Благодаря этому процессу саморефлексии, пользователи способны более объективно оценивать информацию, представленную искусственным интеллектом, и избегать ситуаций, когда автоматические рекомендации принимаются без должного осмысления или, напротив, отвергаются без веских причин. Такой механизм позволяет человеку оставаться активным участником процесса принятия решений, а не пассивным потребителем результатов машинного обучения.

В основе подхода, предложенного AACT, лежит принцип сохранения автономии принятия решений за человеком. Система не стремится заменить человеческий опыт и интуицию, а выступает в роли помощника, предоставляющего информацию и стимулирующего критическую оценку. Обеспечивая пользователю возможность самостоятельного анализа и учета собственных убеждений, AACT позволяет избежать слепого доверия к искусственному интеллекту. Такой симбиоз человека и машины способствует более взвешенным и обоснованным решениям, где окончательный выбор всегда остается за человеком, а не за алгоритмом.

Исследования показали, что разработанная система AACT способна снизить чрезмерную зависимость от искусственного интеллекта на 0.565 пункта по сравнению с использованием стандартных рекомендательных систем, особенно у участников без высшего образования. В процессе использования системы наблюдалось улучшение усвоения материала на 0.157 пункта, однако данный эффект не закрепился в итоговых результатах тестирования. Это указывает на то, что AACT способствует более осознанному взаимодействию с ИИ в моменте, однако для долгосрочного улучшения навыков необходимо дополнительное закрепление полученных знаний и опыта.

Предлагаемый фреймворк направлен на решение критически важной проблемы — избежание как чрезмерной зависимости от искусственного интеллекта, так и необоснованного недоверия к нему. Вместо того, чтобы просто повышать точность рекомендаций, система стремится к созданию сбалансированного подхода, где человек и ИИ работают в тандеме. Она позволяет пользователям критически оценивать предложенные решения, выявлять потенциальные ошибки или предвзятости, и принимать обоснованные решения, опираясь на собственные знания и опыт, а не слепо доверяя алгоритмам. Такой подход позволяет избежать ситуаций, когда человек безоговорочно принимает ошибочные рекомендации ИИ, а также упущенных возможностей из-за игнорирования полезных подсказок.

Исследование, представленное в статье, подчеркивает важность не просто принятия решений, предлагаемых искусственным интеллектом, но и глубокого осмысления собственной логики рассуждений. Это соответствует принципу, высказанному Барбарой Лисков: «Программы должны быть спроектированы таким образом, чтобы изменения в одной части не приводили к неожиданным последствиям в другой». Подобно тому, как хорошо спроектированная программа требует предвидения и контроля над взаимодействием компонентов, эффективное взаимодействие человека и ИИ требует от человека критической оценки предложений ИИ и осознания собственных когнитивных процессов. В рамках предложенной модели AACT, поощрение рефлексии и осознания собственных суждений позволяет избежать слепого доверия к ИИ и формировать более надежные и обоснованные решения.

Куда дальше?

Представленная работа, исследуя взаимодействие человека и искусственного интеллекта в процессе принятия решений, лишь приоткрывает завесу над сложной архитектурой когнитивных искажений. Разумеется, концепция “помощи в критическом мышлении” звучит как парадокс — ведь сама необходимость в “помощи” предполагает изначально некую слабость. Однако, интересно не столько устранение этой слабости, сколько её изучение, выявление закономерностей, позволяющих предсказывать и направлять человеческое мышление.

Очевидным направлением дальнейших исследований представляется углублённое изучение границ применимости предложенной концепции. До каких пределов можно полагаться на искусственный интеллект в качестве катализатора саморефлексии? Не приведёт ли чрезмерная зависимость от “внешнего” критического анализа к атрофии собственных когнитивных способностей? По сути, перед нами стоит задача создания системы, которая не просто помогает принимать решения, а учит думать о процессе принятия решений — своего рода “гимнастика для разума”.

И, конечно, не стоит забывать о необходимости расширения области применения данной концепции. Ограничиваясь рамками “поддержки принятия решений”, мы упускаем потенциал использования искусственного интеллекта для развития более глубокого понимания человеческой когнитивной архитектуры. В конце концов, взлом системы требует не только понимания её кода, но и знания принципов, по которым она была построена.

Оригинал статьи: https://arxiv.org/pdf/2602.10222.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Искусственный интеллект, который учится играть: новая платформа для стабильного обучения агентов

- Вероятностный компьютер на фотонных чипах: новая эра вычислений

- Моделирование биомолекул: новый импульс от нейросетей

- Наука из текста: извлечение знаний из научных публикаций

- Искусственный интеллект: хрупкость визуального мышления

- Наука на Автопилоте: Система для Самостоятельных Исследований

- Сплетение света и времени: аттосекундная спектроскопия на квантовых парах

- Ruyi2: Семейство языковых моделей для эффективного обучения и развертывания

- Биомолекулярные связи: новый тест для искусственного интеллекта

- Робот-исследователь: новый подход к автономной навигации

2026-02-12 18:45