Резонанс в самообучающихся осцилляторах: новый подход к выделению слабых сигналов

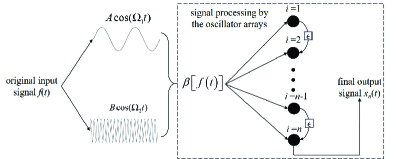

В статье представлена инновационная методика использования связанных самообучающихся осцилляторов для усиления слабых радиочастотных сигналов в условиях сильного шума.

В статье представлена инновационная методика использования связанных самообучающихся осцилляторов для усиления слабых радиочастотных сигналов в условиях сильного шума.

Новая техника позволяет крупным языковым моделям эффективно сохранять знания, получаемые в процессе обучения, не требуя огромных объемов памяти.

В новой статье рассматриваются инструменты Babel и ORION, призванные преодолеть разрыв между теоретическими принципами FAIR и реальным обменом данными между различными системами.

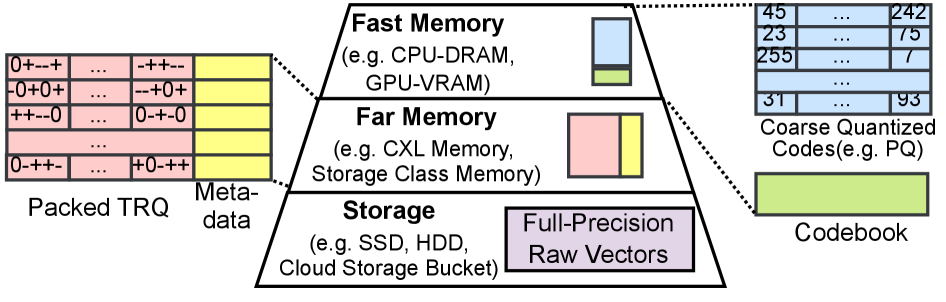

Новый подход к поиску ближайших соседей позволяет значительно снизить затраты на ввод-вывод данных и повысить скорость работы с векторными представлениями текстов.

Новое исследование раскрывает алгоритмическую природу «косой» доминирующей структуры в механизмах внимания, объясняя её связь с кодированием позиций и эффективностью представления токенов.

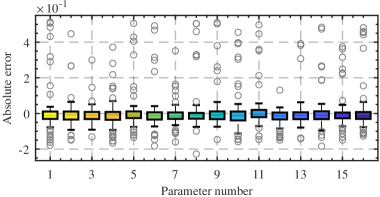

Новый подход позволяет в реальном времени определять управляющие уравнения сложных систем, учитывая неизбежные погрешности и нелинейности.

В статье исследуется, как решения задач о препятствиях, зависящих от времени и использующих нелокальные операторы, ведут себя с течением времени.

Исследователи представили метод V-DPM, позволяющий воссоздавать движущиеся трехмерные сцены из видео с беспрецедентной детализацией и точностью.

Новый подход к генерации научных статей с использованием обучения с подкреплением позволяет создавать более последовательные и аргументированные тексты.

Новая схема CEPAM позволяет значительно снизить затраты на передачу данных при федеративном обучении, не жертвуя при этом конфиденциальностью пользовательских данных.