Когда точность встречается с эффективностью: новый взгляд на низкобитовую квантизацию

Как переход к мелкозернистой целочисленной квантизации может превзойти традиционные форматы с плавающей точкой по точности и аппаратной эффективности.

Как переход к мелкозернистой целочисленной квантизации может превзойти традиционные форматы с плавающей точкой по точности и аппаратной эффективности.

Как архитектура DUST с двойным потоком и отсоединенным обучением позволяет создавать более эффективные модели для обучения роботов, используя многомодальные данные и причинно-следственные связи.

Как большие языковые модели преобразуются в персональных консультантов, способных предлагать релевантные товары и услуги в ходе естественной беседы.

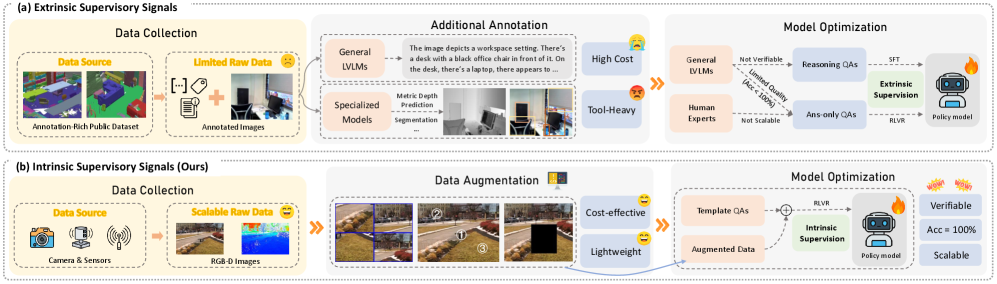

Как алгоритмы самообучения с подкреплением позволяют большим моделям лучше понимать 3D-сцены и пространственные взаимосвязи.

Как современные Vision-Language модели обрабатывают информацию о положении объектов на изображении и текста, и какие улучшения можно внести в эту систему.

Как обучение с подкреплением и проверяемыми наградами (RLVR) улучшает решение математических задач, но может приводить к освоению поверхностных эвристик вместо истинного рассуждения.

Как механизм внимания высшего порядка позволяет эффективно моделировать длинные контексты, сохраняя при этом возможность параллельных вычислений и потоковой обработки.

Как Continuous Autoregressive Language Models (CALM) переходят от дискретной генерации токенов к непрерывному векторному пространству, увеличивая пропускную способность семантики и улучшая производительность.

Как модель ThinkMorph, объединяя текстовую и визуальную обработку, демонстрирует неожиданные способности к визуальным манипуляциям и улучшает масштабируемость в задачах рассуждения.

Обзор современных подходов к созданию Vision-Language-Action моделей, позволяющих снизить вычислительные затраты и потребность в больших объемах данных для обучения.