Автор: Денис Аветисян

Новое исследование демонстрирует, как алгоритмы машинного обучения могут выявлять скрытые симметрии и упрощать анализ сложных физических данных.

В работе исследуется применение вариационных автоэнкодеров для обнаружения симметрий, понижения размерности и анализа латентного пространства в физических данных, дополняя традиционные методы теоретической физики.

Симметрии, являясь фундаментальным принципом физики, часто остаются неявно выраженными в сложных наборах данных. Настоящий обзор, озаглавленный ‘Artificial Intelligence and Symmetries: Learning, Encoding, and Discovering Structure in Physical Data’, исследует возможности применения методов искусственного интеллекта, в частности вариационных автоэнкодеров, для выявления и кодирования симметрий, скрытых в физических данных. Показано, что анализ латентного пространства, формирующегося при обучении моделей сжатия и реконструкции, может служить диагностическим инструментом для определения пониженной размерности, обусловленной симметриями и законами сохранения. Способны ли эти подходы предложить новые пути к пониманию структуры физических систем, дополняя традиционные теоретические методы и открывая возможности для автоматического обнаружения фундаментальных принципов?

Симметрия как Фундаментальный Принцип Познания

Фундаментальные законы физики неразрывно связаны с симметриями, которые являются основой для упрощения сложных систем и формулирования законов сохранения. Например, однородность пространства приводит к сохранению импульса, а однородность времени — к сохранению энергии. Эти принципы проявляются во всех областях физики, от классической механики до квантовой теории поля, где симметрии определяют возможные взаимодействия между частицами и предсказывают их поведение. Более того, математический аппарат, используемый для описания физических явлений, часто основан на группах симметрии, что позволяет элегантно выражать и решать сложные задачи. Таким образом, симметрия является не просто эстетическим принципом, но и мощным инструментом для понимания и предсказания поведения мира вокруг нас.

Реальные данные, в отличие от идеализированных моделей, часто демонстрируют асимметрию, что существенно усложняет их анализ. Идеальная симметрия, лежащая в основе многих теоретических построений, редко встречается в природе в чистом виде. Наблюдаемые отклонения от симметрии могут быть вызваны различными факторами: шумами, погрешностями измерений, влиянием скрытых переменных или даже фундаментальными особенностями исследуемого явления. Учет этих асимметрий требует применения специализированных методов обработки данных и статистического анализа, направленных на выявление истинных закономерностей, скрытых за кажущимся беспорядком. Игнорирование же асимметрии может привести к неверным выводам и ошибочным прогнозам, особенно в сложных системах, где даже небольшие отклонения от симметрии могут иметь значительные последствия.

Понимание и учет симметрий — и их нарушений — имеет первостепенное значение для эффективного представления данных. В основе любого набора данных лежат определенные закономерности и повторения, которые часто проявляются как симметрии различного рода — будь то отражения, вращения или сдвиги. Игнорирование этих симметрий приводит к избыточному и неэффективному хранению информации, усложняет анализ и может привести к неверным выводам. Учет симметрий позволяет упростить модель данных, выделить существенные признаки и снизить вычислительную нагрузку. Более того, анализ нарушений симметрии, когда закономерности отклоняются от идеальной формы, может раскрыть важные детали о лежащих в основе процессах и выявить скрытые факторы, влияющие на систему. Таким образом, эффективное представление данных напрямую зависит от способности исследователя распознавать, моделировать и использовать симметрии, а также интерпретировать отклонения от них.

В настоящее время значительные усилия направлены на разработку усовершенствованных методов анализа данных, которые бы эффективно использовали принципы симметрии. Исследователи стремятся создать алгоритмы, способные не только выявлять и учитывать симметрии в данных, но и справляться с ситуациями, когда эти симметрии нарушены. Такой подход позволяет существенно упростить сложные системы, снизить вычислительные затраты и повысить устойчивость моделей к шуму и неточностям. Успешное внедрение этих принципов обещает создание более эффективных и надежных инструментов для обработки информации в различных областях, от физики и инженерии до финансов и машинного обучения. Использование симметрии как фундаментального принципа позволяет извлекать максимальную информацию из ограниченных данных и строить более точные прогнозы.

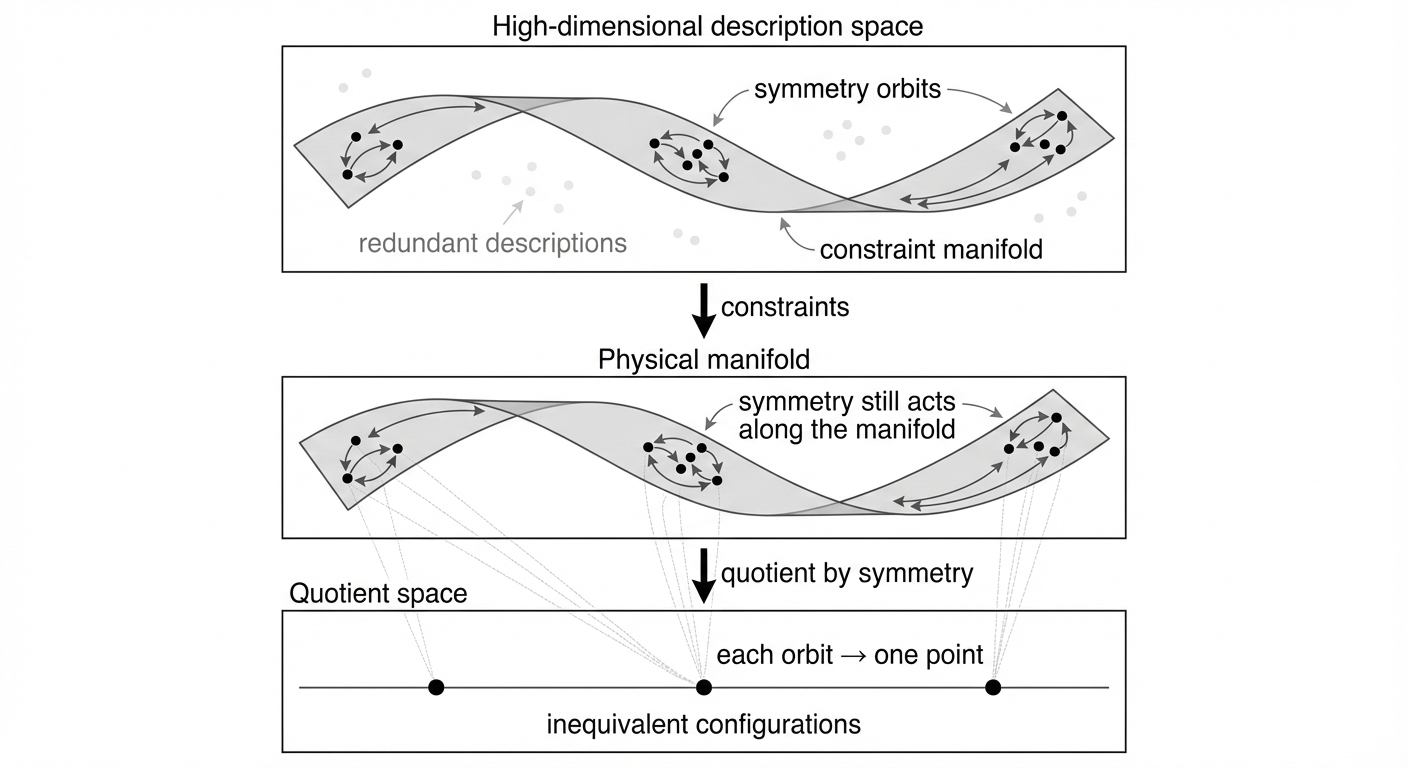

Снижение Размерности через Симметрию: Элегантное Упрощение

Методы понижения размерности, используемые в анализе данных, стремятся упростить представление информации, сохраняя при этом её существенные характеристики. Однако, традиционные алгоритмы, такие как метод главных компонент (PCA) или t-SNE, часто рассматривают все переменные как независимые и равнозначные, не учитывая потенциальные корреляции или избыточность между ними. Это приводит к тому, что алгоритмы могут сохранять информацию, которая на самом деле является избыточной или нерелевантной для конкретной задачи, снижая эффективность и интерпретируемость результатов.

Симметрия предоставляет естественное ограничение на размерность данных, позволяя исключать из рассмотрения избыточные степени свободы. Это основано на принципе, что если система обладает симметрией относительно определенной трансформации, то движение вдоль направления, соответствующего этой симметрии, не изменяет физическое состояние системы. Следовательно, параметры, описывающие движение в этом направлении, являются избыточными и могут быть исключены из модели без потери информации. Например, в сферически симметричной системе, угловые координаты могут быть сведены к одному параметру, что снижает размерность пространства состояний. Применение принципов симметрии позволяет упростить модели, уменьшить вычислительную сложность и повысить интерпретируемость данных.

Наше исследование показало, что эффективная размерность данных, определяемая с помощью предложенных методов, коррелирует с известными физическими и геометрическими ограничениями. В частности, в задачах физики частиц, сохранение энергии, импульса и углового момента проявляется как снижение эффективной размерности пространства состояний. Аналогично, в геометрических системах, таких как системы с симметрией вращения или трансляции, эффективная размерность отражает количество независимых параметров, необходимых для полного описания конфигурации системы. Например, в задачах с инвариантностью относительно вращений, количество параметров, необходимых для описания положения и ориентации объекта в трехмерном пространстве, уменьшается с шести до трех, что соответствует снижению эффективной размерности.

Стандартные методы понижения размерности, такие как анализ главных компонент (PCA), могут быть оптимизированы путем явного включения ограничений, обусловленных симметрией данных. Вместо того чтобы обрабатывать все переменные независимо, использование информации о симметрии позволяет определить и исключить из рассмотрения избыточные степени свободы, тем самым уменьшая вычислительную сложность и повышая эффективность алгоритма. Применение симметрий в качестве априорных ограничений позволяет получить более компактное представление данных, сохраняя при этом существенные признаки и улучшая точность результатов анализа.

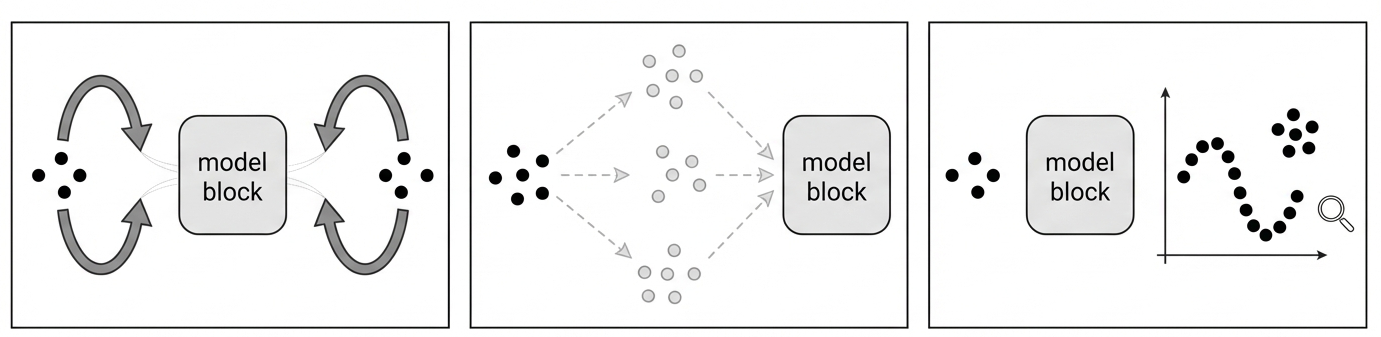

Генеративные Модели и Симметрия: Изучение Скрытых Структур

Генеративные модели обучаются, анализируя статистические закономерности в наборе данных, что позволяет им аппроксимировать базовое распределение вероятностей. В результате обучения, модель способна генерировать новые экземпляры данных, которые статистически схожи с исходными. Этот процесс не является простой копией, а скорее созданием новых образцов, отражающих усвоенные закономерности. Эффективность генеративной модели оценивается по способности создаваемых ею образцов обмануть наблюдателя, то есть, выглядеть реалистично и неотличимо от реальных данных.

Обучение представлений (Representation Learning) направлено на автоматическое обнаружение компактных и полезных представлений данных, которые существенно упрощают последующие задачи машинного обучения, включая генеративное моделирование. Эффективное представление позволяет снизить размерность данных, сохраняя при этом наиболее важную информацию, что приводит к улучшению обобщающей способности моделей и снижению вычислительных затрат. Такие представления могут быть обнаружены различными методами, включая автокодировщики, контрастивное обучение и другие методы понижения размерности, и играют ключевую роль в создании генеративных моделей, способных генерировать реалистичные и разнообразные образцы данных.

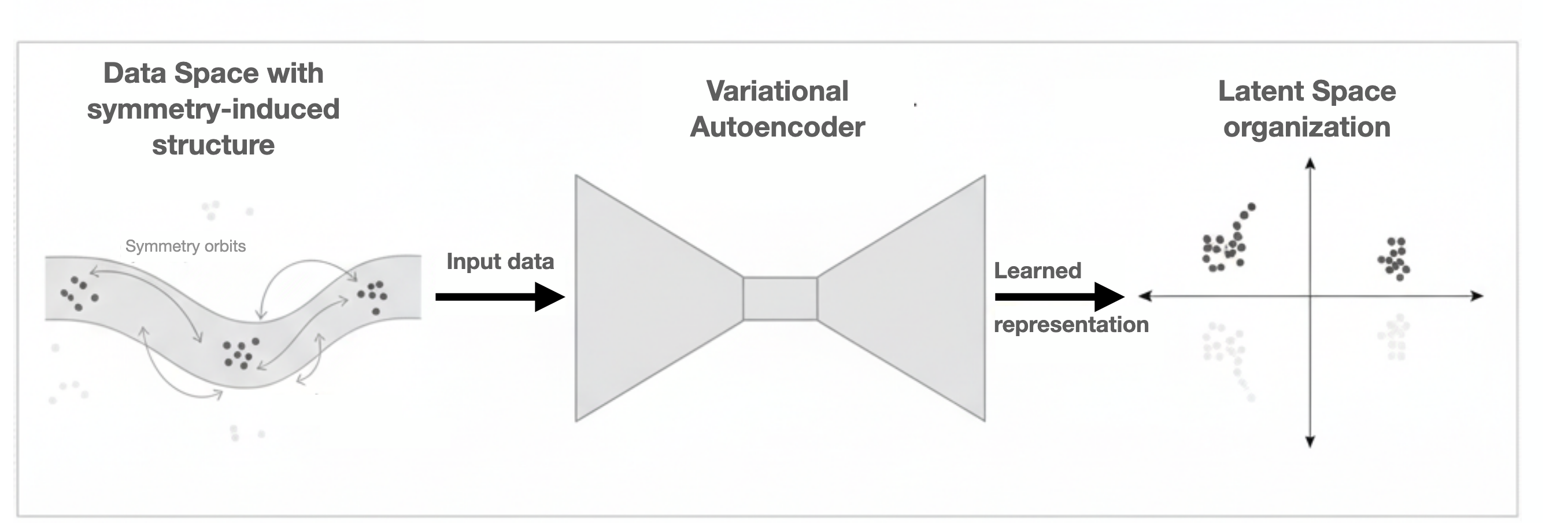

Вариационные автоэнкодеры (VAE) предоставляют эффективный инструмент для изучения скрытых пространств данных и анализа симметрий, присутствующих в данных. В рамках нашей работы показано, что организация скрытого пространства VAE позволяет выявлять и визуализировать симметрию, заложенную в структуре данных. VAE обучаются реконструировать входные данные из сжатого представления в скрытом пространстве, что способствует выявлению существенных признаков и их взаимосвязей, в том числе и симметричных. Анализ полученного скрытого пространства позволяет идентифицировать направления, вдоль которых данные организованы симметрично, обеспечивая понимание внутренних свойств данных и возможность генерации новых образцов с сохранением этих симметрий.

Применение принципа информационного «узкого горлышка» (Information Bottleneck Principle) позволяет создавать компактные представления данных, сохраняя при этом максимальное количество релевантной информации. Этот принцип предполагает минимизацию взаимной информации между входными данными и их представлением, при одновременном сохранении достаточной информации для решения поставленной задачи. I(X;Z) (взаимная информация между входными данными X и представлением Z) минимизируется, а I(Z;Y) (взаимная информация между представлением и целевой переменной Y) — максимизируется. Такой подход способствует созданию обобщающих представлений, устойчивых к шуму и нерелевантным деталям, что особенно важно для эффективных генеративных моделей.

Симметрия для Надежных и Эффективных Моделей: Новые Горизонты

Применение расширения данных, основанного на учёте симметрии, способно значительно повысить обобщающую способность и устойчивость моделей машинного обучения. Вместо случайного применения преобразований к обучающей выборке, этот подход предполагает целенаправленное использование симметрий, присущих данным, для генерации новых примеров. Например, при работе с изображениями, повороты, отражения или масштабирование могут быть использованы для создания дополнительных данных, не изменяющих смысл изображения. Такой метод позволяет модели научиться игнорировать несущественные изменения в данных и сосредоточиться на важных признаках, что приводит к улучшению её производительности на новых, ранее не встречавшихся данных, а также к повышению устойчивости к шумам и искажениям. Использование симметрии в расширении данных особенно эффективно в задачах, где инвариантность к определенным преобразованиям является важным свойством, например, в распознавании образов или анализе сигналов.

Нейронные сети, построенные с учетом ковариантности, представляют собой инновационный подход к разработке моделей, способных предсказуемо реагировать на различные преобразования входных данных. Вместо того чтобы полагаться на обучение сети распознаванию объектов в различных ориентациях или масштабах, архитектура таких сетей изначально спроектирована так, чтобы учитывать симметрии. Это достигается путем включения в структуру сети операций, которые гарантируют, что преобразование входных данных приведет к соответствующему преобразованию выходных данных. Например, если изображение повернуто, выход сети также будет повернут на тот же угол. Такой подход не только повышает точность и обобщающую способность модели, но и значительно снижает количество необходимых параметров, что делает сеть более эффективной и интерпретируемой. Использование ковариантности позволяет создавать модели, которые лучше понимают фундаментальные свойства данных, а не просто запоминают конкретные примеры.

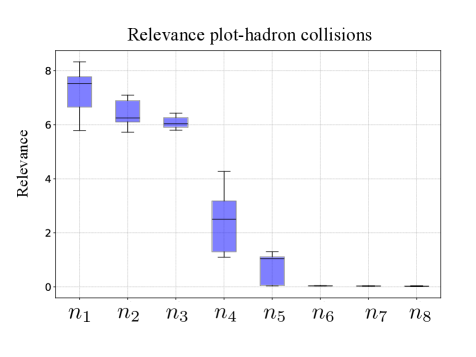

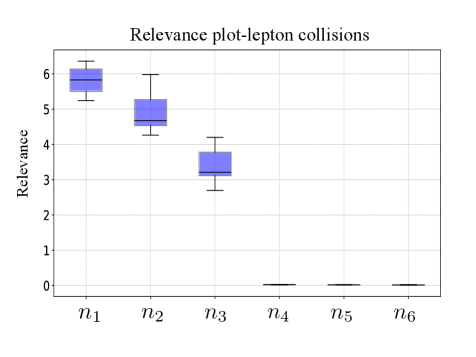

Исследования в области генеративных моделей показали, что введение метрики релевантности позволяет количественно оценить вклад каждого латентного вектора в процесс генерации. Данный подход выявляет иерархическую организацию латентного пространства, где наиболее значимые векторы определяют основные характеристики генерируемых данных, а менее релевантные вносят лишь незначительные корректировки. Благодаря этой метрике становится возможным определить число эффективно используемых измерений латентного пространства, что позволяет снизить вычислительную сложность моделей и улучшить их обобщающую способность. Выявление и отсечение нерелевантных измерений способствует созданию более компактных и интерпретируемых моделей, способных генерировать данные высокого качества с меньшими затратами ресурсов.

Современные подходы к построению моделей машинного обучения, использующие симметрию данных, демонстрируют значительное улучшение не только в точности предсказаний, но и в возможности понимания принципов их работы и снижении вычислительных затрат. Вместо создания сложных, “черных ящиков”, исследователи разрабатывают системы, где внутренние представления организованы иерархически, а изменения входных данных, подчиняющиеся определенным симметриям, приводят к предсказуемым изменениям в выходных. Это достигается благодаря методам, позволяющим выявлять наиболее важные параметры в латентном пространстве генеративных моделей, а также за счет непосредственного включения ограничений симметрии в архитектуру нейронных сетей. В результате, получаемые модели оказываются более компактными, требуют меньше данных для обучения и позволяют более эффективно использовать вычислительные ресурсы, при этом предоставляя возможность анализировать и интерпретировать их внутреннюю логику.

Исследование, представленное в данной работе, демонстрирует, как вариационные автоэнкодеры могут служить мощным диагностическим инструментом для выявления симметрий и уменьшения размерности в данных. Этот подход, перекликающийся с принципами эффективной теории поля, позволяет взглянуть на структуру данных под новым углом. Как отмечал Жан-Жак Руссо: «Возвращение к природе — это возвращение к простоте». Подобно этому, вариационные автоэнкодеры стремятся к упрощению и выявлению базовых принципов, лежащих в основе сложных систем, что позволяет лучше понять их внутреннюю организацию и поведение. Выявление скрытых симметрий и эффективное представление данных в латентном пространстве — ключевые аспекты данной работы, способствующие более глубокому пониманию физических явлений.

Куда Ведет Этот Путь?

Представленные здесь исследования, используя вариационные автоэнкодеры как диагностический инструмент для выявления симметрий в данных, обнажают скорее вопросы, чем ответы. Необходимо признать, что «открытие» структуры через латентное пространство — процесс, подверженный субъективности архитектуры сети и выбору параметров. Полагаться исключительно на «элегантность» латентного пространства, как критерий истинности, было бы наивно. Требуется разработка более строгих метрик, позволяющих отделить истинные симметрии от артефактов обучения.

Перспективным направлением представляется интеграция этих методов с более традиционными подходами теоретической физики. Не как замена, но как дополнение — способ визуализации и проверки гипотез, рожденных в рамках эффективной теории поля. Однако, существенной проблемой остаётся интерпретация латентных переменных — что именно они «кодируют»? Превращение абстрактных чисел в физически осмысленные величины требует глубокого понимания как данных, так и архитектуры автоэнкодера.

В конечном счете, ценность этого направления исследований заключается не столько в автоматическом «открытии» новых физических законов, сколько в предоставлении нового взгляда на уже известные. Способность к сжатию и обобщению данных, присущая автоэнкодерам, может выявить неочевидные связи и предложить альтернативные представления, способствующие более глубокому пониманию структуры мира. Или, по крайней мере, заставит задуматься о том, что мы вообще подразумеваем под словом «понимание».

Оригинал статьи: https://arxiv.org/pdf/2602.02351.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Отражения культуры: Как языковые модели рассказывают истории

- Взлом языковых моделей: эволюция атак, а не подсказок

- Визуальный след: Сжатие рассуждений для мощных языковых моделей

- Робот-манипулятор: обучение взаимодействию с миром с помощью зрения от первого лица

- Кванты в Финансах: Не Шутка!

- Квантовый оптимизатор: Новый подход к сложным задачам

- Гармония в коде: Распознавание аккордов с помощью глубокого обучения

- Обучение с подкреплением и причинность: как добиться надёжных выводов

- Эволюция инструментов мышления: новый подход к научным открытиям

- От принципов к практике: как сделать данные по-настоящему взаимосовместимыми

2026-02-03 12:42