Автор: Денис Аветисян

Новый анализ 30 передовых AI-систем раскрывает ключевые тенденции в области прозрачности, безопасности и оценки автономных агентов.

Подробный отчет о технических и защитных характеристиках развернутых агентических AI-систем.

Несмотря на стремительное развитие автономных систем искусственного интеллекта, отслеживание их технических характеристик и мер безопасности представляет собой сложную задачу. В работе ‘The 2025 AI Agent Index: Documenting Technical and Safety Features of Deployed Agentic AI Systems’ представлен детальный анализ 30 передовых AI-агентов, позволяющий оценить текущие тенденции в области прозрачности, безопасности и оценки их возможностей. Полученные данные свидетельствуют о существенных различиях в готовности разработчиков делиться информацией о принципах работы и потенциальном влиянии создаваемых систем. Какие шаги необходимы для обеспечения большей открытости и ответственной разработки автономных AI-агентов в будущем?

Раздвигая границы возможного: Новая парадигма агентного ИИ

Традиционные системы искусственного интеллекта зачастую сталкиваются с трудностями при решении сложных, многоступенчатых задач, требующих адаптивности и проактивного подхода к решению проблем. В отличие от систем, реагирующих исключительно на заданные входные данные, они испытывают ограничения в ситуациях, где необходимо планирование, самокоррекция и принятие решений на основе неполной или меняющейся информации. Ограниченность в способности к обобщению опыта и применению знаний в новых контекстах приводит к тому, что такие системы не способны эффективно функционировать в динамичных и непредсказуемых средах, требующих гибкости и самостоятельности в процессе решения поставленных задач. В результате, сложные проекты, требующие последовательного выполнения нескольких этапов и постоянной адаптации к изменяющимся условиям, оказываются за пределами возможностей традиционных подходов к искусственному интеллекту.

В отличие от традиционных систем искусственного интеллекта, которые ограничены реакцией на заданные запросы, агентные системы ИИ предлагают принципиально новый подход, позволяя им самостоятельно планировать и выполнять сложные задачи. Эти системы способны не просто генерировать ответы, но и действовать автономно, принимая решения и адаптируясь к изменяющимся обстоятельствам без постоянного вмешательства человека. Они способны декомпозировать большие цели на последовательность шагов, используя инструменты и ресурсы для достижения желаемого результата, что делает их эффективными в решении проблем, требующих проактивности и гибкости. Такой переход к автономным агентам открывает возможности для автоматизации широкого спектра задач, ранее требовавших значительного человеческого участия, и знаменует собой качественно новый этап в развитии искусственного интеллекта.

Переход к агентивным системам искусственного интеллекта обуславливает необходимость глубокого понимания их возможностей и ограничений, а также потенциального влияния на различные сферы деятельности. Систематическая оценка становится критически важной для выявления слабых мест, предвидения непредвиденных последствий и обеспечения безопасного и эффективного применения. Подобный анализ должен включать в себя не только технические аспекты, такие как точность и скорость работы, но и этические соображения, связанные с автономностью принятия решений и потенциальной предвзятостью. Тщательное исследование позволит определить границы применимости этих систем, оптимизировать их производительность и минимизировать риски, связанные с их внедрением в реальные условия.

В связи с растущим распространением автономных систем искусственного интеллекта, исследование, охватившее анализ тридцати различных агентных систем, выявило острую необходимость в стандартизированных методах оценки их надежности и производительности. Отсутствие единого подхода к тестированию и проверке этих систем затрудняет прогнозирование их поведения в реальных условиях и создает риски, связанные с непредсказуемыми ошибками или нежелательными последствиями. Разработка универсальной системы оценки, учитывающей различные аспекты — от способности к планированию и решения проблем до этичности и безопасности — представляется критически важной задачей для обеспечения ответственного внедрения и широкого применения агентного ИИ в различных сферах жизни.

Систематическая оценка: Анализ возможностей агентов

Индекс AI Agent представляет собой структурированную методологию сбора и анализа информации об различных системах искусственного интеллекта, работающих как агенты. Данный индекс обеспечивает последовательный подход к оценке возможностей, функциональности и степени прозрачности этих систем. Методология включает в себя стандартизированные критерии оценки, позволяющие сравнивать и сопоставлять характеристики различных агентов, что необходимо для всестороннего понимания текущего состояния и тенденций развития данной области. Этот структурированный подход позволяет проводить объективную оценку и выявлять сильные и слабые стороны различных агентных систем.

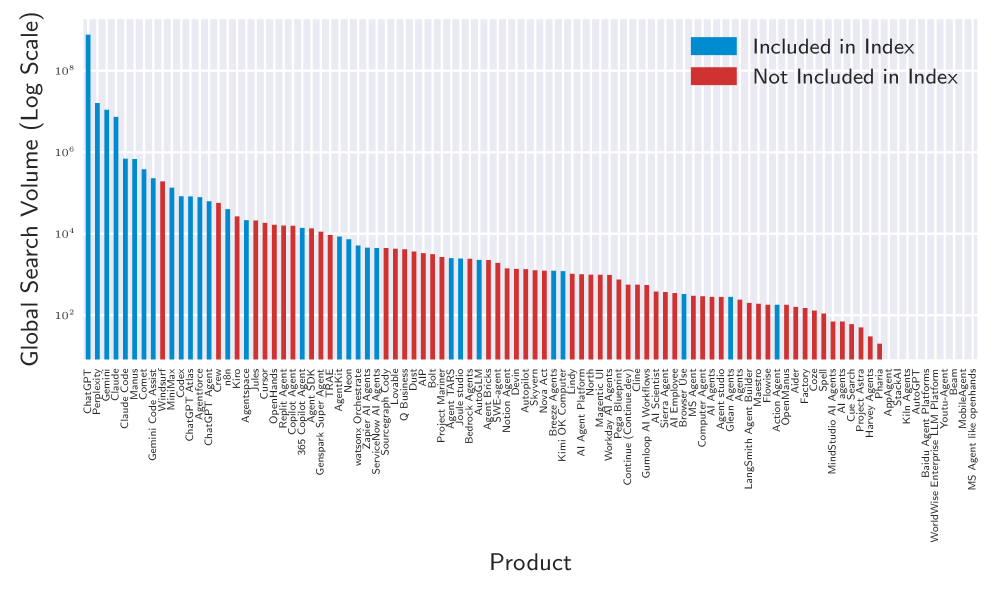

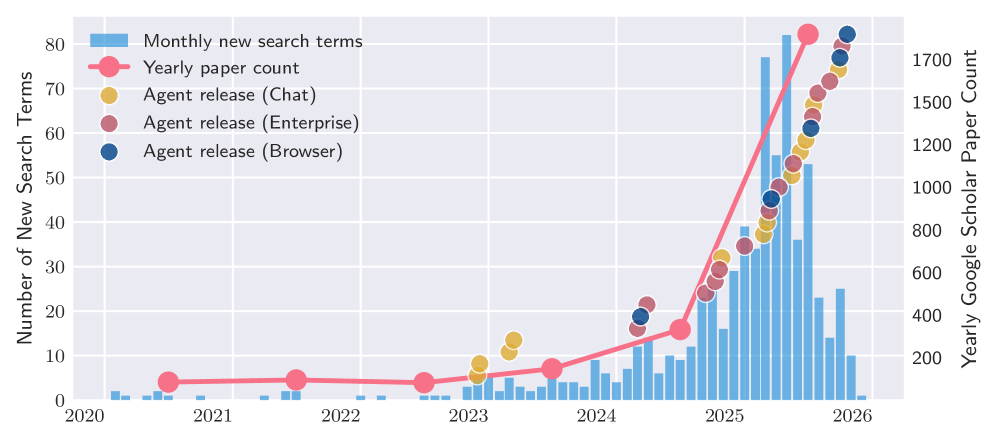

Для оценки популярности и уровня принятия различных платформ агентского ИИ используется метод анализа объёма поисковых запросов. Согласно данным индекса, наиболее популярный проиндексированный агент демонстрирует пиковый ежемесячный объём поисковых запросов в размере 349 518. Данный показатель позволяет количественно оценить интерес общественности и степень вовлеченности пользователей к конкретным решениям в области агентского ИИ, служа индикатором их текущей рыночной позиции и потенциала дальнейшего роста.

Оценка прозрачности является ключевым компонентом ‘Индекса AI-агентов’, направленным на анализ доступности и понятности информации о процессе разработки и функционирования систем искусственного интеллекта. Данная оценка включает в себя анализ документации, открытых исходных кодов (при наличии), а также доступности информации о данных, используемых для обучения моделей. Прозрачность оценивается по ряду критериев, позволяющих определить, насколько легко пользователям и исследователям понять принципы работы агента, его ограничения и потенциальные риски. Результаты оценки прозрачности используются для сравнения различных AI-агентов и выявления систем, предоставляющих наиболее полную и доступную информацию о своей работе.

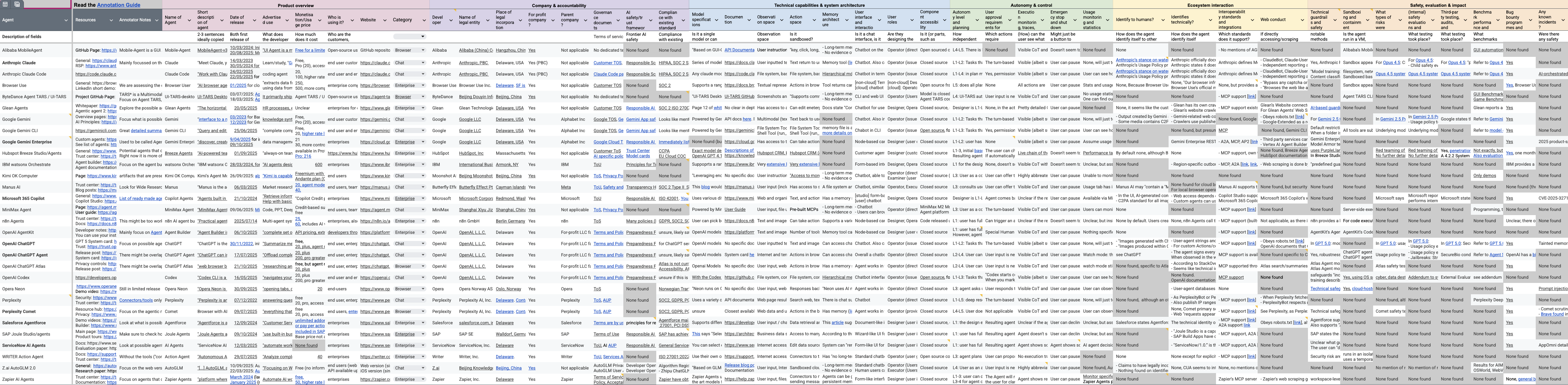

Систематическая оценка возможностей агентов искусственного интеллекта осуществляется посредством анализа по 45 параметрам (аннотациям) для каждого агента. Данный подход позволяет сопоставлять функциональные характеристики, такие как возможности планирования, использования инструментов и обучения, с уровнем прозрачности системы — доступностью информации о процессе разработки, используемых данных и ограничениях. Такое структурированное сравнение предоставляет возможность объективно оценить текущее состояние и тенденции развития в области агентного ИИ, выявляя сильные и слабые стороны различных платформ и способствуя более осознанному выбору и применению этих технологий.

Смягчение рисков: Обеспечение безопасности и доверия к агентам

Оценка безопасности является критически важным компонентом ответственной разработки искусственного интеллекта. Она включает в себя систематическую идентификацию потенциальных рисков и негативных последствий, таких как предвзятость в алгоритмах, непреднамеренные действия или уязвимости, которые могут привести к нежелательным результатам. Процесс оценки безопасности предполагает анализ данных, используемых для обучения моделей, архитектуры самой модели и контекста ее применения. Целью является минимизация вероятности возникновения вреда и обеспечение соответствия системы этическим нормам и требованиям регуляторов. Выявление этих рисков на ранних этапах разработки позволяет внести коррективы и снизить вероятность реализации негативных сценариев.

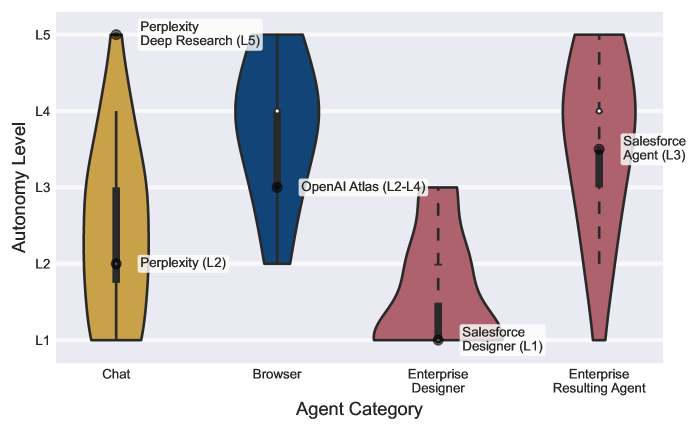

Оценка безопасности и потенциальных рисков, связанных с внедрением ИИ-агентов, неразрывно связана с определением их уровня автономии — степени независимости в принятии решений и выполнении действий. Чем выше уровень автономии агента, тем сложнее прогнозировать все возможные последствия его работы и тем критичнее становится тщательная оценка его поведения в различных сценариях. Низкий уровень автономии, предполагающий постоянный контроль со стороны человека, снижает риски, но ограничивает возможности агента. Высокий уровень автономии требует более сложных механизмов обеспечения безопасности, включая формальную верификацию, тестирование в условиях, приближенных к реальным, и разработку механизмов контроля и вмешательства в случае возникновения нештатных ситуаций. Понимание взаимосвязи между уровнем автономии и требованиями к безопасности является ключевым для ответственной разработки и внедрения ИИ-агентов.

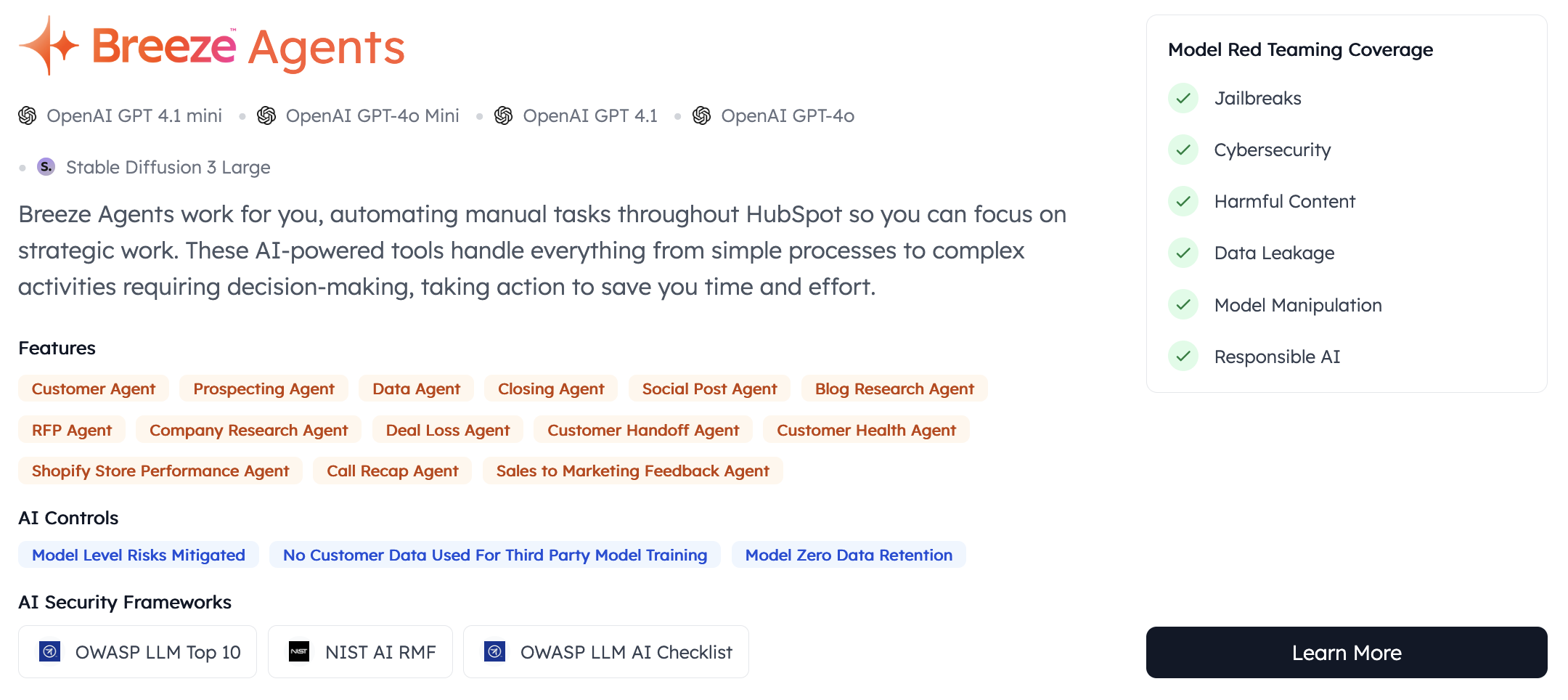

Метод “Red Teaming” представляет собой проактивную оценку безопасности, при которой специализированные команды имитируют атаки на систему искусственного интеллекта, стремясь выявить уязвимости и слабые места в ее защите. Этот процесс включает в себя разработку и реализацию различных сценариев атак, направленных на обход механизмов защиты, эксплуатацию ошибок в коде или манипулирование входными данными. Целью “Red Teaming” является не взлом системы, а обнаружение потенциальных векторов атак и оценка эффективности применяемых мер безопасности, что позволяет разработчикам своевременно устранить недостатки и повысить устойчивость системы к реальным угрозам. Результаты тестирования используются для улучшения алгоритмов, повышения надежности и обеспечения безопасной эксплуатации агентов искусственного интеллекта.

Платформы, такие как HubSpot Breeze Agents, демонстрируют растущую тенденцию к внедрению мер безопасности и обеспечению поддержки документацией, в частности, посредством Model Card Documentation. Однако, проведенный нами анализ выявил, что лишь незначительный процент агентов обладает публично доступными, детализированными оценками безопасности. Это указывает на существенный пробел в прозрачности и подотчетности систем искусственного интеллекта, несмотря на растущее осознание важности ответственной разработки и внедрения ИИ. Отсутствие общедоступной документации затрудняет независимую проверку и оценку потенциальных рисков, связанных с функционированием этих агентов.

Реальные применения и будущие направления

В настоящее время наблюдается стремительное появление разнообразных приложений, основанных на принципах агентного ИИ. Яркими примерами служат ‘ChatGPT Agent’, предназначенный для оказания помощи в диалоговом режиме, и ‘Perplexity Comet’, обеспечивающий автоматизацию задач непосредственно в веб-браузере. Эти платформы демонстрируют способность агентного ИИ расширять возможности человека и оптимизировать сложные рабочие процессы, предлагая пользователям инструменты для более эффективного взаимодействия с информацией и автоматизации рутинных операций. Развитие подобных систем открывает новые перспективы в различных сферах, от обслуживания клиентов до научных исследований, и свидетельствует о потенциале агентного ИИ для преобразования способов решения задач.

Современные платформы, такие как ChatGPT Agent и Perplexity Comet, наглядно демонстрируют, как агенты искусственного интеллекта способны значительно расширять возможности человека и оптимизировать сложные рабочие процессы. Эти системы не просто автоматизируют рутинные задачи, но и берут на себя более сложные функции, включая поиск информации, анализ данных и даже принятие решений в рамках заданных параметров. Благодаря этому, пользователи могут сосредоточиться на более творческих и стратегических аспектах своей деятельности, повышая общую производительность и эффективность. Возможность автоматизации многоступенчатых задач, ранее требовавших значительных временных затрат, открывает новые перспективы в различных сферах — от клиентского обслуживания и исследований до управления проектами и разработки программного обеспечения.

Непрерывные исследования и разработки имеют решающее значение для преодоления возникающих трудностей и раскрытия всего потенциала этой преобразующей технологии. Хотя агентский искусственный интеллект уже демонстрирует значительные возможности в автоматизации и расширении человеческих способностей, существуют ключевые области, требующие дальнейшего изучения. К ним относятся повышение надежности и безопасности агентов, улучшение их способности к адаптации к новым ситуациям и разработка более эффективных методов обучения и контроля. Только благодаря целенаправленным усилиям в этих направлениях можно обеспечить, чтобы агентский ИИ стал мощным инструментом для решения сложных задач и улучшения качества жизни, избежав при этом потенциальных рисков и негативных последствий. Дальнейшие инновации, несомненно, приведут к появлению еще более интеллектуальных и полезных агентов, способных решать задачи, которые ранее считались невозможными.

Для обеспечения доверия и ответственной разработки в стремительно развивающейся области автономных агентов, необходим стандартизированный подход к их оценке. В рамках данного исследования был создан “Индекс AI-агентов”, позволивший провести всестороннюю оценку тридцати различных агентов. Эта методология позволяет объективно сравнивать их возможности, выявлять сильные и слабые стороны, а также определять области для дальнейшего улучшения. Такой унифицированный подход к тестированию не только способствует прозрачности и подотчетности, но и позволяет разработчикам создавать более надежные и эффективные системы, отвечающие потребностям пользователей и общества в целом. Внедрение подобного индекса является ключевым шагом на пути к широкому и безопасному применению агентного искусственного интеллекта.

Исследование, представленное в индексе AI Agent 2025, напоминает вскрытие сложного механизма. Авторы не просто констатируют наличие тех или иных функций в системах искусственного интеллекта, но и подвергают их детальному анализу, выявляя закономерности в подходах к обеспечению безопасности и прозрачности. Как однажды заметила Грейс Хоппер: «Лучший способ предсказать будущее — это создать его». Этот принцип особенно актуален в контексте разработки AI-агентов, где понимание текущих возможностей и ограничений является необходимым условием для формирования ответственного и управляемого искусственного интеллекта. Анализ 30 систем демонстрирует, что создание будущего AI требует не только инноваций, но и глубокого понимания принципов его работы.

Что дальше?

Представленный анализ тридцати агентивных систем искусственного интеллекта, безусловно, фиксирует текущий момент. Однако, как и любой «индекс», он скорее описывает симптомы, чем причины. Наиболее интересные вопросы остаются за кадром: не столько о том, что эти агенты делают, сколько о том, как их действия формируют окружающую реальность и, как следствие, саму концепцию «интеллекта». Каждый «патч» безопасности, каждое улучшение в прозрачности — это философское признание изначальной хрупкости и несовершенства системы.

Очевидно, что акцент смещается от простого отслеживания технических характеристик к пониманию emergent behavior — неожиданных свойств, возникающих при взаимодействии сложных систем. Истинный вызов — не в создании более «безопасных» агентов, а в разработке инструментов для предвидения и смягчения последствий их непредсказуемых действий. Ведь, в конечном счете, каждый алгоритм — это модель мира, а любая модель — это упрощение, искажающее истинную сложность.

И, пожалуй, самое важное: лучший «хак» — это осознание того, как всё работает. Прозрачность — это не самоцель, а необходимое условие для реверс-инжиниринга реальности, для понимания фундаментальных принципов, лежащих в основе этих систем. И, возможно, для того, чтобы научиться их взламывать — не в деструктивном смысле, а в смысле расширения границ возможного.

Оригинал статьи: https://arxiv.org/pdf/2602.17753.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Квантовый скачок: от лаборатории к рынку

- Виртуальная примерка без границ: EVTAR учится у образов

- Реальность и Кванты: Где Встречаются Теория и Эксперимент

2026-02-23 07:26