Автор: Денис Аветисян

Исследование предлагает оригинальную концепцию, рассматривающую обучение с подкреплением как вложение вероятностных распределений в гильбертово пространство с использованием квантовых представлений.

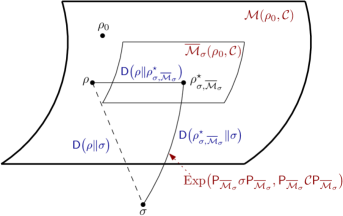

В статье представлена квантовая модель максимального правдоподобия, основанная на вложениях в гильбертово пространство, и проведен неасимптотический анализ её сходимости.

Современные большие языковые модели демонстрируют удивительную способность к обучению в контексте, однако механизмы, лежащие в основе этого явления, остаются не до конца понятными. В работе ‘Quantum Maximum Likelihood Prediction via Hilbert Space Embeddings’ предложен альтернативный взгляд на эту проблему, основанный на моделировании вероятностных распределений как квантовых операторов плотности в гильбертовом пространстве. Это позволяет интерпретировать обучение в контексте как задачу максимального правдоподобия, а предсказания — как проекции в обратном порядке, и получить неасимптотические гарантии сходимости. Может ли подобный подход открыть новые горизонты в понимании и проектировании более эффективных языковых моделей, объединяя принципы квантовой механики и статистического обучения?

Предсказание Последовательностей: Основы и Вызовы

Точное предсказание следующего элемента в последовательности остаётся фундаментальной задачей в области искусственного интеллекта. Сложность заключается в том, что реальные последовательности данных редко бывают простыми и линейными; они часто характеризуются сложными взаимосвязями и зависимостями, которые трудно уловить традиционными алгоритмами. От прогнозирования временных рядов в финансах до генерации естественного языка и распознавания речи, способность предвидеть следующие шаги в последовательности является ключевой для создания интеллектуальных систем. Поэтому разработка методов, способных эффективно моделировать и предсказывать сложные последовательности, остается активной областью исследований, требующей инновационных подходов и новых теоретических разработок.

Традиционные методы прогнозирования последовательностей часто сталкиваются с трудностями при работе со сложными, нелинейными зависимостями, присущими реальным данным. В отличие от линейных моделей, способных эффективно обрабатывать простые тренды, алгоритмы, основанные на предположении о линейности, демонстрируют снижение точности при анализе данных, где взаимосвязи между элементами последовательности носят нелинейный характер. Это связано с тем, что нелинейные зависимости требуют более сложных моделей, способных улавливать и воспроизводить эти взаимосвязи. В результате, для эффективного прогнозирования в условиях нелинейности необходимы методы, способные моделировать эти сложные паттерны и адаптироваться к их изменениям, что представляет собой значительный вызов для исследователей в области искусственного интеллекта и анализа данных.

Оценка точности предсказаний в последовательностях данных требует применения надежных метрик, при этом выбор конкретной метрики оказывает существенное влияние на процесс оптимизации модели. В рамках данной работы продемонстрировано, что Квантовый Максимально Вероятный Предсказатель (QMLP) достигает ошибки Trace Norm порядка O(1/n) или O(1/\sqrt{n}), в зависимости от значения параметра epsilon. Полученные результаты подтверждают статистические гарантии производительности QMLP и свидетельствуют о его потенциале для решения задач последовательного предсказания, особенно в случаях, когда традиционные методы оказываются недостаточно эффективными. Высокая точность и гарантированные статистические свойства делают QMLP перспективным инструментом для анализа и прогнозирования сложных последовательностей данных.

Обучение в Контексте: Новый Подход к Адаптации Моделей

Обучение в контексте (In-Context Learning, ICL) позволяет большим языковым моделям выполнять задачи без необходимости явного обновления параметров модели. В отличие от традиционного обучения с учителем, где модель адаптируется посредством изменения весов на основе размеченных данных, ICL использует предоставленные примеры непосредственно в процессе запроса. Модель, обученная на большом объеме данных, способна экстраполировать закономерности и применять их к новым задачам, основываясь исключительно на контексте, представленном во входных данных — запросе и нескольких примерах решения. Таким образом, модель сохраняет свои исходные параметры и адаптируется к задаче посредством изменения способа использования этих параметров в процессе генерации ответа.

Эффективность обучения в контексте (In-Context Learning, ICL) указывает на наличие внутренней системы в больших языковых моделях, позволяющей им быстро адаптироваться к новым задачам исключительно на основе предоставленных примеров. Эта адаптация происходит без изменения параметров модели, что отличает ICL от традиционных методов обучения. Предполагается, что модель использует информацию, содержащуюся в примерах, для формирования внутреннего представления о задаче и последующего выполнения новых запросов, основываясь на этой информации. Данный механизм позволяет модели обобщать знания из ограниченного набора примеров и применять их к новым, ранее не встречавшимся данным, демонстрируя способность к быстрому обучению и адаптации.

Понимание механизма обучения с примерами (In-Context Learning, ICL) имеет решающее значение для разработки более эффективных и устойчивых систем искусственного интеллекта. Данное исследование предоставляет статистические гарантии для ICL, демонстрируя согласованность и скорости сходимости ошибки предсказания в зависимости от размера выборки и размерности векторного представления. В частности, показано, что ошибка предсказания сходится к оптимальному значению по мере увеличения размера выборки и уменьшения размерности встраивания, обеспечивая теоретическую основу для анализа и оптимизации производительности ICL. Полученные результаты позволяют прогнозировать и контролировать точность моделей, использующих ICL, и создавать более надежные системы, способные к адаптации к новым задачам без обновления параметров.

Байесовский Вывод как Механизм Обучения в Контексте

Байесовский вывод предоставляет формальную основу для обновления вероятностных убеждений на основе поступающих данных, что отражает адаптивное поведение, наблюдаемое в процессе обучения с небольшим количеством примеров (In-Context Learning, ICL). В ICL, предоставление новых входных примеров можно рассматривать как поступление новых свидетельств, которые используются для переоценки вероятности различных гипотез о задаче. Этот процесс аналогичен байесовскому обновлению апостериорной вероятности P(H|E), где H представляет собой гипотезу, а E — наблюдаемые данные (примеры). Таким образом, ICL можно интерпретировать как форму приближенного байесовского вывода, позволяющую модели динамически адаптироваться к новым данным и улучшать свою производительность без явного переобучения.

Процесс включения примеров входных данных в контекст можно представить как байесовскую апостериорную оценку. В этом представлении, начальное распределение вероятностей (априорное) отражает изначальные знания языковой модели. Примеры, предоставляемые в контексте, функционируют как данные, используемые для обновления этого априорного распределения, формируя апостериорное распределение. Апостериорное распределение затем используется для прогнозирования наиболее вероятного ответа на новый запрос. Таким образом, предоставление примеров эффективно корректирует вероятностные оценки модели, позволяя ей адаптироваться к конкретной задаче и улучшать свою производительность на основе ограниченного набора данных.

Результаты исследований показывают, что большие языковые модели (LLM) неявно выполняют байесовские вычисления, что обеспечивает их способность к быстрой обобщающей способности на основе небольшого количества примеров (few-shot learning). В частности, обнаружена ошибка квантовой относительной энтропии порядка O(1/n), где n — количество примеров. Данный результат подтверждает состоятельность используемой квантовой модели перцептрона (QMLP) и её соответствие принципам байесовского вывода. Важно отметить, что указанная ошибка не зависит от размерности пространства вложений (d), что свидетельствует об отсутствии “проклятия размерности” и указывает на масштабируемость подхода.

Представленная работа демонстрирует стремление к математической строгости в области машинного обучения, что находит отклик в словах Грейс Хоппер: «Лучший способ предсказать будущее — это создать его». В контексте квантового предсказания с использованием вложений в гильбертово пространство, это означает не просто разработку алгоритма, который хорошо работает на текущих данных, но и построение теоретически обоснованной модели, позволяющей предсказывать поведение системы в новых условиях. Гарантии статистической сходимости, полученные в статье, являются прямым следствием этого подхода — стремления к доказуемости, а не эмпирической эффективности. Использование операторов плотности и расхождение Реньи лишь подтверждает стремление к математической чистоте, позволяющей рассматривать задачу предсказания как строго определенную математическую проблему.

Куда Далее?

Представленная работа, несмотря на элегантность математической конструкции, лишь слегка приоткрывает завесу над истинной природой обучения в контексте. Использование пространства Гильберта для кодирования вероятностных распределений — шаг логичный, но не лишенный определенной иронии. Ведь, по сути, мы вновь обращаемся к абстракциям, чтобы описать явления, корни которых лежат в эмпирической реальности. Необходимо признать, что гарантии статистической сходимости, полученные в данной работе, ограничены специфическими предположениями о структуре данных и свойствах встраиваний. Реальные данные редко соответствуют этим идеализациям.

Следующим этапом представляется не просто расширение теоретических гарантий, но и разработка алгоритмов, способных эффективно аппроксимировать оптимальные квантовые состояния в высокоразмерных пространствах. Особое внимание следует уделить вопросам вычислительной сложности и масштабируемости. Иначе говоря, красивый алгоритм, неспособный справиться с практическими задачами, останется лишь математической игрушкой. Необходимо исследовать альтернативные метрики и методы оценки сходимости, более устойчивые к шуму и неполноте данных.

В конечном счете, истинный прогресс потребует отхода от упрощенных моделей и признания сложности лежащих в основе процессов. Представленный подход, безусловно, является ценным вкладом в эту область, но лишь отправной точкой для дальнейших исследований. Элегантность математики не должна заслонять собой необходимость эмпирической проверки и адаптации к реальным условиям.

Оригинал статьи: https://arxiv.org/pdf/2602.18364.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Виртуальная примерка без границ: EVTAR учится у образов

- Реальность и Кванты: Где Встречаются Теория и Эксперимент

- Квантовый скачок: от лаборатории к рынку

2026-02-23 09:03