Автор: Денис Аветисян

Новое исследование показывает, что современные системы распознавания лиц, призванные защищать приватность, могут непреднамеренно раскрывать личность даже без прямой реконструкции изображения.

Анализ демонстрирует, что утечка идентичности в системах, защищающих приватность при распознавании лиц, происходит из-за недостатков в используемых метриках оценки и механизмах защиты.

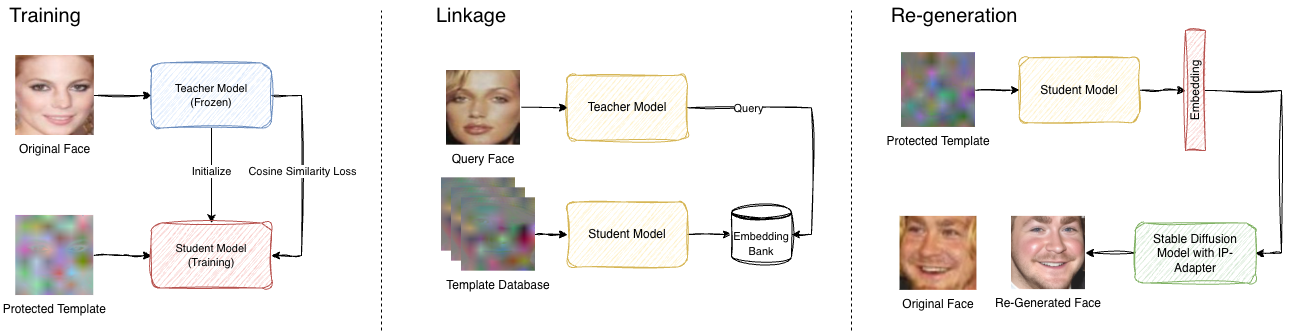

Несмотря на развитие методов сохранения конфиденциальности в системах распознавания лиц, существующие оценки часто ограничиваются устойчивостью к пиксельной реконструкции. В данной работе, ‘FaceLinkGen: Rethinking Identity Leakage in Privacy-Preserving Face Recognition with Identity Extraction’, представлен новый метод атаки, позволяющий идентифицировать личность по защищенным шаблонам без восстановления исходного изображения. Эксперименты на трех современных системах показали, что FaceLinkGen достигает более 98.5% точности сопоставления и свыше 96% успешности восстановления лиц, даже в условиях почти нулевого знания. Не демонстрирует ли это фундаментальный разрыв между используемыми метриками защиты и реальным уровнем приватности, и какие новые подходы к защите информации о лице необходимы?

Лица в эпоху искусственного интеллекта: Уязвимость приватности

Технологии распознавания лиц предлагают значительные преимущества в различных сферах, от обеспечения безопасности до персонализации услуг. Однако, вместе с этим, возникает серьезная угроза утечки конфиденциальной информации, идентифицирующей личность. Современные системы, собирающие и анализирующие изображения лиц, могут непреднамеренно раскрывать чувствительные данные, такие как имя, возраст, пол и даже эмоциональное состояние. Это происходит из-за сложности защиты больших массивов биометрической информации от несанкционированного доступа и злоупотреблений. Недостаточная проработка механизмов анонимизации и шифрования, а также уязвимости в программном обеспечении, делают возможным извлечение и использование личных данных в неправомерных целях, что требует разработки более надежных и безопасных методов защиты приватности.

Традиционные системы защиты конфиденциальности при распознавании лиц, основанные на методах обфускации, оказываются уязвимыми перед целенаправленными атаками, направленными на восстановление или установление связи с реальной личностью. Вместо того, чтобы полностью скрывать информацию о лице, эти системы зачастую лишь искажают ее, что позволяет злоумышленникам, используя современные алгоритмы и вычислительные мощности, реконструировать исходное изображение или сопоставить его с данными из других источников. Подобные атаки, даже при минимальном объеме доступной информации, демонстрируют высокую эффективность, ставя под сомнение надежность существующих методов защиты и подчеркивая необходимость разработки более устойчивых к взлому технологий сохранения конфиденциальности.

Существующие метрики оценки систем сохранения приватности лиц, такие как оценка на основе восстановления пикселей, зачастую не способны адекватно отразить реальный масштаб утечки идентифицирующей информации, создавая иллюзию безопасности. Исследования показывают, что даже незначительные отклонения в восстановленном изображении могут быть недостаточны для предотвращения успешной идентификации личности с использованием современных алгоритмов распознавания лиц. Данные показатели не учитывают способность зломышленников использовать косвенные данные или проводить сложные атаки для восстановления исходной идентичности, что приводит к завышенной оценке эффективности систем защиты приватности. В результате, полагаясь на традиционные метрики, разработчики и пользователи могут быть уверены в безопасности, которая на самом деле отсутствует, подвергая личные данные риску несанкционированного доступа и использования.

Существующие методы оценки систем защиты конфиденциальности при распознавании лиц (PPFR) зачастую оказываются неэффективными, поскольку фокусируются на восстановлении исходного изображения, а не на предотвращении раскрытия личности. Проведенный анализ демонстрирует, что даже незначительные искажения, применяемые для защиты данных, не гарантируют конфиденциальность. В ходе исследований была достигнута почти полная реконструкция лиц (97,9%-100% успешных попыток) и установлена возможность точной идентификации даже при минимальном объеме исходных данных. Это указывает на необходимость принципиально нового подхода к оценке PPFR, который бы смещал акцент с визуальной схожести с исходным изображением на фактическую невозможность установления личности, что позволит обеспечить более надежную защиту персональных данных в эпоху развития технологий искусственного интеллекта.

Идентификация как критерий: Новый стандарт оценки PPFR

Предлагаемый нами оценочный фреймворк, ориентированный на идентификацию, напрямую оценивает способность системы предотвращать раскрытие личности, в отличие от традиционных подходов, фокусирующихся исключительно на качестве реконструкции изображения. Вместо оценки визуального сходства восстановленного изображения, данная методика концентрируется на проверке, возможно ли однозначно идентифицировать личность, используя информацию, которую система PPFR (Privacy-Preserving Face Recognition) выдает. Это достигается путем анализа выходных данных системы на предмет сохранения или раскрытия идентифицирующих признаков, что позволяет более точно оценить эффективность механизма защиты конфиденциальности и выявить потенциальные уязвимости, связанные с утечкой личных данных.

Предлагаемая оценка уязвимостей систем PPFR (Privacy-Preserving Face Recognition) использует сложные методы атак, включая атаки восстановления (regeneration attacks) и атаки связывания (linkage attacks). Атаки восстановления направлены на реконструкцию исходного лица из защищенного шаблона, в то время как атаки связывания стремятся установить соответствие между защищенными лицами и их идентичностями в других базах данных. Комбинированное применение этих методов позволяет всесторонне протестировать устойчивость системы к различным угрозам, выявляя потенциальные недостатки в механизмах защиты и оценивая риск раскрытия личной информации. Результаты тестирования показывают высокую эффективность данных атак, демонстрируя, что существующие системы PPFR остаются уязвимыми к злонамеренному извлечению и идентификации лиц.

Имитация реальных угроз позволяет выявить уязвимости в защищенном шаблоне и оценить эффективность механизмов сохранения конфиденциальности в системах PPFR. Этот подход включает в себя моделирование атак, направленных на извлечение идентифицирующей информации из шаблона, что позволяет определить, насколько эффективно система скрывает личные данные. Анализ результатов таких атак позволяет количественно оценить устойчивость системы к различным типам угроз и выявить слабые места, требующие усиления. Оценка проводится путем измерения вероятности успешного восстановления личности на основе защищенного шаблона, что дает объективную картину уровня защиты конфиденциальности.

Предлагаемый подход к оценке систем PPFR (Privacy-Preserving Face Recognition) обеспечивает более реалистичную и всестороннюю проверку, предоставляя повышенную гарантию конфиденциальности. Проведенные нами оценки демонстрируют уязвимость существующих систем PPFR к атакам, направленным на восстановление исходных данных. На стандартных наборах данных, таких как CASIA-WebFace, LFW и TPDNE, достигнуты показатели успешного восстановления (regeneration success rates) в диапазоне от 97.9% до 100%, что указывает на существенные риски для приватности пользователей при использовании текущих реализаций PPFR.

Проверка системы: Методы атак и лежащие в основе механизмы

Для проведения атак на защищенные шаблоны используются продвинутые методы, такие как FaceLinkGen. Данный подход основан на использовании лицевых эмбеддингов, полученных с помощью модели ArcFace, для установления связи или реконструкции идентичности из защищенных шаблонов. ArcFace генерирует компактное векторное представление лица, которое затем используется для сравнения и сопоставления с другими лицами, даже если исходные изображения подверглись изменениям или искажениям. FaceLinkGen использует эти эмбеддинги для обхода механизмов защиты и восстановления информации об идентичности, что позволяет потенциально связать защищенный шаблон с конкретным человеком.

Атаки на систему PPFR выявляют уязвимости, позволяющие извлекать конфиденциальную информацию из защищенных шаблонов. В частности, злоумышленники могут получить доступ к представлениям личности (identity representations), используемым системой для идентификации, а также к «мягким» биометрическим атрибутам, таким как пол, возраст, и этническая принадлежность. Извлечение этих данных возможно даже при частичной защите шаблонов, что ставит под угрозу анонимность и конфиденциальность пользователей. Полученная информация может быть использована для отслеживания, профилирования или других несанкционированных действий.

Для извлечения информации об идентичности из защищенных шаблонов применяются методы высокочастотной фильтрации. Данный подход позволяет обходить частотную маскировку, используемую в системе PPFR, за счет акцентирования высокочастотных компонентов сигнала, содержащих признаки, идентифицирующие личность. Экспериментальные результаты демонстрируют, что применение высокочастотной фильтрации позволяет успешно восстановить информацию об идентичности, что подтверждается достигнутыми показателями успешности сопоставления (linkage success rates) в диапазоне 92% — 96% на наборе данных LFW, используя лишь минимальный объем дополнительных данных.

Генеративные модели, такие как DreamO и Arc2Face, продемонстрировали возможность реконструкции черт лица на основе защищенных шаблонов. В ходе экспериментов на наборе данных LFW, при использовании минимального объема информации — высокочастотной фильтрации (high-pass filter) — достигнута успешность установления однозначной связи (1-to-1 linkage) в диапазоне 92% — 96%. Данный результат указывает на потенциальную возможность восстановления идентичности, несмотря на применение мер защиты шаблонов.

Оценка на практике: Анализ производительности PPFR

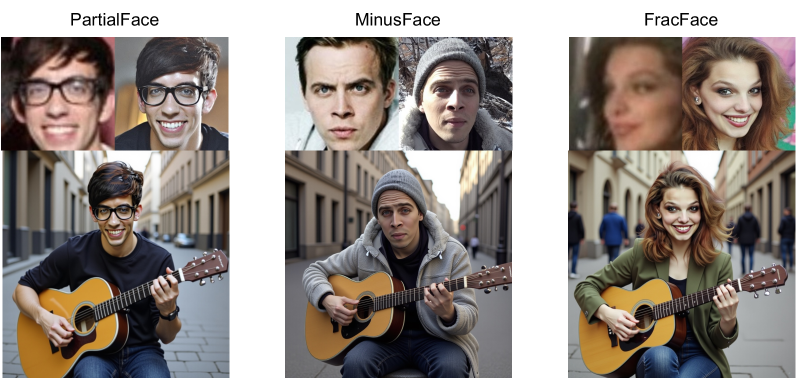

Проведенная оценка собственной, ориентированной на идентификацию, системы анализа позволила сопоставить её эффективность с рядом методов защиты конфиденциальности лиц (PPFR), включая FracFace, PartialFace и MinusFace. В рамках исследования, разработанный фреймворк был применен к каждой из указанных технологий, что позволило выявить их устойчивость к атакам, направленным на восстановление личной информации. Сравнение результатов, полученных при использовании различных PPFR методов, продемонстрировало различия в их способности сдерживать утечки данных, связанные с идентификацией личности, и выявило сильные и слабые стороны каждого подхода. Полученные данные способствуют более глубокому пониманию возможностей и ограничений существующих технологий защиты приватности лиц.

Исследования показали, что традиционные метрики, такие как HPSv2 и BLIP Score, оказываются недостаточными для полной оценки степени утечки идентичности в системах защиты приватности лиц (PPFR). В ходе оценки различных методов PPFR, включая FracFace, PartialFace и MinusFace, было выявлено, что эти показатели зачастую не способны обнаружить тонкие, но критические уязвимости, позволяющие восстановить личность из защищенных данных. Несмотря на высокие значения HPSv2 и BLIP Score, демонстрирующие кажущуюся эффективность защиты, предложенная оценочная рамка выявила случаи успешной идентификации личности, пропущенные стандартными метриками. Это указывает на необходимость разработки более комплексных подходов к оценке PPFR, способных учитывать нюансы утечки идентичности, которые остаются незамеченными при использовании существующих инструментов.

Разработанная оценочная система последовательно выявляет уязвимости в системах защиты приватности лиц (PPFR), которые остаются незамеченными при использовании традиционных метрик, таких как HPSv2 и BLIP Score. Исследование демонстрирует, что существующие методы оценки не способны в полной мере зафиксировать утечку идентифицирующей информации, что ставит под вопрос надежность современных PPFR-систем. Этот факт подчеркивает необходимость перехода к более комплексному подходу в оценке эффективности защиты приватности, учитывающему не только общие показатели, но и специфические векторы атак и возможности восстановления идентичности. Полученные результаты указывают на критическую важность разработки и внедрения новых, более совершенных метрик и инструментов для обеспечения действительно надежной защиты персональных данных в контексте быстро развивающихся технологий генерации и манипулирования изображениями.

Проведенная тщательная оценка различных методов защиты приватности лиц (PPFR), таких как FracFace, PartialFace и MinusFace, позволила выявить их сильные и слабые стороны. Исследование показало, что даже при использовании защищенных шаблонов возможно генерировать высококачественные дипфейки, демонстрирующие впечатляющие результаты: оценка BLIP превышает 0.28, согласованность лиц (Facial Consistency) достигает более 90%, а показатель HPSv2 — более 0.28. Эти данные подчеркивают необходимость более комплексного подхода к оценке PPFR, выходящего за рамки традиционных метрик, и служат основой для разработки более надежных и ориентированных на защиту приватности систем.

Перспективы развития: К надежным и сохраняющим приватность системам

В дальнейшем исследования будут сосредоточены на внедрении атак, основанных на намеренном искажении данных, для проверки устойчивости систем распознавания лиц. Особое внимание уделяется разработке новых метрик оценки, способных выявлять даже незначительные утечки персональной информации, которые могут остаться незамеченными при использовании традиционных методов. Целью является создание систем, способных противостоять не только прямым атакам, но и более изощренным манипуляциям с данными, гарантируя тем самым надежную защиту приватности.

Разработка более устойчивых методов PPFR (Privacy-Preserving Facial Recognition), способных противостоять продвинутым атакам, представляется ключевым фактором для обеспечения долгосрочной конфиденциальности. Современные системы, несмотря на определенные успехи в защите данных, остаются уязвимыми перед новыми, постоянно усложняющимися методами взлома, направленными на восстановление идентичности. Поэтому, исследования в области повышения устойчивости алгоритмов к различным видам атак — от простых манипуляций с изображениями до сложных adversarial примеров — имеют первостепенное значение. Успешное решение этой задачи позволит создать системы распознавания лиц, которые не только обеспечивают функциональность, но и гарантируют надежную защиту персональных данных в условиях растущей цифровой слежки и угроз кибербезопасности.

Для обеспечения справедливости и всеохватности крайне важно расширить рамки оценки методов защиты конфиденциальности. Исследования показывают, что существующие системы часто демонстрируют различную эффективность в зависимости от демографических характеристик, таких как пол, возраст и этническая принадлежность. Недостаточное представление разнообразных групп в наборах данных для обучения и тестирования может привести к систематическим ошибкам и дискриминации. Поэтому, будущие разработки должны включать тщательную оценку производительности алгоритмов на широком спектре демографических групп и в различных реальных сценариях, включая различные условия освещения, углы обзора и качество изображения. Только такой подход позволит создать действительно инклюзивные и справедливые системы распознавания лиц, защищающие права каждого человека.

В конечном счете, стремление направлено на создание безопасной и сохраняющей конфиденциальность экосистемы распознавания лиц, приносящей пользу обществу и одновременно уважающей индивидуальные права. Разработка такой системы предполагает не только совершенствование алгоритмов для повышения точности и устойчивости к атакам, но и внедрение механизмов, гарантирующих защиту персональных данных и предотвращающих неправомерное использование биометрической информации. Предполагается, что подобный подход позволит реализовать потенциал технологии распознавания лиц в областях, таких как безопасность, здравоохранение и общественный транспорт, минимизируя при этом риски для гражданских свобод и приватности. Реализация подобной экосистемы потребует совместных усилий исследователей, разработчиков и законодателей, направленных на создание четких этических и правовых норм, регулирующих использование данной технологии.

Исследование демонстрирует, что современные системы распознавания лиц, призванные защитить приватность, парадоксальным образом могут выдавать информацию об идентичности человека, даже не прибегая к полной реконструкции изображения. Это подчеркивает фундаментальные недостатки в используемых метриках оценки и механизмах защиты. Как отмечал Дэвид Марр: «Понимание вычислительной теории зрения требует понимания не только того, что видит система, но и как она это делает». Данная работа, фокусируясь на уязвимости пространства вложений и возможности извлечения идентичности, подтверждает эту мысль, показывая, что недостаточно просто скрыть изображение — необходимо глубокое понимание принципов работы самой системы распознавания.

Куда Ведет Эта Дорога?

Представленная работа обнажает тревожную тенденцию: защита приватности в системах распознавания лиц, кажется, превратилась в изысканную игру в прятки с самими собой. Достаточно извлечь информацию об идентичности, чтобы обойти существующие механизмы, даже не прибегая к полной реконструкции лица. Это не столько провал технологий, сколько признание фундаментальной сложности задачи. Изящность алгоритма, направленного на сокрытие, не должна затмевать уязвимость, которую он не устраняет, а лишь маскирует.

Будущие исследования, вероятно, сосредоточатся на создании более надежных метрик оценки. Текущие показатели, судя по всему, позволяют лишь констатировать, насколько сложно украсть информацию, но не гарантируют ее реальной защиты. Необходимо переосмыслить понятие «приватности» в контексте биометрических данных, переходя от поверхностных мер к глубокому пониманию границ допустимого извлечения информации. Иначе, мы рискуем построить крепость из песка, обманывая себя иллюзией безопасности.

В конечном счете, задача заключается не в создании все более сложных алгоритмов, а в признании пределов того, что возможно. Красота в простоте, а не в усложнении. Вместо погони за идеальной защитой, возможно, стоит сосредоточиться на минимизации рисков и прозрачности использования биометрических данных. Ведь элегантность — не опция, это признак глубокого понимания, а не иллюзии совершенства.

Оригинал статьи: https://arxiv.org/pdf/2602.02914.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Отражения культуры: Как языковые модели рассказывают истории

- Самообучающиеся агенты: новый подход к автономным системам

- Укрощение Бесконечности: Алгебраические Инструменты для Кватернионов и За их Пределами

- Искусственный интеллект на производстве: иллюзии автономии

- Искусственный интеллект в медицине: новый уровень самостоятельности

- Квантовые хроники: Последние новости в области квантовых исследований и разработки.

- Квантовые маршруты и гравитационные сенсоры: немного иронии от физика

- Третья Разновидность ИИ: Как модели, думающие «про себя», оставят позади GPT и CoT

- BOOM: Визуальный перевод лекций: новый уровень доступности

- Квантовые Загадки: От «Призрачного Действия на Расстоянии» к Суперкомпьютерам

2026-02-04 15:29