Автор: Денис Аветисян

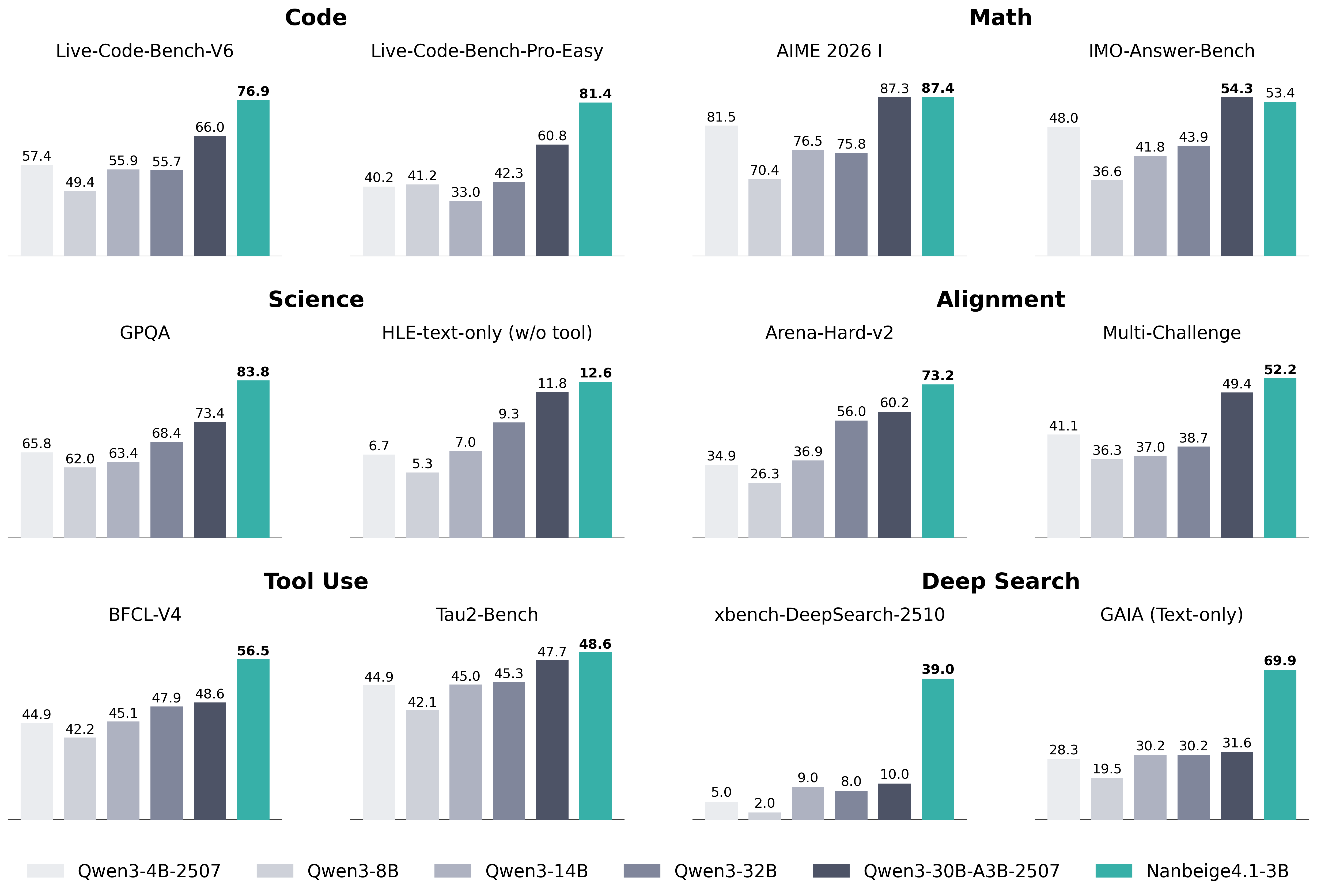

Новая языковая модель с 3 миллиардами параметров показывает впечатляющие результаты в рассуждениях, кодировании и планировании, приближаясь к производительности гораздо более крупных систем.

Nanbeige4.1-3B, обученная с использованием методов обучения с подкреплением и эффективного назначения заслуг, демонстрирует перспективные результаты в области автономных агентов и генерации кода.

Несмотря на растущий интерес к большим языковым моделям, сохраняется вопрос о достижении высокой производительности при ограниченных вычислительных ресурсах. В данной работе представлена модель Nanbeige4.1-3B, разработанная для решения задач рассуждения, генерации кода и реализации агентов, демонстрируя универсальность при всего лишь 3 миллиардах параметров. Ключевым результатом является достижение конкурентоспособных показателей, превосходящих более крупные модели, благодаря применению комбинированных стратегий обучения с подкреплением и тщательному назначению вознаграждений. Возможно ли дальнейшее расширение возможностей компактных моделей и создание действительно универсальных агентов, способных решать широкий спектр задач?

Введение в Nanbeige4.1-3B: Новая парадигма рассуждений

Существующие языковые модели зачастую испытывают трудности при решении сложных задач, требующих понимания длинного контекста и планирования. Это связано с тем, что традиционные архитектуры испытывают ограничения в способности удерживать и эффективно использовать информацию из больших объемов текста. Они склонны «забывать» важные детали или терять нить рассуждений, особенно при анализе длинных документов или при необходимости построения многошаговых планов действий. Подобные недостатки проявляются в задачах, требующих логического вывода, анализа причинно-следственных связей или синтеза информации из различных источников, что ограничивает их применение в областях, где критически важно долгосрочное планирование и глубокое понимание контекста.

Модель Nanbeige4.1-3B, состоящая из 3 миллиардов параметров, представляет собой значительный шаг вперед в области языкового моделирования и решения сложных задач, требующих глубокого понимания контекста и планирования. Результаты тестирования на различных эталонных наборах данных демонстрируют ее высокую эффективность, а полученный показатель GAIA, равный 69.90, подтверждает способность модели к сложному рассуждению и решению проблем, превосходя многие существующие аналоги. Этот показатель свидетельствует о перспективности Nanbeige4.1-3B как инструмента для задач, требующих не только обработки информации, но и логического вывода и стратегического планирования.

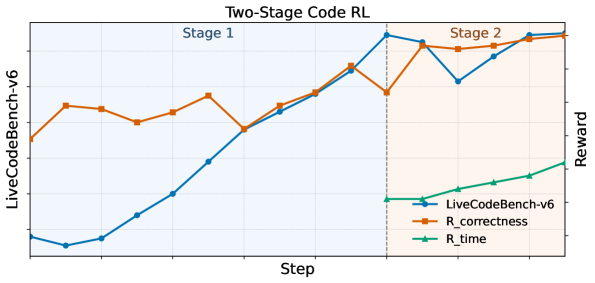

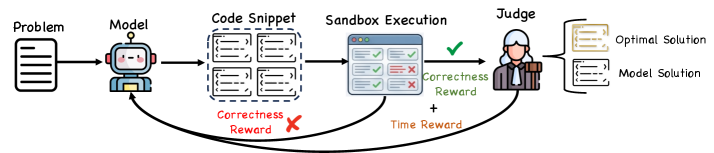

В основе Nanbeige4.1-3B лежит тщательно разработанный конвейер обучения, начинающийся с надежной базовой модели и подвергающийся многоэтапной оптимизации. Первоначально, модель прошла предварительное обучение на обширном корпусе текстовых данных, что позволило ей усвоить общие лингвистические закономерности и накопить базовые знания. Затем последовала серия этапов точной настройки, включающих обучение с подкреплением на специализированных задачах, требующих сложного рассуждения и планирования. Этот итеративный процесс, сочетающий в себе масштабируемость и точность, позволил добиться значительного улучшения производительности модели по сравнению с существующими аналогами, особенно в задачах, требующих учета длинного контекста и разработки последовательных стратегий решения. Подобный подход к обучению гарантирует не только высокую эффективность модели, но и ее способность к адаптации к новым задачам и данным.

Построение надежного фундамента: Конвейер обучения

Разработка Nanbeige4.1-3B началась с модели Nanbeige4-3B-Base, которая послужила основой для последующего обучения. Nanbeige4-3B-Base предоставила предварительно обученные веса и архитектуру, что позволило сократить время и вычислительные ресурсы, необходимые для достижения желаемого уровня производительности. Использование существующей базы позволило сконцентрироваться на специализированном обучении и доработке модели для конкретных задач, вместо обучения с нуля. Эта стратегия значительно упростила процесс разработки и способствовала более эффективному использованию доступных ресурсов.

Для начальной настройки поведения модели Nanbeige4.1-3B использовалось обучение с учителем (Supervised Fine-Tuning, SFT). В процессе SFT модель обучалась на размеченном наборе данных, что позволило ей усвоить базовые закономерности и улучшить способность генерировать релевантные ответы. Этот этап являлся подготовительным к дальнейшей оптимизации с использованием методов обучения с подкреплением, обеспечивая более стабильную и предсказуемую работу модели на начальных стадиях обучения.

В процессе обучения модели Nanbeige4.1-3B применялось обучение с подкреплением по принципу «точка за точкой» (Point-wise Reinforcement Learning). Этот метод направлен на повышение стабильности модели и снижение избыточности генерируемых ответов. В отличие от обучения с подкреплением, основанного на сравнении парных выборок, Point-wise RL оценивает каждое действие модели независимо, используя функцию вознаграждения для определения качества ответа. Это позволяет более эффективно корректировать поведение модели на каждом шаге обучения и предотвращать генерацию повторяющихся или неинформативных данных, способствуя более устойчивой и точной работе системы.

В заключительной фазе обучения модели Nanbeige4.1-3B использовалось парное обучение с подкреплением (Pair-wise Reinforcement Learning), которое основывалось на информации о предпочтениях. Данный метод предполагал сравнение различных вариантов ответа модели и использование этих предпочтений для корректировки параметров. Обучение проводилось на основе данных, указывающих, какой из двух ответов предпочтительнее, что позволило не только повысить общую производительность модели, но и улучшить её соответствие ожиданиям пользователей и заданным критериям качества, обеспечивая более точные и релевантные результаты.

Демонстрация агентурных способностей: Код и сложный поиск

Модель Nanbeige4.1-3B демонстрирует высокие результаты в генерации кода, что подтверждается тестами на различных бенчмарках, включая LiveCodeBench. В ходе тестирования модель показала улучшенные показатели успешной компиляции и выполнения кода по сравнению с другими моделями аналогичного размера. Это указывает на способность модели создавать корректный и функциональный код, решая задачи кодирования более эффективно, чем её аналоги. Результаты, полученные на LiveCodeBench, служат количественным подтверждением превосходства Nanbeige4.1-3B в области генерации кода.

Модель Nanbeige4.1-3B использует эффективные структуры данных, такие как монотонная очередь (Monotonic Deque) и дерево Фенвика (Fenwick Tree), а также понимает концепцию инверсионного счета для оптимизации генерируемого кода. Применение дерева Фенвика позволило снизить вычислительную сложность решения задач с O(N^2 log N) до O(N log N), что значительно повышает производительность алгоритмов и позволяет обрабатывать более крупные объемы данных. Использование этих оптимизаций свидетельствует о способности модели к эффективному решению сложных вычислительных задач.

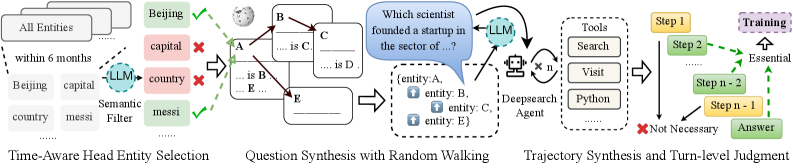

Модель Nanbeige4.1-3B демонстрирует выраженные способности к проактивному поведению (agentic behavior) за счет применения алгоритмов глубокого поиска (deep search) для решения сложных задач. Это проявляется в способности модели к взаимодействию с окружающей средой, анализу получаемых данных и последовательному выполнению действий, направленных на достижение поставленной цели. Подтверждением данной способности является результат на бенчмарке GAIA, где модель достигла показателя 69.90, а также результат в 75.00 на xBench-DeepSearch-05, что является передовым результатом для моделей сопоставимого размера.

Возможности агента Nanbeige4.1-3B подтверждаются результатами тестов на бенчмарках GAIA и xBench-DeepSearch-05. На бенчмарке GAIA модель достигла оценки 69.90, а на xBench-DeepSearch-05 — 75.00. Эти результаты демонстрируют передовые показатели для моделей схожего размера, подтверждая способность Nanbeige4.1-3B эффективно решать сложные задачи, требующие глубокого поиска и взаимодействия с внешней средой.

Последствия и перспективы развития ИИ-рассуждений

Успех модели Nanbeige4.1-3B наглядно демонстрирует, что мощные рассуждения в искусственном интеллекте достигаются не только за счет увеличения размера модели, но и благодаря тщательно спроектированным процессам обучения и эффективным архитектурным решениям. Вместо слепого наращивания параметров, исследователи сосредоточились на оптимизации конвейера обучения, что позволило 3B-параметровой модели достичь впечатляющих результатов в сложных задачах, требующих логического мышления и планирования. Этот подход подтверждает, что продуманная архитектура, в сочетании с качественной подготовкой данных и эффективными алгоритмами обучения, способна раскрыть значительный потенциал даже относительно небольших моделей, открывая новые горизонты в разработке интеллектуальных систем.

Способность модели Nanbeige4.1-3B к глубокому поиску, осуществляемому посредством использования инструментов, подчеркивает возрастающую значимость агентного поведения в передовых системах искусственного интеллекта. Данная особенность демонстрирует, что эффективное решение сложных задач требует не просто обработки информации, но и способности к активному исследованию пространства решений, выбору подходящих инструментов и последовательному применению действий для достижения поставленной цели. Использование инструментов позволяет модели расширить свои возможности, преодолевая ограничения, присущие статичным системам, и приближаясь к уровню гибкости и адаптивности, характерным для разумных агентов. Такой подход открывает перспективы для создания ИИ, способного к автономному планированию, решению проблем и взаимодействию с окружающей средой, что является ключевым шагом на пути к действительно интеллектуальным системам.

Результаты, продемонстрированные моделью Nanbeige4.1-3B на тестах GAIA и xBench-DeepSearch-05, указывают на перспективный путь создания искусственных агентов, способных к долгосрочному планированию и решению сложных задач. Примечательно, что модель достигла передовых результатов, несмотря на относительно небольшое количество параметров — всего 3 миллиарда. Это подчеркивает важность не только размера модели, но и эффективности архитектуры и методов обучения, открывая возможности для создания мощных систем искусственного интеллекта, не требующих огромных вычислительных ресурсов. Данный подход позволяет надеяться на создание более доступных и эффективных агентов, способных решать широкий спектр задач, требующих глубокого анализа и планирования на длительный период.

Предстоящие исследования направлены на масштабирование продемонстрированных техник и изучение новых архитектур искусственного интеллекта с целью раскрытия еще более мощных возможностей рассуждения. Ученые планируют расширить существующие подходы, применяя их к более сложным задачам и увеличивая объемы данных для обучения. Особое внимание будет уделено разработке инновационных структур нейронных сетей, способных эффективно обрабатывать информацию и генерировать логически обоснованные решения. Подобные исследования позволят не только улучшить производительность существующих систем, но и создать принципиально новые типы ИИ-агентов, способных к глубокому пониманию и решению проблем, требующих многоступенчатого планирования и анализа.

Исследование, представленное в данной работе, демонстрирует, что эффективность системы не всегда прямо пропорциональна ее размеру. Nanbeige4.1-3B, несмотря на относительно скромные 3 миллиарда параметров, показывает конкурентоспособные результаты в сложных задачах, таких как планирование и генерация кода. Это подтверждает мысль о том, что ключевым фактором является не столько количество ресурсов, сколько качество обучения и механизмы обратной связи. Как однажды заметил Марвин Минский: «Лучший способ предсказать будущее — создать его». Данная модель, с ее способностью к долгосрочному планированию и адаптации, действительно является попыткой формирования более разумных и эффективных систем, способных решать задачи, недоступные их более крупным аналогам. В конечном итоге, речь идет о создании систем, которые стареют достойно, сохраняя свою функциональность и адаптивность даже в условиях изменяющейся среды.

Куда же дальше?

Представленная модель, несмотря на впечатляющие результаты для своего размера, лишь подтверждает старую истину: любое улучшение стареет быстрее, чем ожидалось. Достижение конкурентоспособности с более крупными аналогами — это, безусловно, шаг вперед, но и лишь временная передышка. Проблема долгосрочного планирования и надежного кредитного присвоения остается, и любые кажущиеся решения — лишь отсрочка неизбежного.

Наиболее вероятный путь развития — это не столько наращивание параметров, сколько совершенствование архитектур и методов обучения, позволяющих более эффективно использовать имеющиеся ресурсы. Однако, стоит помнить, что оптимизация — это процесс бесконечный. Откат — это путешествие назад по стрелке времени, и каждое новое поколение моделей неизбежно будет уступать место следующим, более совершенным, но не лишенным собственных недостатков.

Вопрос не в том, чтобы создать идеальную модель, а в том, чтобы понять границы её применимости и признать её конечность. Все системы стареют — вопрос лишь в том, делают ли они это достойно. И Nanbeige4.1-3B, вне всякого сомнения, достойна внимания, как один из этапов этого неизбежного процесса.

Оригинал статьи: https://arxiv.org/pdf/2602.13367.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Конфиденциальный анализ больших данных: новый подход к быстрым ответам

- Разумные языковые модели: новый подход к логическому мышлению

- Квантовый импульс для нейросетей: новый подход к распознаванию изображений

- Искусственный интеллект на страже экологии: защита данных и справедливые алгоритмы

- Искусственный интеллект в действии: как расширяется сфера возможностей?

- Текстуры вместо Гауссиан: Новый подход к синтезу видов

- Языковые модели и границы возможного: что делает язык человеческим?

- Новая формула для расчёта взаимодействий глюонов открывает горизонты для голографии пространства

- Взрыв скорости: Оптимизация внимания для современных GPU

- Гендерные стереотипы в найме: что скрывают языковые модели?

2026-02-17 14:52