Автор: Денис Аветисян

Новый подход к обучению спайковых нейронных сетей позволяет им предсказывать собственное будущее поведение, повышая эффективность и приближая их к биологической правдоподобности.

В статье представлен метод улучшения спайковых нейронных сетей за счет включения механизма самопредсказания и адаптации во времени.

Несмотря на высокую энергоэффективность, обучение спайковых нейронных сетей (SNN) осложняется недифференцируемостью спайков и компромиссами между производительностью и биологической правдоподобностью. В данной работе, ‘General Self-Prediction Enhancement for Spiking Neurons’, предложен метод улучшения спайковых нейронов за счет самопрогнозирования, модулирующего мембранный потенциал на основе истории входных и выходных сигналов. Это позволяет создать непрерывный путь градиента, повышая стабильность обучения и точность, а также приближает модель к принципам функционирования коры головного мозга, в частности к механизмам предиктивного кодирования. Способны ли подобные подходы к самопрогнозированию стать ключевым фактором в создании действительно биологически правдоподобных и эффективных нейроморфных вычислений?

За гранью непрерывной активации: к спайковым нейронным сетям

Традиционные искусственные нейронные сети демонстрируют впечатляющие результаты в решении различных задач, однако их функционирование существенно отличается от принципов работы биологического мозга. В основе большинства современных сетей лежат функции активации, выдающие непрерывные значения, что требует постоянных вычислений и потребления энергии. В то время как мозг использует дискретные сигналы — нервные импульсы, или спайки — для передачи информации, обеспечивая энергоэффективность и высокую скорость обработки. Непрерывные активации в искусственных сетях, хотя и удобны для математического анализа, не отражают реальных процессов, происходящих в нейронных цепях, и приводят к значительно более высоким энергетическим затратам по сравнению с биологическими системами. Это несоответствие ограничивает возможности создания действительно интеллектуальных систем, способных к обучению и адаптации с минимальным потреблением ресурсов.

Мозг, в отличие от традиционных искусственных нейронных сетей, функционирует на основе разреженных, событийных сигналов — отдельных импульсов, возникающих лишь при необходимости. Этот принцип работы предполагает, что большая часть нейронов находится в состоянии покоя, что существенно снижает энергопотребление и повышает эффективность обработки информации. В связи с этим, всё большее внимание привлекают спайковые нейронные сети (SNNs), которые имитируют эту разреженную коммуникацию, передавая информацию дискретными импульсами. Использование подобных сетей открывает перспективные возможности для создания энергоэффективных и биологически правдоподобных систем искусственного интеллекта, способных к более сложным и адаптивным вычислениям.

Нейронные сети с импульсной передачей (SNN), в отличие от традиционных искусственных нейронных сетей, используют для коммуникации дискретные импульсы, что открывает путь к значительному снижению энергопотребления. Вместо постоянной активации, SNN передают информацию только при достижении определенного порога возбуждения, имитируя принцип работы биологических нейронов. Такой подход позволяет избежать ненужных вычислений и потребления энергии в периоды отсутствия сигнала. Более того, подобная импульсная природа вычислений обеспечивает большую биологическую правдоподобность, позволяя создавать модели, которые более точно отражают функционирование мозга и потенциально обладают более высокой способностью к адаптации и обучению. Данная особенность делает SNN перспективной платформой для разработки энергоэффективных и интеллектуальных систем, особенно в области мобильных устройств и робототехники.

Самопрогнозирование: новый взгляд на обучение спайковых сетей

Стандартные нейронные сети с импульсной активностью (SNN) часто сталкиваются с проблемой затухания градиентов при обучении, особенно при работе со сложными временными последовательностями. Это связано с особенностями распространения сигнала ошибки в обратном направлении во времени, где градиент может экспоненциально уменьшаться по мере продвижения к более ранним слоям сети. В результате, обучение долгосрочным зависимостям становится затруднительным, что ограничивает способность SNN эффективно обрабатывать данные, требующие запоминания и анализа событий, происходящих на разных временных масштабах. Данная проблема особенно актуальна для задач обработки видео, речи и других типов данных, где важна временная структура и контекст.

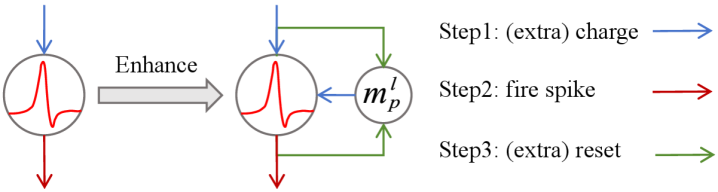

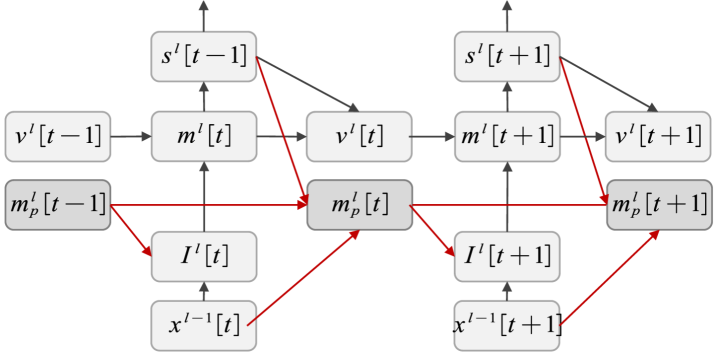

Предлагается модель нейрона с самопрогнозированием, расширяющая существующие модели, такие как Leaky Integrate-and-Fire (LIF), Parametric LIF (PLIF), Complementary LIF (CLIF) и Integrate-and-Fire (IF). В данной модели каждый нейрон включает механизм прогнозирования собственной будущей активности. Это достигается путем добавления внутреннего предсказания, которое сравнивается с фактической активностью нейрона, генерируя сигнал ошибки. Этот сигнал ошибки используется для корректировки внутренних параметров нейрона, тем самым улучшая способность сети к обучению и обработке временных зависимостей. Механизм самопрогнозирования позволяет нейрону адаптироваться к изменениям во входных данных и более эффективно предсказывать будущие события, повышая стабильность обучения и точность прогнозирования.

Механизм самопрогнозирования, основанный на принципах предиктивного кодирования, используемого в мозге, повышает стабильность обучения нейронных сетей спайков (SNN). В рамках этого подхода, каждый нейрон прогнозирует собственную будущую активность, что позволяет сети более эффективно обрабатывать временные зависимости в данных. Самопрогнозирование снижает влияние затухающих градиентов, возникающих при обучении глубоких SNN, и обеспечивает более надежное распространение сигнала во времени. Это, в свою очередь, улучшает способность сети к распознаванию и обработке сложных временных паттернов, что критически важно для задач, требующих анализа последовательностей данных.

Предложенный подход заключается в расширении существующих моделей нейронов, таких как Leaky Integrate-and-Fire (LIF), Parametric LIF (PLIF), Complementary LIF (CLIF) и Integrate-and-Fire (IF), путем добавления механизма предсказания собственной будущей активности. Реализация данного механизма предполагает интеграцию сигнала предсказания в уравнение обновления состояния нейрона, что позволяет ему учитывать ожидаемую активность при обработке входящих сигналов. Это достигается путем добавления компонента, пропорционального предсказанной активности, к сумме синаптических входов и смещения, формируя тем самым обновленное значение мембранного потенциала. Данное расширение не требует существенной переработки архитектуры существующих SNN и может быть применено к различным типам нейронов без изменения базовых принципов их функционирования.

Прямое обучение и обучение с подкреплением: новый горизонт для спайковых сетей

Традиционные методы конвертации искусственных нейронных сетей (ANN) в нейронные сети с импульсами (SNN) обычно основываются на предварительно обученных ANN. Это означает, что веса SNN инициализируются и формируются на основе знаний, полученных ANN, а не обучаются непосредственно в импульсном режиме. Такой подход ограничивает потенциал SNN для освоения действительно «родного» импульсного обучения, поскольку архитектура и параметры сети предопределены заранее. В результате, SNN не может полностью использовать преимущества импульсной обработки, такие как энергоэффективность и временная кодировка информации, для оптимизации производительности и адаптации к новым задачам.

В отличие от традиционных методов преобразования ANN в SNN, требующих предварительно обученных сетей, мы предлагаем подход прямой тренировки (Direct Training), оптимизирующий веса SNN напрямую, «end-to-end». Ключевым аспектом является использование суррогатных градиентов (surrogate gradients) для обхода проблемы недифференцируемости спайков. Поскольку функция активации нейрона в SNN, выдающая спайк, не имеет производной, суррогатный градиент заменяет её дифференцируемой аппроксимацией, позволяя алгоритмам обратного распространения ошибки (backpropagation) эффективно обучаться. Это позволяет оптимизировать веса SNN непосредственно на основе функции потерь, определяемой целевой задачей, без необходимости полагаться на предварительно обученные ANN.

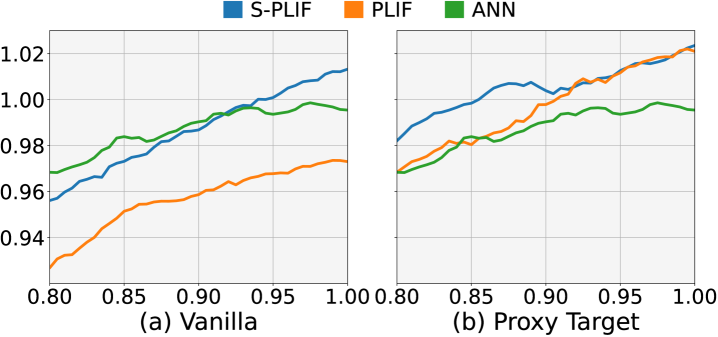

Для дальнейшего улучшения процесса обучения нейронных сетей с импульсной передачей (SNN), используется обучение с подкреплением, в частности, алгоритм TD3 (Twin Delayed Deep Deterministic policy gradient) и фреймворк Proxy Target. TD3 позволяет эффективно решать задачи непрерывного управления, снижая переоценку Q-значений и стабилизируя процесс обучения. Фреймворк Proxy Target использует отдельные целевые сети для оценки и обновления, что способствует более стабильному обучению и предотвращает расхождение политики. Данный подход позволяет SNN обучаться посредством взаимодействия со средой, корректируя веса на основе получаемого вознаграждения и позволяя сети осваивать стратегии, необходимые для достижения поставленной цели.

Наш подход комбинирует пластичность, зависящую от времени спайков (STDP), с использованием суррогатных градиентов, обеспечивая биологически обоснованное и эффективное правило обучения для SNN. STDP, моделирующая синаптическую пластичность на основе временной разницы между пре- и постсинаптическими спайками, дополняется суррогатными градиентами для преодоления проблемы недифференцируемости спайков, позволяя выполнять градиентный спуск. Экспериментальные результаты демонстрируют, что обученные таким образом SNN достигают, а в некоторых случаях и превосходят, производительность искусственных нейронных сетей (ANN) в задачах обучения с подкреплением, что подтверждает эффективность предложенного метода обучения.

Перспективы и будущее нейроморфных вычислений

Исследование демонстрирует принципиальную возможность непосредственной тренировки высокопроизводительных нейронных сетей с импульсной передачей данных (SNN), что открывает новые перспективы в области искусственного интеллекта. Традиционно, SNN обучались путем преобразования уже обученных искусственных нейронных сетей (ANN), что накладывало ограничения на их потенциальную производительность и энергоэффективность. Предложенный подход позволяет избежать этих ограничений, напрямую оптимизируя параметры SNN с использованием биологически правдоподобных правил обучения. Это позволяет создавать системы, более эффективно обрабатывающие временные данные и обладающие значительно меньшим энергопотреблением по сравнению с традиционными подходами, что особенно важно для применения в мобильных устройствах и робототехнике.

Механизм самопрогнозирования значительно повышает стабильность обучения и возможности обработки временных рядов в нейронных сетях с импульсной передачей данных (SNN). Этот подход, имитирующий предсказание будущих состояний нейронами, позволяет сети более эффективно адаптироваться к изменяющимся условиям и шумам, что особенно важно для применения в робототехнике и обработке данных с датчиков. Благодаря возможности прогнозировать собственные входные сигналы, сеть становится менее зависимой от внешних стимулов и способна формировать более устойчивые внутренние представления, что обеспечивает надежную работу в реальном времени и улучшает способность к распознаванию сложных последовательностей событий. В контексте робототехники, это позволяет роботам более точно реагировать на динамическую среду, а в системах обработки данных с датчиков — эффективно фильтровать шум и извлекать полезную информацию из временных сигналов.

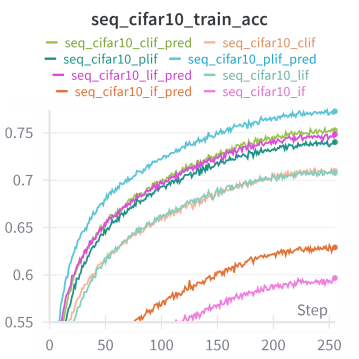

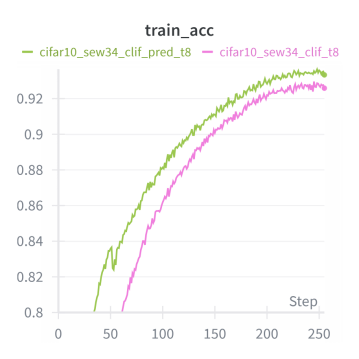

Исследование демонстрирует перспективный подход к созданию принципиально новых нейроморфных систем, объединяя прямое обучение, обучение с подкреплением и биологически правдоподобные правила обучения. Данная методика последовательно улучшает производительность в широком спектре архитектур искусственных нейронных сетей (SNN), моделей нейронов и задач, включая классификацию изображений и последовательную классификацию данных. В отличие от традиционных методов, основанных на преобразовании искусственных нейронных сетей, прямое обучение позволяет создавать более эффективные и энергосберегающие системы, приближающиеся к принципам работы биологического мозга. Полученные результаты указывают на возможность построения интеллектуальных систем, способных к адаптации и обучению в реальном времени, что открывает новые горизонты для развития периферийных вычислений и искусственного интеллекта.

Дальнейшие исследования направлены на масштабирование представленных методов для применения к сетям большего размера и решению более сложных задач. Особое внимание уделяется возможностям развертывания этих технологий на периферийных устройствах, что потенциально может привести к революции в области периферийных вычислений и искусственного интеллекта. Увеличение масштаба позволит обрабатывать более объемные и сложные данные непосредственно на устройствах, снижая задержки и потребление энергии, что критически важно для таких приложений, как автономная робототехника, обработка сенсорной информации в реальном времени и интеллектуальные системы видеонаблюдения. Ожидается, что успешное масштабирование не только повысит производительность, но и откроет новые возможности для разработки энергоэффективных и интеллектуальных систем, способных к обучению и адаптации в динамических условиях.

Исследование демонстрирует стремление к оптимизации работы нейронных сетей, позволяя им предсказывать собственную активность. Этот подход, хотя и кажется сложным, на самом деле является воплощением принципа, который так любила Грейс Хоппер: «Лучший способ объяснить — это сделать». В данном случае, ‘сделать’ означает не просто построить сеть, но и научить ее предвидеть собственные шаги, тем самым повышая ее эффективность и приближая к биологической правдоподобности. Акцент на само-предсказании, предложенный в работе, является не просто техническим усовершенствованием, а скорее элегантным решением, которое позволяет системе учиться на собственном опыте, подобно тому, как это делает живой мозг.

Что дальше?

Представленная работа, по сути, лишь обнажила очередную поверхность сложной системы, известной как искусственная нейронная сеть. Улучшение самопрогнозирования спайковых нейронов — это не столько достижение, сколько указание на фундаментальную проблему: нейрон должен ‘знать’, что будет делать сам с собой. Это напоминает попытку взломать собственный мозг, предугадать собственные импульсы. До тех пор, пока такая самореференция остается упрощенной моделью, истинная эффективность и биологическая правдоподобность остаются вопросом.

Очевидным направлением является выход за рамки простых предсказаний активности. Необходимо исследовать более сложные модели, учитывающие не только момент спайка, но и его амплитуду, форму и контекст. Более того, текущий подход, опирающийся на градиентный спуск, хоть и эффективен, но далек от биологической реальности. Поиск альтернативных алгоритмов обучения, имитирующих синаптическую пластичность, остается критически важной задачей.

В конечном итоге, успех в этой области будет зависеть от способности выйти за рамки простого улучшения производительности. Необходимо понять, как самопрогнозирование влияет на общую вычислительную архитектуру, на энергетическую эффективность и на способность сети к адаптации и обучению в реальном времени. Это не просто инженерия, это реверс-инжиниринг сознания, пусть и в кремниевом воплощении.

Оригинал статьи: https://arxiv.org/pdf/2601.21823.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Отражения культуры: Как языковые модели рассказывают истории

- Квантовые Заметки: Прогресс и Парадоксы

- Звуковая фабрика: искусственный интеллект, создающий музыку и речь

- Квантовый оптимизатор: Новый подход к сложным задачам

- Кванты в Финансах: Не Шутка!

- Гармония в коде: Распознавание аккордов с помощью глубокого обучения

- Взлом языковых моделей: эволюция атак, а не подсказок

- Квантовый скачок из Андхра-Прадеш: что это значит?

- Квантовые симуляторы: точное вычисление энергии основного состояния

- Искусственный интеллект на допросе: как объяснить решения в цифровой криминалистике?

2026-01-31 05:35