Автор: Денис Аветисян

Новое исследование сравнивает эффективность графовых нейронных сетей и классических алгоритмов при решении сложных задач поиска решений.

Проведен сравнительный анализ графовых нейронных сетей в контексте задач удовлетворения ограничений, демонстрирующий их текущую уязвимость по сравнению с традиционными подходами при масштабировании на более сложные экземпляры.

Несмотря на растущий интерес к применению графовых нейронных сетей (ГНС) для решения сложных оптимизационных задач, обоснованность заявлений об их превосходстве над классическими алгоритмами часто остается под вопросом. В работе ‘Benchmarking Graph Neural Networks in Solving Hard Constraint Satisfaction Problems’ предложен новый набор бенчмарков, основанный на принципах статистической физики, для оценки эффективности ГНС в задачах удовлетворения ограничений. Полученные результаты демонстрируют, что классические алгоритмы пока что превосходят ГНС, особенно при масштабировании на более сложные экземпляры задач. Какие архитектурные и алгоритмические улучшения необходимы для раскрытия потенциала ГНС в решении трудноразрешимых задач комбинаторной оптимизации?

Пределы Классических Подходов к Задачам Удовлетворения Ограничениям

Традиционные алгоритмы решения задач удовлетворения ограничениям (CSPs), такие как WalkSAT и Survey_Propagation, демонстрируют свою эффективность лишь в пределах определенной сложности. По мере увеличения масштаба и взаимосвязанности ограничений, эти методы начинают испытывать серьезные трудности. Проблема заключается в том, что пространство поиска решений становится экспоненциально большим, и алгоритмы часто оказываются в локальных оптимумах, не способных найти глобально оптимальное решение. Эффективность этих подходов резко снижается при решении задач с высокой степенью связанности и большим количеством переменных, что подчеркивает необходимость разработки новых стратегий, способных преодолеть эти ограничения и обеспечить масштабируемость при решении сложных CSP.

Традиционные алгоритмы решения задач удовлетворения ограничениям (CSP) часто сталкиваются с трудностями, попадая в локальные оптимумы или становясь вычислительно непрактичными из-за специфической структуры «застекленевших» энергетических ландшафтов, характерных для сложных задач. Данные ландшафты, усеянные множеством локальных минимумов, напоминают разбитое стекло — алгоритм может «застрять» в одной из этих ловушек, не находя глобального решения. Это происходит потому, что небольшие изменения в параметрах задачи приводят к значительным колебаниям «энергии» системы, делая поиск оптимального решения крайне сложным и требующим экспоненциального увеличения вычислительных ресурсов. Таким образом, структура энергетического ландшафта является ключевым фактором, определяющим сложность решения задачи, и представляет собой серьезное препятствие для классических алгоритмов.

Существенным препятствием для развития новых методов решения задач удовлетворения ограничениям (CSP) является отсутствие унифицированных, стандартизированных наборов данных для объективного сравнения с классическими алгоритмами. В настоящее время, традиционные подходы, такие как WalkSAT и Survey Propagation, демонстрируют высокую эффективность даже при увеличении масштаба задач, что создает серьезный вызов для современных методов машинного обучения. Отсутствие общепринятых критериев оценки не позволяет точно определить, превосходят ли новые подходы существующие, или же их успех обусловлен особенностями конкретных тестовых примеров. Это затрудняет прогресс в области и замедляет внедрение инновационных решений, поскольку сложно однозначно подтвердить их преимущества на практике.

Физически Вдохновлённый Бенчмарк для Надёжной Оценки

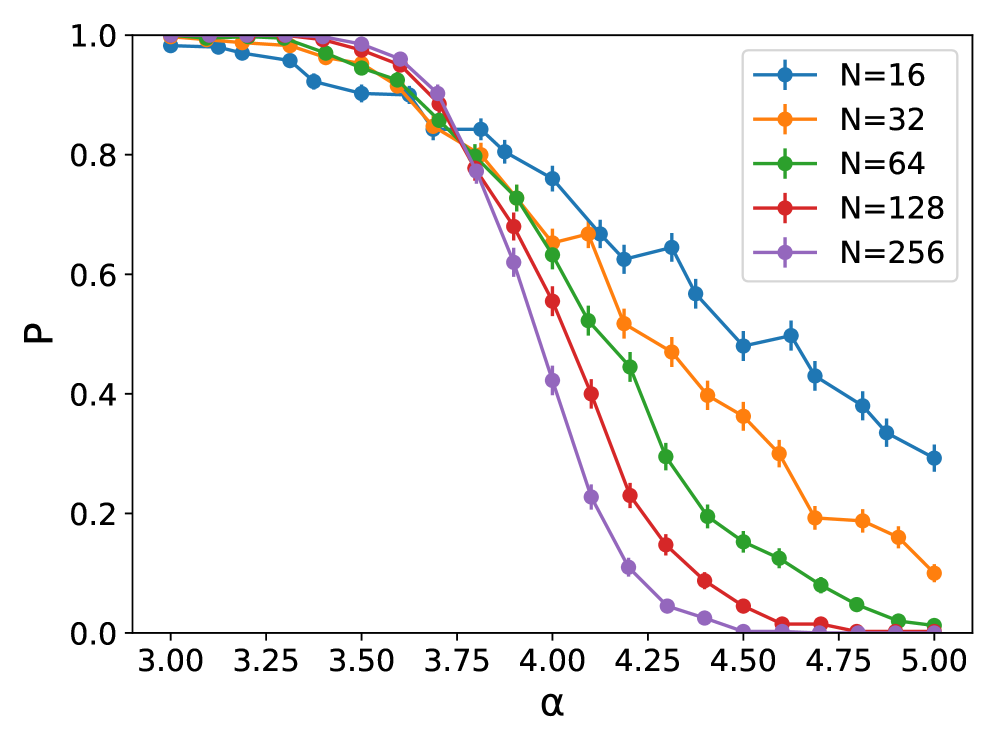

Представленный нами новый бенчмарк разработан с использованием подхода, вдохновлённого статистической физикой. В его основе лежат концепции фазовых переходов и энергетических ландшафтов, позволяющие моделировать сложность задач комбинаторной оптимизации. В частности, структура бенчмарка построена таким образом, чтобы отражать изменения в решаемости задач при приближении к критическим точкам, аналогичным фазовым переходам в физических системах. Энергетический ландшафт, определяемый структурой задачи, характеризуется распределением «энергии» (стоимости решения) по пространству возможных решений, что позволяет анализировать эффективность алгоритмов поиска в зависимости от сложности этого ландшафта. Такой подход позволяет более точно оценивать производительность решателей задач комбинаторной оптимизации (CSP) в условиях, приближенных к реальным задачам.

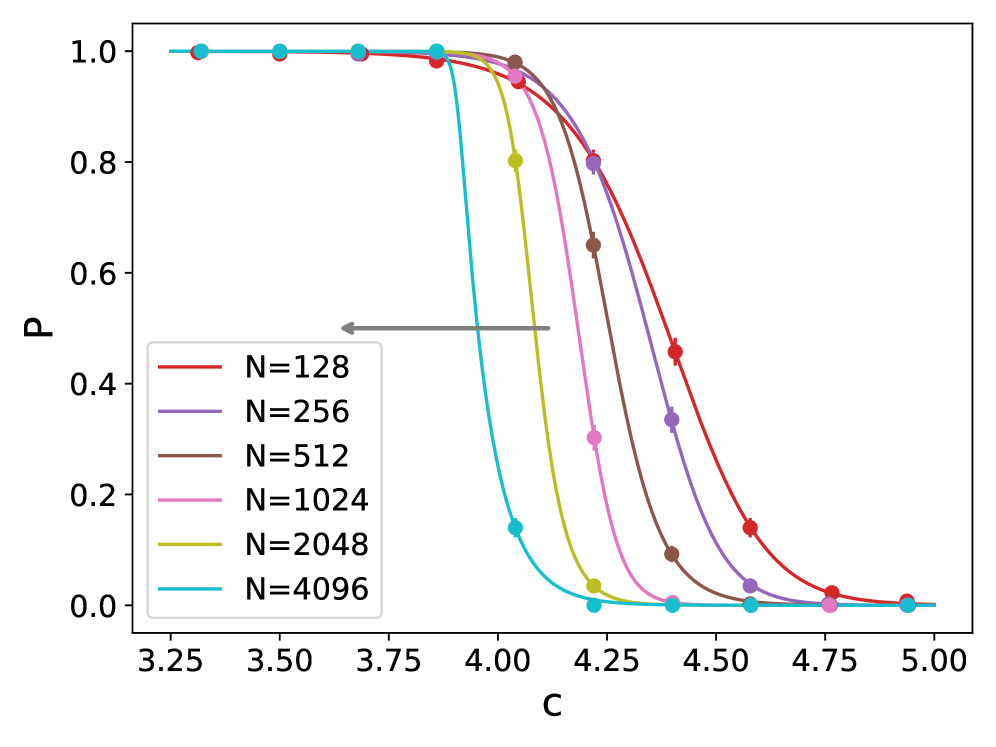

Бенчмарк организован по уровням сложности, которые определяются не только размером задачи, но и параметрами, контролирующими её внутреннюю сложность. Это позволяет проводить детальный анализ производительности решателей задач, выявляя их слабые места при изменении характеристик задачи, а не только при увеличении её масштаба. В частности, параметры позволяют управлять степенью связности ограничений и плотностью переменных, что напрямую влияет на сложность поиска решения и позволяет создавать задачи, приближающиеся к порогам алгоритмической эффективности решателей.

Предлагаемый нами подход к разработке бенчмарка призван преодолеть ограничения существующих тестовых наборов для оценки решателей задач ограничений (CSP). Традиционные бенчмарки часто не отражают реальную сложность задач и не позволяют адекватно оценить производительность алгоритмов вблизи пороговых значений, где большинство решателей испытывают значительные трудности. Наш бенчмарк обеспечивает возможность анализа поведения решателей при приближении к этим критическим точкам, что позволяет более точно определить их эффективность и устойчивость в сложных сценариях. Это особенно важно для задач, где незначительное увеличение размера или сложности может привести к резкому увеличению времени решения или даже к невозможности нахождения решения.

Графовые Нейронные Сети как Решатели CSP: Новый Подход

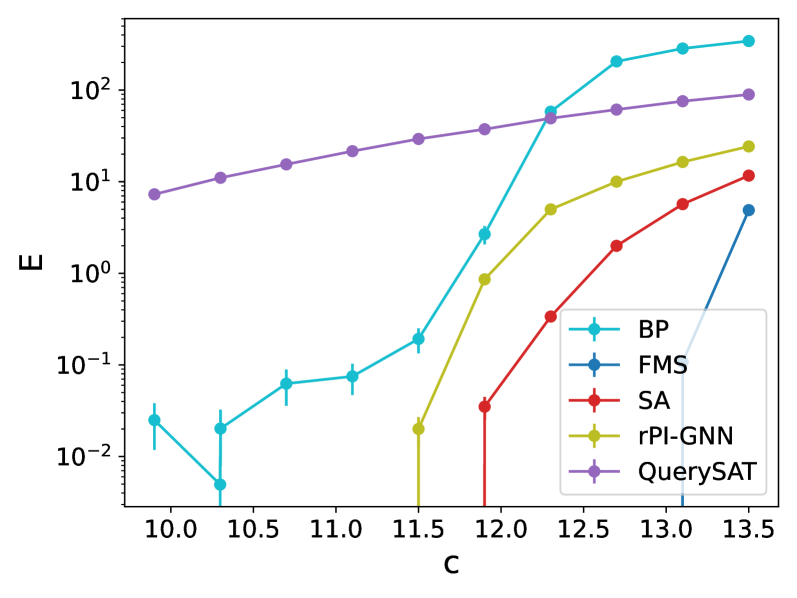

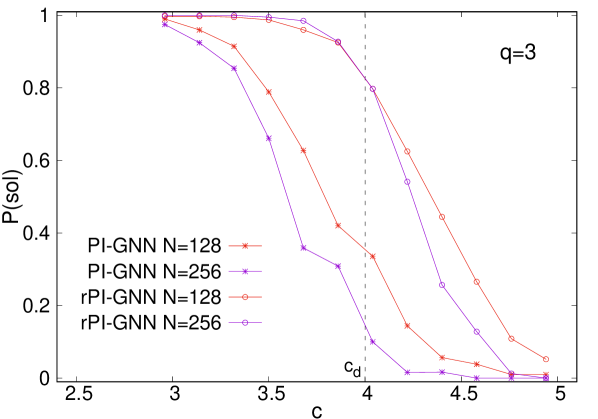

В последние годы наблюдается растущий интерес к применению методов машинного обучения, в частности графовых нейронных сетей (ГНС), в качестве альтернативы традиционным решателям задач ограничения (CSP). ГНС позволяют представлять задачи CSP в виде графов, где узлы соответствуют переменным, а ребра — ограничениям. Это представление позволяет использовать возможности ГНС для обучения эффективным эвристикам и стратегиям поиска решений, потенциально обходя ограничения классических алгоритмов, таких как back-tracking и constraint propagation. Примерами ГНС, применяемых для решения CSP, являются NeuroSAT, QuerySAT и rPI_GNN, демонстрирующие способность к обучению и адаптации к различным типам задач.

Нейросети, такие как NeuroSAT, QuerySAT и rPI_GNN, демонстрируют способность к обучению эффективным эвристикам и навигации в сложных пространствах решений для задач, формализуемых как задачи удовлетворения ограничений (CSP). Эти графовые нейронные сети (GNN) используют архитектуры, позволяющие им извлекать признаки из графового представления задачи и применять их для предсказания переменных, участвующих в решении. В отличие от традиционных алгоритмов CSP, которые полагаются на заранее заданные правила и эвристики, GNN способны адаптироваться к конкретным характеристикам задачи в процессе обучения, потенциально обнаруживая более эффективные стратегии поиска решения. Обучение происходит на основе данных, включающих примеры задач и соответствующие решения, что позволяет сети формировать внутреннее представление о структуре задачи и ее оптимальных решениях.

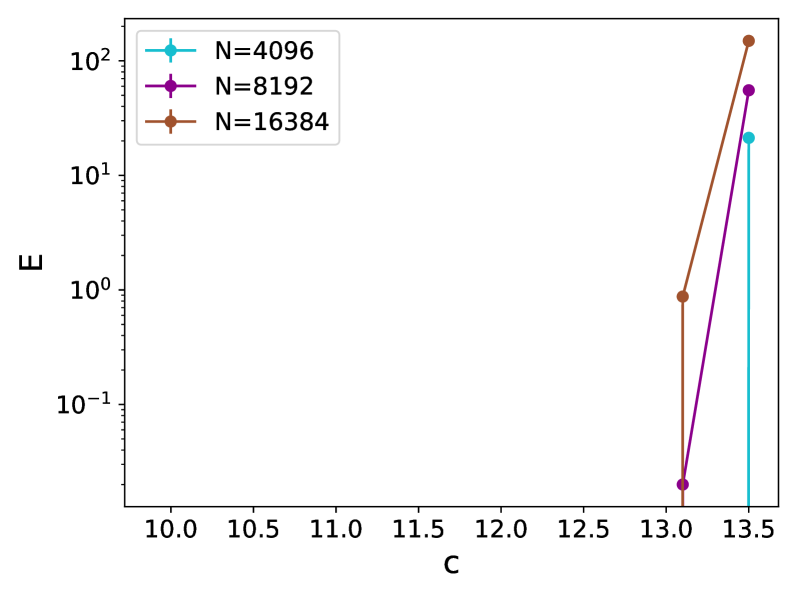

Эффективное обучение и оценка нейронных решателей, таких как графовые нейронные сети (GNN), требует особого внимания к масштабируемости времени инференса с ростом размера задачи и применению методов неконтролируемого обучения. На текущий момент, наши результаты демонстрируют, что GNN уступают классическим алгоритмам при решении сложных задач, особенно при увеличении масштаба. В то время как классические алгоритмы сохраняют стабильную производительность, время инференса GNN растет непропорционально, что ограничивает их применимость к задачам большого размера. Неконтролируемое обучение рассматривается как потенциальный подход для улучшения обобщающей способности и снижения зависимости от размеченных данных, необходимых для обучения.

За Пределами Современных Методов: Последствия и Перспективы

Работа подчеркивает критическую роль разработки эталонных наборов данных в стимулировании прогресса в области решения задач комбинаторной оптимизации (CSP). Традиционные наборы данных часто не отражают всей сложности реальных задач, что ограничивает возможности оценки и совершенствования алгоритмов. Именно продуманный дизайн эталонных наборов, включающий разнообразные и сложные экземпляры задач, позволяет более точно измерить производительность алгоритмов, выявить их слабые места и, как следствие, ускорить разработку более надежных и эффективных решений. Отсутствие адекватных эталонов замедляет прогресс, в то время как тщательно разработанные наборы данных служат катализатором инноваций и позволяют исследователям сосредоточиться на создании действительно прорывных алгоритмов.

Разработка более сложной и детализированной системы оценки является ключевым фактором для стимулирования прогресса в создании алгоритмов решения задач комбинаторной оптимизации. Традиционные наборы данных часто не отражают всей сложности реальных сценариев, что приводит к разработке алгоритмов, хорошо работающих в лабораторных условиях, но сталкивающихся с трудностями при решении практических задач. Предоставление алгоритмам более разнообразных и требовательных тестов позволяет выявить слабые места и стимулировать разработку более надежных и эффективных решений. Такой подход не только улучшает производительность существующих алгоритмов, но и открывает новые возможности для инноваций, подталкивая исследователей к поиску принципиально новых методов решения сложных задач оптимизации.

Будущие исследования направлены на изучение пределов возможностей решателей, основанных на графовых нейронных сетях (GNN), и разработку новых методов повышения их масштабируемости и способности к обобщению. Особое внимание уделяется рекуррентному механизму в архитектуре rPI-GNN, который демонстрирует значительное улучшение производительности. Этот механизм позволяет модели учитывать информацию о предыдущих шагах решения, что особенно важно для сложных задач комбинаторной оптимизации. Предварительные результаты указывают на то, что дальнейшее развитие и оптимизация рекуррентных GNN могут привести к созданию более эффективных и универсальных решателей, способных успешно справляться с задачами, которые остаются сложными для существующих алгоритмов. Исследователи планируют изучить различные варианты рекуррентных связей и методы обучения, чтобы максимально раскрыть потенциал данного подхода.

Исследование показывает, что графовые нейронные сети, несмотря на весь ажиотаж, пока что уступают классическим алгоритмам при решении сложных задач удовлетворения ограничений. Неудивительно. Каждая «революционная» технология завтра станет техдолгом. Попытки применить нейронные сети к задачам, где десятилетиями работали эффективные алгоритмы, выглядят как переизобретение велосипеда, только с большим количеством параметров и надеждой на финансирование. Как справедливо заметила Симона де Бовуар: «Старость — это не состояние души, а состояние тела». То же самое можно сказать и о производительности этих сетей — рано или поздно, при увеличении сложности задачи, они неизбежно столкнутся с ограничениями аппаратного обеспечения и алгоритмической неэффективностью. И сейчас это назовут AI и получат инвестиции.

Что дальше?

Представленное исследование, тщательно замерив производительность графовых нейронных сетей в решении задач удовлетворения ограничений, выявило закономерность, которую опытный инженер предвидел заранее. Нейронные сети демонстрируют потенциал, но пока уступают классическим алгоритмам, особенно при масштабировании на более сложные экземпляры. Это не открытие, а скорее подтверждение того, что «революция» требует времени — и, вероятно, значительного технического долга. Каждая новая архитектура, обещающая прорыв, рано или поздно столкнётся с необходимостью оптимизации и адаптации к реальным данным.

В ближайшем будущем следует ожидать попыток преодолеть выявленные ограничения, вероятно, за счет более сложных моделей и гибридных подходов. Однако, стоит помнить, что увеличение сложности часто приводит к увеличению накладных расходов. Реальная ценность будет заключаться не в создании очередного «улучшенного» алгоритма, а в понимании, когда и где нейронные сети действительно превосходят существующие решения. И, конечно, в честном признании того, что «MVP — это просто способ сказать пользователю: подожди, мы потом исправим».

Исследование, по сути, ставит вопрос о границах применимости графовых нейронных сетей. Если код выглядит идеально — значит, его ещё никто не деплоил. Перспективы, безусловно, есть, но заманчивые обещания «революции» следует воспринимать со здоровым скептицизмом. Продакшен всегда найдёт способ сломать элегантную теорию.

Оригинал статьи: https://arxiv.org/pdf/2602.18419.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Виртуальная примерка без границ: EVTAR учится у образов

- Реальность и Кванты: Где Встречаются Теория и Эксперимент

- Квантовый скачок: от лаборатории к рынку

2026-02-23 22:27