Автор: Денис Аветисян

Новое исследование показывает, что обучение с подкреплением не улучшает качество векторных представлений текста, но существенно меняет их внутреннюю организацию.

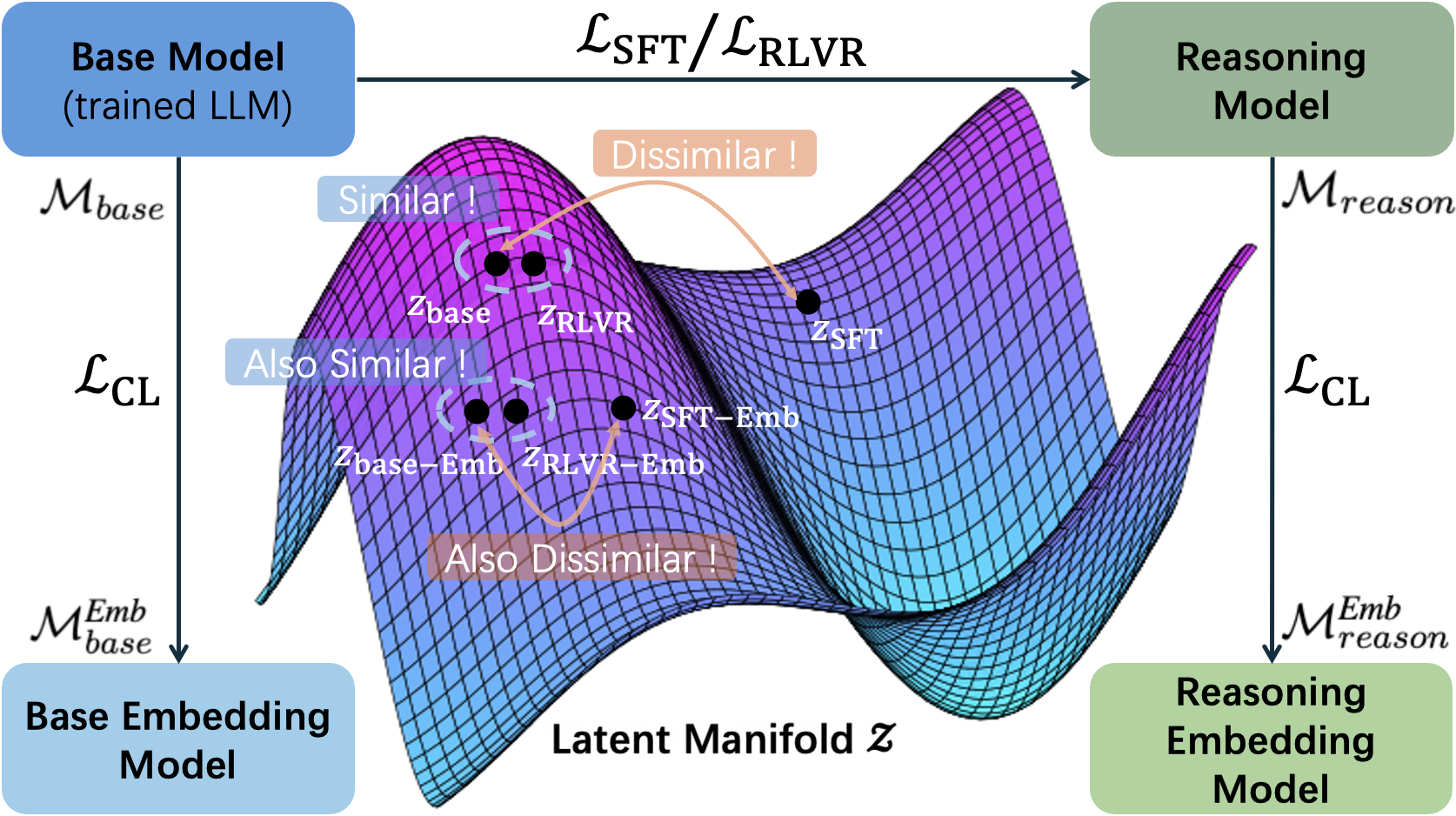

Работа демонстрирует, что обучение с подкреплением с верифицируемыми наградами (RLVR) приводит к перестройке локальной геометрии латентного многообразия, сохраняя при этом его глобальную структуру — явление, названное «Выравниванием многообразия».

Неочевидно, что улучшение способности языковой модели к логическим рассуждениям автоматически приводит к повышению качества генерируемых ею семантических представлений. В работе ‘Do Reasoning Models Enhance Embedding Models?’ исследуется, способствуют ли модели, обученные с подкреплением на основе верифицируемых вознаграждений (RLVR), созданию более качественных текстовых вложений. Полученные результаты демонстрируют отсутствие существенной разницы в производительности между вложениями, инициализированными RLVR-оптимизированными моделями, и их базовыми аналогами, несмотря на реорганизацию локальной геометрии латентного пространства. Предложенный фреймворк иерархического анализа схожести представлений (HRSA) показывает, что RLVR, по сути, не меняет глобальную структуру семантического пространства, а лишь перестраивает локальные отношения, что получило название “Выравнивание Многообразий”. Какие механизмы лежат в основе этого явления и как можно использовать RLVR для целенаправленной модификации семантического пространства?

Раскрывая Скрытое Многообразие

Современные модели эмбеддингов, основанные на крупных языковых моделях, таких как DeepSeek и Qwen3, используют так называемое “латентное многообразие” для представления семантического значения текстов. Это многообразие, по сути, является пространством меньшей размерности, в котором каждый текст кодируется как точка. Расположение этих точек отражает смысловую близость текстов: тексты со схожим значением располагаются близко друг к другу, а тексты с разным значением — далеко. Таким образом, латентное многообразие позволяет модели эффективно хранить и обрабатывать информацию о значениях слов и фраз, а также устанавливать связи между ними, формируя основу для понимания и генерации естественного языка. Именно благодаря этому представлению модели способны выполнять такие задачи, как семантический поиск, кластеризация текстов и машинный перевод.

Многомерное семантическое пространство, формируемое современными моделями встраивания, по сути, является сжатой, упрощенной версией огромного объема текстовых данных. Это пространство, известное как латентное многообразие, позволяет модели понимать и сопоставлять тексты, основываясь на их значении, но его внутренняя организация остается во многом загадкой. Структура этого пространства не универсальна; она зависит от конкретной архитектуры модели и данных, на которых она обучалась. Поэтому, хотя модель и способна эффективно обрабатывать текст, понимание того, как она это делает — как организуются понятия и связи в этом латентном пространстве — представляет собой серьезную задачу для исследователей, стремящихся к более прозрачным и надежным алгоритмам обработки естественного языка.

Понимание структуры латентного пространства, в котором современные языковые модели кодируют семантическую информацию, является ключевым для интерпретации их поведения и обеспечения надежной обобщающей способности. Это пространство, являющееся своего рода «сжатой» репрезентацией текста, определяет, как модель воспринимает взаимосвязи между различными понятиями и как она реагирует на незнакомые входные данные. Изучение организации этого пространства позволяет не только понять логику работы модели, но и выявить потенциальные слабые места, например, склонность к предвзятости или неспособность адекватно обрабатывать сложные запросы. В конечном итоге, глубокое понимание латентного пространства способствует созданию более надежных, предсказуемых и эффективных языковых моделей, способных к успешной работе в различных областях применения.

Современные методы выравнивания семантических пространств, такие как RLVR, представляют собой попытку навести порядок в латентном многообразии, лежащем в основе языковых моделей. Исследования показывают, что подобные процедуры не просто приводят пространства к соответствию, но и активно изменяют их геометрию. Вопрос о том, как именно происходит эта трансформация, и какие последствия она имеет для способности модели обобщать знания и понимать нюансы языка, является ключевым направлением современных исследований. Изменение геометрии латентного пространства может привести как к улучшению интерпретируемости модели, так и к неожиданным искажениям в представлении информации, что требует тщательного анализа и разработки новых методов контроля над процессом выравнивания.

Геометрия Сохранена, Локальность Перестроена

Анализ геометрии латентного пространства, выполненный с использованием Linear CKA, показывает, что RLVR в значительной степени сохраняет его глобальную геометрию. Показатели Linear CKA остаются высокими и стабильными на протяжении всего процесса обучения, что свидетельствует о минимальных изменениях в общей структуре латентного пространства. Это указывает на то, что RLVR не вносит существенных искажений в глобальные взаимосвязи между точками данных, несмотря на изменения, происходящие в локальной геометрии. Сохранение глобальной геометрии является ключевым свойством, позволяющим RLVR поддерживать семантическую согласованность и обобщающую способность.

Анализ, использующий метрику Cosine kk-NN Overlap, показал, что при сохранении глобальной геометрии латентного пространства, модели RLVR демонстрируют значительную реорганизацию локальной геометрии. Данная метрика измеряет степень перекрытия ближайших соседей (kk-NN) в латентном пространстве, и результаты показали более низкое значение перекрытия для моделей, обученных RLVR, по сравнению с моделями, настроенными методом SFT. Это указывает на изменение отношений между близко расположенными точками в латентном пространстве, при сохранении общей структуры пространства, что свидетельствует о реорганизации, а не о разрушении, локальных связей.

Анализ показывает, что RLVR не уничтожает семантическую структуру латентного пространства, а скорее реорганизует её, формируя новые локальные связи. Вместо разрушения существующих представлений, RLVR изменяет взаимоотношения между близкими точками, создавая альтернативные локальные конфигурации. Это подтверждается метрикой kk-NN Overlap, демонстрирующей снижение перекрытия между ближайшими соседями в моделях RLVR по сравнению с SFT-моделями, что указывает на перестройку локальной геометрии без потери глобальной структуры.

Метрика kk-NN Overlap демонстрирует количественное различие в организации локальной геометрии между моделями, обученными с использованием RLVR, и моделями, настроенными с помощью SFT. Анализ показывает, что при сохранении глобальной геометрии латентного пространства, локальные связи между ближайшими точками значительно перестраиваются в моделях RLVR. Более низкие значения kk-NN Overlap, зафиксированные для RLVR, указывают на уменьшение степени совпадения ближайших соседей по сравнению с моделями SFT, что подтверждает изменение локальной структуры данных в латентном пространстве.

Смещение Координат: Системный Сдвиг

Анализ представлений на уровне признаков выявил явление смещения базиса координат (Coordinate Basis Drift) при длительном обучении с подкреплением на основе обратной связи от человека (RLVR). Данное смещение проявляется в постепенном изменении системы координат, определяющей латентное пространство модели. Наблюдаемые изменения не являются случайными флуктуациями, а свидетельствуют о систематической переорганизации семантического пространства, в котором закодированы концепции. Измерения показали, что смещение базиса координат происходит по всем измерениям латентного пространства, что указывает на комплексный характер этого явления. Для выявления данного эффекта использовались метрики, оценивающие относительное положение векторов, представляющих различные концепции, в латентном пространстве до и после периода RLVR.

Анализ показал, что при длительном обучении с подкреплением (RLVR) происходит постепенное смещение системы координат, определяющей латентное пространство модели. Это не является критическим изменением глобальной геометрии пространства, однако указывает на переорганизацию представления семантических концептов. Фактически, способ, которым информация о концептах кодируется и позиционируется в латентном пространстве, изменяется, что отражает адаптацию модели к новым данным и задачам. Смещение координат проявляется в изменении векторов, представляющих семантические признаки, и влияет на взаимосвязи между концептами в латентном пространстве.

Анализ выявил, что смещение координат, наблюдаемое при длительном обучении с подкреплением на основе обратной связи от человека (RLVR), не является случайным процессом. Вместо этого, оно отражает системную реорганизацию семантического пространства модели. Данное явление указывает на переструктурирование представления концепций и их взаимосвязей внутри латентного пространства, что проявляется в изменении позиций и отношений между семантическими векторами. Реорганизация носит упорядоченный характер и не приводит к деградации общей геометрии пространства, но изменяет способ кодирования и представления информации.

Анализ корреляции по измерениям показал, что модели, обученные с использованием RLVR (Reinforcement Learning from Visual Representations), демонстрируют более высокую степень согласованности между измерениями латентного пространства по сравнению с моделями, обученными с использованием SFT (Supervised Fine-Tuning). Это указывает на то, что, несмотря на наблюдаемый сдвиг координат, RLVR модели сохраняют более четкое выравнивание осей и, следовательно, лучше сохраняют значимые признаки. Более высокая корреляция по измерениям свидетельствует о более структурированном представлении данных, где каждое измерение вносит более осмысленный вклад в кодирование семантических концепций, что позволяет моделям RLVR сохранять производительность после сдвига координат.

Анализ показывает, что при продолжительном обучении с подкреплением на основе обратной связи от человека (RLVR) глобальная геометрия латентного пространства сохраняется, однако происходит изменение в позиционировании и взаимосвязях между семантическими концепциями внутри этого пространства. Это означает, что относительное расположение концепций друг к другу меняется, хотя общая структура пространства при этом не деформируется. Конкретные координаты, определяющие местоположение каждой концепции, сдвигаются, что приводит к изменению в способе представления и организации семантической информации, но не к потере общей структуры или нарушению глобальной согласованности пространства.

Влияние на Перенос и Функциональность

Исследование влияния геометрических и координатных сдвигов на эффективность выполнения задач осуществлялось с применением кросс-модельных линейных проб и анализа на уровне функций. Данный подход позволил оценить, как изменения в пространстве представлений, вызванные различными методами выравнивания, сказываются на способности модели обобщать знания и адаптироваться к новым задачам. Анализ линейных проб, направленных на извлечение информации из внутренних представлений моделей, выявил, что даже при значительных сдвигах координат, сохраняется возможность извлечения полезных сигналов, однако для этого может потребоваться адаптация механизмов чтения информации. Полученные результаты подчеркивают важность не только выравнивания представлений, но и понимания последствий координатных сдвигов для обеспечения надежности и обобщающей способности моделей машинного обучения.

Исследования показали, что применение RLVR (Rotation and Translation Vector Regression) способно улучшить процесс переноса обучения в определенных сценариях, однако данный метод сопряжен с возникновением смещения координатной системы, которое усложняет передачу знаний. Это смещение, по сути, меняет “ориентацию” информации в векторном пространстве, что может потребовать адаптации последующих слоев модели для правильной интерпретации данных. В результате, несмотря на потенциальные улучшения в общей производительности, необходимо учитывать и нивелировать последствия этого координатного дрейфа для обеспечения надежной и эффективной передачи знаний между моделями и задачами. Данный эффект требует внимательного анализа при построении обобщающих моделей, поскольку может влиять на интерпретируемость и стабильность предсказаний.

Несмотря на наблюдаемое смещение координат в процессе переноса знаний, исследования показали сохранение высокой точности при использовании линейных пробников. Этот результат указывает на то, что направления извлечения информации, критически важные для принятия решений моделью, остаются стабильными, даже когда внутреннее представление данных претерпевает геометрические изменения. Фактически, модель способна адаптироваться к новым координатным системам, сохраняя при этом способность правильно интерпретировать входные данные и выдавать точные прогнозы. Это свидетельствует о том, что хотя смещение координат и требует определенных адаптаций, базовая структура знаний, закодированная в параметрах модели, остается неповрежденной и доступной для использования в новых контекстах.

Исследования показали, что смещение системы координат, возникающее при переносе знаний между моделями, может потребовать адаптации линейных методов чтения информации. Это означает, что для корректной интерпретации прогнозов модели, необходимо учитывать изменения в способе представления данных. В частности, если модель обучена в одной системе координат, а используется в другой, то стандартные линейные методы анализа могут давать неточные результаты, снижая надежность и устойчивость предсказаний. Такое смещение может привести к необходимости переобучения или применения специальных алгоритмов коррекции, чтобы обеспечить адекватную интерпретацию и сохранить высокую точность модели в новых условиях. Понимание влияния смещения координат критически важно для разработки обобщаемых и надежных моделей машинного обучения.

Исследования показывают, что, несмотря на положительное влияние выравнивания векторных представлений, для создания надежных и обобщающих моделей внедрения необходимо тщательно учитывать и смягчать проблему смещения координатных систем. Наблюдаемое смещение может потребовать адаптации линейных методов чтения информации, что, в свою очередь, влияет на интерпретируемость и устойчивость прогнозов модели. Понимание механизмов, вызывающих это смещение, и разработка стратегий для его компенсации являются ключевыми шагами к построению систем, способных эффективно переносить знания между различными задачами и доменными областями, обеспечивая более стабильную и предсказуемую производительность в реальных условиях.

Исследование демонстрирует, что обучение с подкреплением, хоть и не улучшает качество самих текстовых представлений, существенно перестраивает локальную геометрию латентного многообразия. Это напоминает попытку не создать идеальную карту, а скорее изменить ландшафт, не трогая общие ориентиры. Как метко заметил Анри Пуанкаре: «Математика не учит нас открывать новые связи, а лишь дает возможность увидеть те, что уже существуют». В данном контексте, RLVR не создает новые представления, а реорганизует существующие, выявляя скрытые связи и уточняя локальные отношения между ними, подобно тому, как математик находит закономерности в уже известных данных. Основная концепция ‘Перестройки Многообразия’ подтверждает, что изменения происходят внутри существующей структуры, а не за ее пределами.

Что дальше?

Представленные результаты показывают, что попытки «улучшить» векторные представления текста с помощью обучения с подкреплением часто приводят не к повышению качества, а к перестройке локальной геометрии латентного пространства. Это напоминает алхимию: не создание золота, а лишь изменение формы существующего металла. Глобальная структура, фундамент семантических связей, остается нетронутым, словно скелет, скрытый под новыми «мускулами» представления. Вместо поиска абсолютной «лучшести» следует признать, что каждая новая архитектура обещает свободу, пока не потребует DevOps-жертвоприношений.

Вопрос, однако, заключается в том, что эта «перестройка многообразия» дает нам на практике. Если это лишь изменение координат, а не углубление понимания семантики, то ценность ее сомнительна. Порядок — просто временный кэш между сбоями, и переупорядочивание векторов не решит проблем с неоднозначностью языка. Следующим шагом видится не поиск новых алгоритмов «улучшения», а исследование устойчивости этих перестроек к шуму и возмущениям, а также разработка метрик, способных оценить не только «качество», но и «устойчивость» векторных представлений.

Системы — это не инструменты, а экосистемы. Их нельзя построить, только вырастить. Попытки «принудительной оптимизации» латентного пространства могут привести к непредсказуемым последствиям, а истинный прогресс лежит в понимании того, как эти пространства формируются естественным образом, в процессе взаимодействия с языком и миром. Искать совершенство в координатах — бессмысленно, необходимо понимать правила игры, определяющие формирование этих координат.

Оригинал статьи: https://arxiv.org/pdf/2601.21192.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Отражения культуры: Как языковые модели рассказывают истории

- Взлом языковых моделей: эволюция атак, а не подсказок

- Гармония в коде: Распознавание аккордов с помощью глубокого обучения

- Визуальный след: Сжатие рассуждений для мощных языковых моделей

- Робот-манипулятор: обучение взаимодействию с миром с помощью зрения от первого лица

- Квантовый оптимизатор: Новый подход к сложным задачам

- Молекулярный конструктор: Искусственный интеллект на службе создания лекарств

- Кванты в Финансах: Не Шутка!

- Искусственный исследователь: как нейросети справляются с долгосрочными задачами

- Научные эксперименты с ИИ: новая платформа для проверки интеллекта

2026-02-01 23:26