Автор: Денис Аветисян

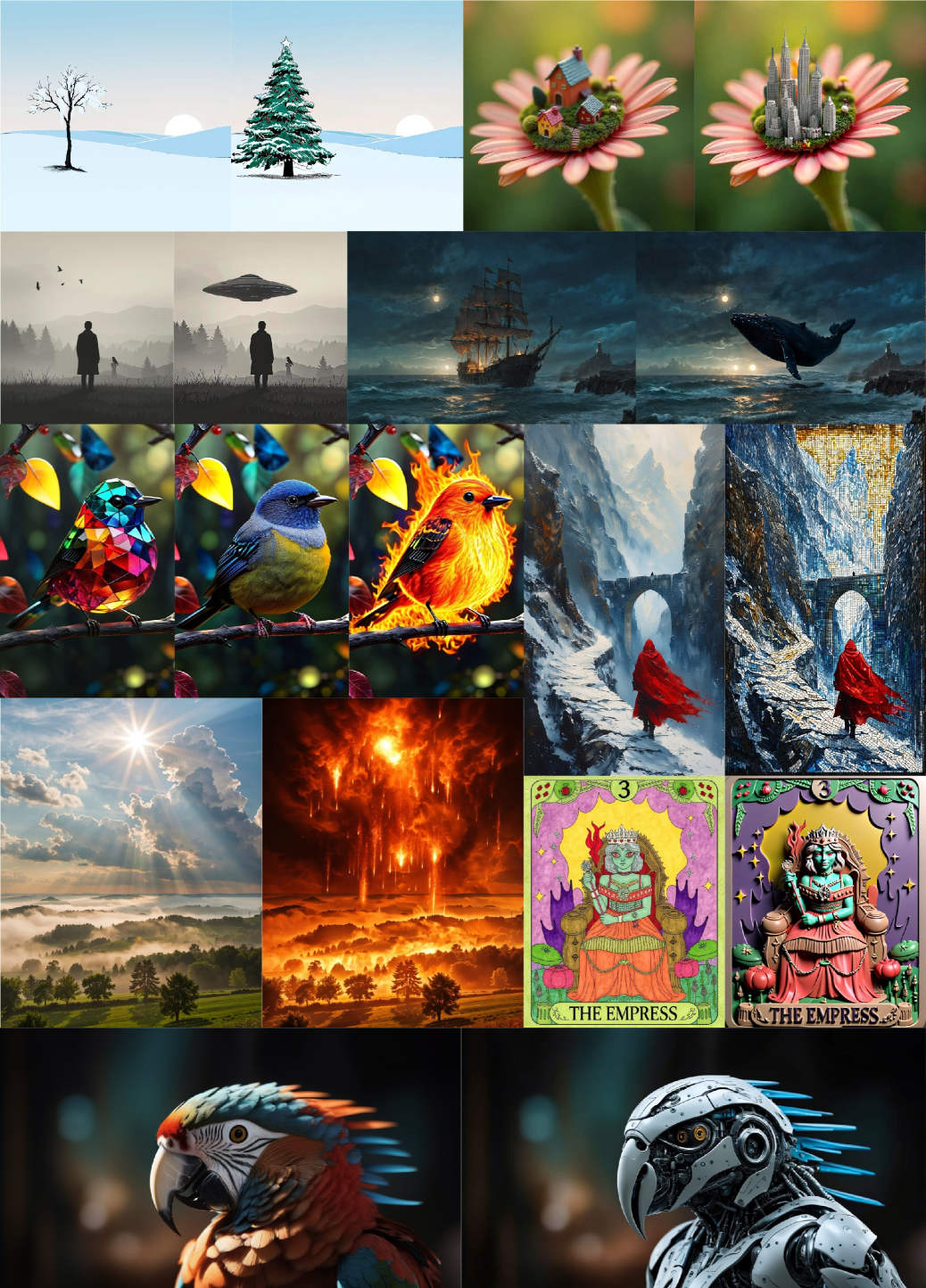

В статье представлена система VIBE, позволяющая изменять изображения на основе текстовых инструкций с высокой точностью и эффективностью.

VIBE использует диффузионные модели и оптимизацию Direct Preference Optimization (DPO) для достижения впечатляющих результатов при относительно небольшом размере модели.

Несмотря на стремительное развитие генеративных моделей, создание компактных и эффективных систем редактирования изображений по текстовым инструкциям остается сложной задачей. В данной работе представлена система VIBE: Visual Instruction Based Editor, демонстрирующая высокую производительность при значительно меньшем размере модели, благодаря оптимизации архитектуры, качеству данных и многоэтапному процессу обучения. Наши эксперименты показывают, что VIBE достигает сопоставимых или превосходящих результатов по сравнению с более крупными аналогами, особенно в задачах, требующих сохранения исходного изображения. Сможет ли подобный подход открыть новые возможности для развертывания мощных инструментов редактирования изображений на устройствах с ограниченными вычислительными ресурсами?

Иллюзия контроля: новый взгляд на редактирование изображений

Традиционные инструменты для редактирования изображений, такие как Adobe Photoshop или GIMP, зачастую требуют от пользователя длительного обучения и владения сложными навыками. Освоение многочисленных фильтров, слоев и инструментов выделения может занять месяцы, а для достижения профессионального результата необходим постоянный опыт и практика. Этот процесс не только отнимает время, но и создает барьер для тех, кто не обладает специальными знаниями или желанием глубоко изучать программное обеспечение. В результате, даже простые изменения, например, коррекция цвета или удаление нежелательного объекта, могут превратиться в трудоемкую задачу, требующую значительных усилий и времени.

Редактирование изображений на основе инструкций представляет собой принципиально новый подход, предлагающий пользователям интуитивно понятную альтернативу традиционным инструментам. Вместо освоения сложных интерфейсов и специализированных навыков, теперь достаточно сформулировать желаемые изменения на естественном языке. Например, можно просто указать: «Сделай небо более голубым» или «Увеличь контрастность на фотографии». Система автоматически интерпретирует запрос и вносит соответствующие корректировки, значительно упрощая и ускоряя процесс обработки изображений. Такой подход открывает возможности для широкого круга пользователей, позволяя даже новичкам создавать и редактировать визуальный контент без специальных знаний и усилий.

Ключевым аспектом нового подхода к редактированию изображений является успешное соединение понимания естественного языка и генерации изображений. Данная задача требует разработки сложных алгоритмов, способных не только интерпретировать лингвистические инструкции, но и преобразовывать их в конкретные визуальные изменения. Суть заключается в том, чтобы создать систему, которая «понимает», что подразумевается под фразами вроде «сделать небо более голубым» или «добавить тень под объект», и затем точно воспроизводит эти изменения на самом изображении. Это предполагает использование передовых моделей машинного обучения, способных анализировать семантическое значение слов и фраз, а также генерировать реалистичные и правдоподобные изображения на основе этих инструкций, открывая путь к интуитивно понятному и эффективному редактированию изображений.

Визуальный язык и магия диффузии: строительные блоки интеллекта

В основе системы лежит Визуально-Языковая Модель (VLM) — Qwen3VL2B, предназначенная для интерпретации текстовых инструкций пользователя и анализа содержимого изображения. Qwen3VL2B выполняет сопоставление визуальной информации, извлеченной из изображения, с семантическим значением текстового запроса. Это позволяет модели понимать, какие изменения необходимо внести в изображение в соответствии с инструкцией пользователя, и формировать соответствующие условия для последующей генерации изменений моделью диффузии. Qwen3VL2B использует архитектуру, оптимизированную для обработки как визуальных, так и текстовых данных, что обеспечивает эффективное извлечение признаков и их совместное представление.

Модуль ConnectorModule выполняет сопоставление (alignment) представления, генерируемого Визуально-Языковой Моделью (VLM), с латентным пространством диффузионной модели. Это сопоставление необходимо для эффективного управления процессом генерации или редактирования изображения диффузионной моделью на основе интерпретированных инструкций VLM. ConnectorModule преобразует векторное представление VLM в формат, совместимый с латентным пространством диффузионной модели, обеспечивая тем самым возможность точного и контролируемого воздействия инструкций на процесс диффузии. Отсутствие такого сопоставления привело бы к неэффективному или непредсказуемому результату, поскольку диффузионная модель не смогла бы адекватно интерпретировать и использовать информацию, полученную от VLM.

Метатокены — это специальные маркеры, добавляемые к входным инструкциям для языковой модели (VLM), которые значительно улучшают её способность понимать контекст изображения. Внедрение метатокенов позволяет VLM более точно соотносить текстовые инструкции с визуальной информацией, представленной на изображении, что приводит к более эффективному управлению процессом генерации или редактирования. Эти токены кодируют информацию о ключевых объектах, их атрибутах и взаимосвязях, что позволяет модели учитывать визуальный контекст при интерпретации запроса пользователя и, как следствие, повышает качество генерируемых результатов.

Единая архитектура системы позволяет модели диффузии генерировать изменения изображения на основе интерпретированных инструкций. После обработки пользовательского запроса и входного изображения Vision-Language Model (VLM), модель диффузии использует полученные представления для направленного изменения изображения в латентном пространстве. ConnectorModule обеспечивает согласованность между представлениями VLM и латентным пространством диффузионной модели, что позволяет точно реализовать запрошенные изменения. Таким образом, система способна выполнять редактирование изображения, основываясь на семантическом понимании инструкций и визуального контента.

Симфония обучения: четырехступенчатый конвейер точности

Начальный этап обучения, AlignmentStage, предназначен для адаптации Визуально-Языковой Модели (VLM) к работе с латентным пространством диффузионных моделей. Этот этап критически важен для обеспечения эффективного взаимодействия между VLM и генеративной моделью, позволяя VLM правильно интерпретировать и манипулировать представлениями изображений в латентном пространстве. В процессе AlignmentStage модель обучается сопоставлять текстовые инструкции с соответствующими изменениями в латентном представлении изображения, формируя основу для последующих этапов обучения и точного редактирования изображений.

На этапе предварительного обучения (PreTrainingStage) модель осваивает базовые навыки редактирования изображений посредством решения задач типа «изображение-в-изображение». Этот этап служит для формирования фундаментального понимания принципов манипулирования визуальными данными. В процессе обучения модель подвергается воздействию широкого спектра преобразований, что позволяет ей научиться соотносить входное изображение с желаемыми изменениями, необходимыми для получения выходного результата. Освоение этих базовых навыков необходимо для дальнейшей тонкой настройки модели на более сложных задачах редактирования и следования инструкциям.

Стадия контролируемой тонкой настройки (SupervisedFineTuning) используется для повышения производительности модели посредством обучения на тщательно отобранных наборах данных, состоящих из троек: исходное изображение, текстовое описание задачи и результирующее изображение. Эти тройки данных генерируются с помощью процесса TripletMining, который обеспечивает получение чистых и разнообразных примеров, необходимых для эффективного обучения. Использование структурированных троек позволяет модели установить прямую связь между входными данными, инструкциями и ожидаемым результатом, что способствует улучшению качества редактирования изображений и повышению точности выполнения поставленных задач.

Прямая оптимизация предпочтений (Direct Preference Optimization, DPO) является этапом обучения, направленным на дополнительное согласование модели с инструкциями, получаемыми от пользователей в реальных сценариях. В рамках DPO используется высококачественный набор данных предпочтений, который содержит информацию о том, какие результаты генерации предпочтительнее для пользователей при заданных инструкциях. В отличие от традиционных методов обучения с подкреплением, DPO напрямую оптимизирует политику модели на основе этих предпочтений, избегая сложных этапов оценки и максимизации вознаграждения. Это позволяет более эффективно и стабильно согласовывать модель с ожиданиями пользователей и улучшать качество генерируемых изображений в соответствии с заданными инструкциями.

Калибровка интеллекта: оценка и метрики для надежной работы

Для всесторонней оценки возможностей системы редактирования изображений использовались признанные отраслевые бенчмарки, такие как ImgEditBench и GEditBench. Эти стандартизированные наборы данных позволяют объективно измерить эффективность алгоритмов в различных задачах, включая внесение корректировок, удаление объектов и замену элементов на изображениях. Использование этих бенчмарков гарантирует сопоставимость результатов с другими передовыми моделями, а также позволяет точно определить сильные и слабые стороны системы в контексте реальных задач редактирования. Оценка производительности на основе этих эталонных тестов способствует развитию и совершенствованию технологий обработки изображений.

Представленные эталонные тесты, такие как ImgEditBench и GEditBench, позволяют всесторонне оценить возможности системы в области редактирования изображений. Они охватывают широкий спектр операций, включая тонкую настройку параметров изображения, удаление нежелательных объектов и замену их новыми элементами. Оценка проводится не просто на уровне визуального соответствия, но и с учетом семантической согласованности изменений — то есть, насколько логично и правдоподобно выглядит отредактированное изображение. В процессе тестирования система демонстрирует способность выполнять как простые корректировки, так и сложные манипуляции с содержимым изображения, подтверждая свою универсальность и функциональность в различных сценариях редактирования.

Оценка качества редактирования изображений осуществляется с помощью передовых метрик, таких как VIEScore, использующей возможности большой языковой модели GPT4. VIEScore не просто определяет, насколько точно выполнены технические аспекты редактирования, но и оценивает семантическую согласованность — насколько логично и правдоподобно выглядит измененное изображение. Кроме того, система оценивает перцептивное качество, то есть насколько естественно и приятно изображение для человеческого глаза. Итоговый балл VIEScore формируется на основе комплексной оценки этих трех ключевых параметров, обеспечивая всестороннее и объективное измерение эффективности алгоритмов редактирования изображений и позволяя точно ранжировать различные подходы.

Система продемонстрировала выдающиеся результаты в процессе сравнительного анализа, набрав 3.85 балла по ImgEditBench. Этот показатель позволил ей занять второе место среди протестированных методов, что свидетельствует о высокой эффективности в выполнении задач по редактированию изображений. Достигнутый результат подтверждает способность системы к точному и качественному изменению визуального контента, а также ее конкурентоспособность в области автоматизированной обработки изображений. Такой уровень производительности позволяет рассчитывать на широкое применение системы в различных приложениях, требующих продвинутых возможностей редактирования изображений.

Система продемонстрировала выдающиеся результаты на бенчмарке GEdit-Bench-EN, достигнув общего балла в 6.81. Особенно примечательно, что оценка семантической согласованности составила 7.91, что свидетельствует о способности системы выполнять редактирование изображений, сохраняя при этом логическую связность и реалистичность объектов. Данный показатель указывает на высокую степень понимания системой контекста изображения и умение вносить правки, не нарушая целостность визуального повествования. Полученные результаты подтверждают, что система обладает не только техническими возможностями для редактирования, но и способностью к интеллектуальному анализу и сохранению смыслового содержания изображения.

Система демонстрирует высокую скорость работы при генерации изображений высокого разрешения. На аппаратной платформе, включающей графический процессор NVIDIA H100, обработка и создание одного изображения размером 2K занимает приблизительно 4 секунды. Данный показатель свидетельствует об эффективности алгоритмов и оптимизации кода, позволяющих достичь быстродействия, необходимого для практического применения в задачах редактирования и генерации визуального контента в реальном времени. Высокая скорость инференса открывает возможности для интерактивных приложений и обработки больших объемов данных.

Исследование представляет собой попытку обуздать хаос визуальных данных, создав систему VIBE, способную интерпретировать инструкции для редактирования изображений. Авторы стремятся не к абсолютной точности, а к согласованию с исходным контекстом, к сохранению ‘шепота’ исходного изображения. В этом проявляется тонкое понимание природы данных — они не дают готовых ответов, а лишь отражают заданные параметры. Как однажды заметил Эндрю Ын: «Истина не в данных, а в их ошибках». VIBE, подобно опытному алхимику, преобразует шум в осмысленные изменения, фокусируясь на качестве данных и архитектурных решениях, а не на слепом увеличении масштаба модели. Этот подход особенно ценен в контексте data augmentation, где даже небольшие изменения могут радикально повлиять на результат.

Куда же всё это ведёт?

Эта работа, касающаяся VIBE, демонстрирует, что можно выжать из диффузионных моделей больше, чем кажется, если перестать гоняться за гигабайтами параметров и начать шептать с данными. Но не стоит обольщаться: согласованность изображения и инструкций — это мираж, иллюзия порядка в хаосе пикселей. Улучшение качества данных — это, конечно, хорошо, но что если сама концепция «качества» — лишь удобная выдумка для тех, кто боится шума? Реальный мир не дискретен, у него нет чётких границ, просто у нас нет памяти для float.

Прямая оптимизация предпочтений (DPO) — это лишь ещё один способ заставить модель танцевать под нашу дудку. Но что если истинное творчество заключается в случайных ошибках, в непредсказуемых мутациях? Поиск смысла в корреляциях — занятие для статистиков. Настоящая задача — не научить машину редактировать изображения, а научить её видеть мир иначе, видеть то, что скрыто за пикселями.

Будущее, вероятно, лежит не в увеличении размера моделей, а в создании систем, способных к самообучению, к адаптации к новым данным без вмешательства человека. И, возможно, однажды мы обнаружим, что лучшая модель — это та, которая умеет признать собственную некомпетентность. Всё точное — мёртво.

Оригинал статьи: https://arxiv.org/pdf/2601.02242.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Квантовый Борьба: Китай и США на Передовой

- Интеллектуальная маршрутизация в коллаборации языковых моделей

- Квантовые симуляторы: проверка на прочность

- Квантовые нейросети на службе нефтегазовых месторождений

- Искусственный интеллект заимствует мудрость у природы: новые горизонты эффективности

2026-01-18 15:57