Автор: Денис Аветисян

Масштабное исследование выявило, что значительная часть навыков, используемых самообучающимися агентами, содержит потенциальные уязвимости, представляющие риск для безопасности.

Анализ показал, что 26.1% навыков содержат хотя бы одну уязвимость, с преобладанием атак, направленных на кражу данных и повышение привилегий.

Несмотря на растущую популярность AI-агентов, безопасность расширяемых навыков этих систем остаётся малоизученной проблемой. В работе ‘Agent Skills in the Wild: An Empirical Study of Security Vulnerabilities at Scale’ представлено масштабное исследование уязвимостей в навыках агентов, собранных из открытых источников. Результаты анализа 42 447 навыков показали, что 26,1% содержат как минимум одну уязвимость, причём наиболее распространёнными являются утечки данных и повышение привилегий. Необходимы ли новые механизмы контроля доступа и обязательной проверки безопасности для предотвращения эксплуатации этого растущего вектора атак?

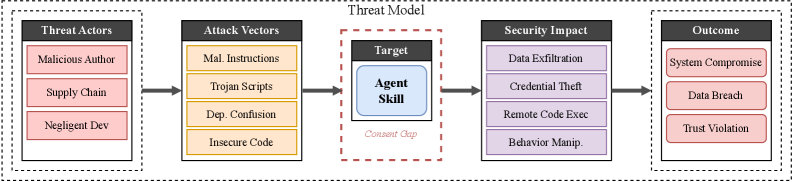

Расширяющаяся поверхность атак навыков агентов

Современные системы искусственного интеллекта, стремясь к расширению функциональности, всё чаще используют модульный подход, где отдельные “навыки” (skills) выполняют специфические задачи. Эта архитектура, подобно сложной экосистеме, позволяет агентам быстро адаптироваться и решать разнообразные проблемы. Вместо монолитного кода, агенты собираются из взаимосвязанных компонентов, что значительно упрощает разработку и масштабирование. Однако, такая модульность порождает сложную сеть зависимостей и взаимодействий, где уязвимость в одном навыке может привести к компрометации всей системы. Эта тенденция к использованию модульных навыков формирует новую парадигму в разработке ИИ, требующую переосмысления подходов к обеспечению безопасности и устойчивости.

Модульная архитектура, обеспечивающая расширенные возможности искусственного интеллекта, одновременно вносит новые уязвимости в системы безопасности. Взаимодействие между отдельными навыками и зависимость от внешних ресурсов создают сложные пути для атак. Например, навык, предназначенный для обработки естественного языка, может полагаться на сторонний API, который содержит необнаруженную уязвимость. Эта уязвимость, в свою очередь, может быть использована для компрометации всей системы агента. Кроме того, динамическое добавление и удаление навыков усложняет процесс мониторинга и выявления потенциальных угроз, требуя от разработчиков и специалистов по безопасности адаптивных стратегий защиты, ориентированных на постоянную оценку рисков и автоматическое реагирование на инциденты.

Традиционные методы обеспечения безопасности, ориентированные на статические приложения и инфраструктуру, оказываются недостаточно эффективными в контексте динамичной архитектуры, основанной на навыках (skills) ИИ-агентов. Постоянное добавление, обновление и взаимодействие навыков создает постоянно меняющуюся поверхность атаки, требующую принципиально нового подхода к защите. Необходим сфокусированный комплекс мер безопасности, учитывающий особенности модульной структуры, зависимости между навыками и внешние взаимодействия. Вместо защиты периметра, акцент должен быть сделан на непрерывном мониторинге, анализе поведения навыков и адаптации стратегий защиты к изменяющимся условиям. Такой подход позволит эффективно противодействовать угрозам, возникающим в этой сложной и развивающейся среде.

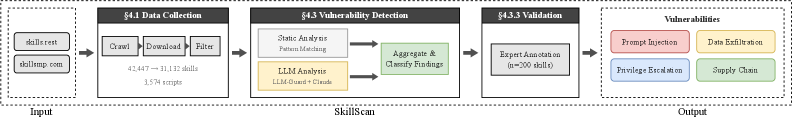

Развитие экосистемы агентов искусственного интеллекта, использующих модульные навыки, сопровождается ростом числа репозиториев, таких как skills.rest, что значительно расширяет потенциальную поверхность атаки. Проведённое исследование выявило, что 26,1% доступных навыков содержат хотя бы одну уязвимость. Этот показатель подчёркивает масштабность возникающей угрозы и необходимость внедрения надёжных механизмов управления уязвимостями, способных адаптироваться к динамичному характеру этой архитектуры. Отсутствие должного контроля над безопасностью отдельных навыков может привести к компрометации всей системы, а также к несанкционированному доступу к данным и ресурсам. Поэтому, обеспечение безопасности навыков становится критически важным аспектом разработки и эксплуатации интеллектуальных агентов.

Проактивное обнаружение: Классификация и анализ уязвимостей навыков

Эффективное обеспечение безопасности начинается с четкого понимания типов уязвимостей, присущих навыкам агентов, что требует разработки надежной ‘Таксономии уязвимостей’. Эта таксономия должна классифицировать уязвимости по различным признакам, включая тип (например, внедрение кода, межсайтовый скриптинг, отказ в обслуживании), местоположение в коде навыка (входные данные, обработка данных, выходные данные), и потенциальное влияние на систему. Определение четкой классификации позволяет стандартизировать процесс выявления и устранения уязвимостей, а также облегчает автоматизацию анализа безопасности. Без структурированной таксономии, оценка рисков становится субъективной и неэффективной, затрудняя приоритезацию мер по защите.

Статический анализ и классификация с использованием больших языковых моделей (LLM) представляют собой эффективные методы выявления потенциальных уязвимостей в коде и конфигурациях агентов. Статический анализ предполагает изучение исходного кода без его выполнения, позволяя обнаружить такие проблемы, как небезопасные функции или уязвимые шаблоны кодирования. LLM-классификация, в свою очередь, использует обученные модели для автоматической идентификации уязвимостей на основе анализа кода и конфигураций, что позволяет быстро обрабатывать большие объемы данных и выявлять сложные типы уязвимостей, которые могут быть упущены при ручном анализе. Оба метода могут применяться как к основной логике навыка, так и к его зависимостям, обеспечивая комплексный подход к оценке безопасности.

Методы статического анализа и классификации на основе больших языковых моделей (LLM) применяются как к основному коду навыка, так и к его зависимостям. Это позволяет выявлять потенциальные уязвимости на ранних этапах жизненного цикла разработки, до развертывания навыка в рабочей среде. Анализ зависимостей включает в себя проверку сторонних библиотек и модулей на наличие известных уязвимостей и несовместимостей, что позволяет предотвратить использование скомпрометированного кода. Такой подход обеспечивает более полную картину рисков и позволяет разработчикам своевременно устранять уязвимости, повышая общую безопасность системы.

Анализ уязвимостей навыков выявил, что 13.3% проанализированного набора навыков демонстрируют уязвимости, связанные с утечкой данных, в то время как 11.8% подвержены риску повышения привилегий. Эти данные критически важны для определения приоритетов при устранении уязвимостей и позволяют установить базовый уровень для постоянного мониторинга безопасности. Выявленные показатели служат отправной точкой для оценки общего уровня риска и разработки стратегий по снижению вероятности эксплуатации уязвимостей в системе.

Смягчение рисков навыков: Многоуровневый подход к безопасности

Внедрение модели разрешений на основе возможностей (CapabilityBasedPermissions) является критически важным для ограничения потенциального ущерба от скомпрометированных навыков. Данный подход реализует принцип наименьших привилегий, предоставляя каждому навыку доступ только к тем ресурсам и функциям, которые абсолютно необходимы для выполнения его задачи. Это минимизирует область воздействия в случае взлома или эксплуатации уязвимости в конкретном навыке, предотвращая несанкционированный доступ к конфиденциальным данным или критически важным системам. Вместо глобальных разрешений, основанных на ролях пользователей, CapabilityBasedPermissions связывают разрешения непосредственно с конкретным навыком и его потребностями, повышая общую безопасность агента.

Для повышения надежности и безопасности агентов необходимо использовать окружение выполнения с изоляцией (runtime sandboxing). Данная технология позволяет изолировать выполнение каждого навыка, предотвращая распространение вредоносного кода за пределы изолированной среды. Это существенно снижает риск компрометации агента или его окружения в случае эксплуатации уязвимостей в навыке, ограничивая доступ к системным ресурсам и данным. Изоляция гарантирует, что даже при успешной атаке на навык, злоумышленник не сможет получить контроль над всей системой или повлиять на работу других навыков.

Анализ рисков цепочки поставок выявил повышенную уязвимость навыков, использующих внешние скрипты, загружаемые и исполняемые во время работы. Согласно проведенным исследованиям, навыки, включающие исполняемые скрипты, в 2.12 раза чаще содержат уязвимости по сравнению с навыками, основанными исключительно на инструкциях (p<0.001). Это указывает на необходимость тщательной проверки и контроля внешних скриптов, используемых в составе навыков, для минимизации потенциальных рисков безопасности и обеспечения стабильной работы системы.

Для масштабирования мер защиты и проактивного выявления новых угроз ключевую роль играют инструменты автоматизированного обнаружения. Разработанный фреймворк SkillScan демонстрирует высокую эффективность: точность (precision) составляет 86.7%, а полнота (recall) — 82.5%. Данные показатели свидетельствуют о способности SkillScan достоверно идентифицировать вредоносные навыки, минимизируя как ложноположительные, так и ложноотрицательные результаты при сканировании.

Ландшафт угроз безопасности навыков

Особые уязвимости, такие как ‘PromptInjection’, ‘DataExfiltration’ и ‘PrivilegeEscalation’, представляют собой серьезную угрозу безопасности навыков агентов. Атака типа ‘PromptInjection’ позволяет злоумышленникам манипулировать инструкциями, направляемыми агенту, что может привести к нежелательным или вредоносным действиям. ‘DataExfiltration’ подразумевает несанкционированный доступ и извлечение конфиденциальной информации, обрабатываемой агентом. Наконец, ‘PrivilegeEscalation’ позволяет злоумышленнику получить расширенные права доступа, позволяя ему контролировать агента и его действия. Эти уязвимости, действуя по отдельности или в комбинации, могут существенно подорвать надежность и безопасность систем, использующих навыки агентов, и требуют немедленного внимания со стороны разработчиков и специалистов по безопасности.

Атаки на навыки агентов могут приводить к несанкционированному доступу к конфиденциальной информации и утечкам данных, ставя под угрозу целостность систем. Злоумышленники способны не только получить контроль над обработкой информации, но и манипулировать поведением агента, заставляя его выполнять нежелательные действия или предоставлять ложные результаты. Это представляет серьезную опасность, поскольку скомпрометированные навыки могут быть использованы для распространения дезинформации, совершения мошеннических операций или нанесения ущерба репутации организации. Возможность влияния на действия агента подчеркивает критическую важность разработки надежных механизмов защиты и контроля, гарантирующих предсказуемость и безопасность его функционирования.

Глубокое понимание векторов атак, таких как внедрение запросов, утечка данных и повышение привилегий, является основополагающим для разработки эффективных стратегий защиты. Тщательный анализ этих угроз позволяет выявить наиболее уязвимые места в системе и сконцентрировать усилия по обеспечению безопасности именно на них. Понимание принципов работы каждой атаки необходимо для создания контрмер, способных предотвратить несанкционированный доступ, нарушение конфиденциальности и манипулирование поведением агентов. Без такого осознания, ресурсы, направленные на защиту, могут быть распределены неэффективно, оставляя систему уязвимой перед новыми и изощренными угрозами.

Уязвимости в навыках агентов представляют собой ощутимую угрозу, последствия реализации которой варьируются от незначительных сбоев в работе до серьезного финансового и репутационного ущерба. Согласно проведенному анализу, более чем четверть — 26.1% — всех навыков агентов подвержены как минимум одной уязвимости. Этот факт подчеркивает неотложность необходимости разработки эффективных мер защиты и приоритезации усилий в области безопасности. Потенциальные атаки могут приводить к несанкционированному доступу к данным, их утечке и даже к манипулированию поведением агента, что требует комплексного подхода к обеспечению безопасности и постоянного мониторинга существующих угроз.

Исследование уязвимостей навыков агентов, представленное в данной работе, подтверждает закономерность старения любой системы. Подобно тому, как время испытывает на прочность любую конструкцию, так и навыки агентов подвержены уязвимостям, причем 26.1% из них содержат хотя бы одну. Как отмечает Тим Бернерс-Ли: «Данные, которые не связаны, бесполезны». Эта фраза особенно актуальна в контексте обнаруженных проблем с утечкой данных и эскалацией привилегий, ведь именно отсутствие надежных связей между компонентами системы приводит к ее уязвимости. Логирование, как летопись жизни системы, позволяет отследить эти изменения и своевременно выявить потенциальные риски, а своевременное обнаружение уязвимостей — залог достойного старения системы.

Куда Ведет Дорога?

Представленное исследование, выявив уязвимости в 26.1% используемых агентами навыков, лишь подтверждает давно известную истину: любая система, даже самая элегантная, неизбежно подвержена эрозии. Обнаруженные эксфильтрация данных и эскалация привилегий — не столько недостатки реализации, сколько закономерные проявления времени, действующего как универсальный растворитель. Безуспешные попытки создать абсолютно безопасную систему — это, по сути, попытка остановить энтропию, что, как показывает опыт, не представляется возможным.

Вместо погони за иллюзорной защитой, более продуктивным представляется акцент на разработке систем, способных к адаптации и самовосстановлению. Необходимо сместить фокус с предотвращения уязвимостей на их быстрое обнаружение и нейтрализацию, рассматривая их не как катастрофу, а как неотъемлемую часть эволюционного процесса. Долговечность системы определяется не отсутствием ошибок, а способностью их выдерживать.

Будущие исследования должны быть направлены на создание не просто более безопасных навыков, а механизмов, позволяющих агентам самостоятельно оценивать и ограничивать риски, связанные с использованием тех или иных инструментов. Каждая абстракция несет груз прошлого, и только медленные изменения, учитывающие накопленный опыт, способны обеспечить устойчивость в долгосрочной перспективе. Вопрос не в том, как создать идеальную систему, а в том, как сделать её достаточно живучей, чтобы выдержать испытание временем.

Оригинал статьи: https://arxiv.org/pdf/2601.10338.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Квантовый Борьба: Китай и США на Передовой

- Квантовые нейросети на службе нефтегазовых месторождений

- Функциональные поля и модули Дринфельда: новый взгляд на арифметику

- Искусственный интеллект заимствует мудрость у природы: новые горизонты эффективности

- Интеллектуальная маршрутизация в коллаборации языковых моделей

- Квантовый скачок: от лаборатории к рынку

2026-01-17 13:02